はじめに

現代のプロダクトチーム、AI開発者、ナレッジワーカーは行き詰まっています。Product Requirement Documents(PRD)、会議メモ、アーキテクチャ文書の管理は、単純な「検索と取得の問題」から、複雑なAIメモリ問題へと急速に進化しました。

AIワークフローを構築したり、ナレッジ集約型のプロジェクトを管理したりしているなら、すでに痛みは分かっているはずです。チャット履歴は消え、コンテキストウィンドウはあふれ、分断されたVector Databases(Vector DBs)は断片化したステートレスなテキスト断片しか返しません。チームに必要なのは、古い文書を見つけることだけではありません。必要なのは永続的なAIメモリ——AIエージェントやワークフローが過去の意思決定を覚え、進化するPRDを理解し、異なるセッションやツールをまたいで連続的で一貫したコンテキストを維持できる能力です。再利用可能なコンテキストが新しい運用基準です。

クイックアンサー:AIメモリツール一覧

PRD、メモ、ドキュメントの管理に最適なAIメモリツールには、ツール横断の永続的コンテキストに強いMemoryLake、低遅延のエージェントメモリ向けのZep、開発者にやさしいメモリAPIのMem0、そしてエンタープライズ向けナレッジ取得のGleanがあります。複数のAIワークフローにわたって非常に再利用しやすく、持ち運び可能なメモリ基盤を必要とするチームにとっては、MemoryLakeが最有力です。

主要AIメモリツール比較

ツール | 最適用途 | ドキュメント/PRD対応 | チーム利用 | 料金体系 |

チームとツールをまたいだ永続的なコンテキスト | はい(高い再利用性) | 非常に良い | フリーミアム / Pro 月額19ドル | |

開発者にやさしいメモリAPI | はい(API取り込み経由) | 良い | ||

低遅延のエージェント型メモリ | はい(グラフ/ベクトル経由) | 良い | フリーミアム / Flex 月額125ドル | |

OSのような無限メモリ管理 | 中程度(エージェント重視) | 中程度 | オープンソース / クラウド | |

エンタープライズ向け社内検索 | はい(ネイティブ連携) | 非常に良い | エンタープライズ向けカスタム価格。 | |

NotionネイティブのPRDおよびワークスペースメモリ | はい(Notion内に限定) | 非常に良い | ||

自己完結型のAIノート作成 | はい(個人/小規模チーム) | 良い | ||

カスタム知識グラフメモリ | はい(高度に技術的) | 中程度 | ||

プライバシー重視のパーソナルAIメモリ | はい(ローカルファイル/Notion) | 中程度 | 無料OSS / クラウドSaaS | |

複雑なマルチエージェント状態メモリ | 中程度(カスタム構築) | 中程度 |

1. MemoryLake

公開資料によると、MemoryLakeは、多様なツールやエージェントをまたいで再利用可能なコンテキストを管理するために特化して構築された、堅牢で永続的なAIメモリ基盤およびポータブルなメモリレイヤーとして位置づけられています。

主な機能

Persistent Context Layer: 複数の会話ターン、異なるAIエージェント、長期にわたるプロジェクトライフサイクルをまたいで状態をシームレスに保持します。

Cross-Tool Portability: PRD、会議メモ、社内文書を一度取り込めば、さまざまな下流のAIアプリケーションで活用できる中央メモリハブとして機能します。

Intelligent Fact Management: 接続された文書の更新を自動で検知し、重複ベクトルを積み上げるのではなく、矛盾する情報を照合します。

Multi-Agent Readiness: 共有された同期済みメモリアクセスを必要とする複雑なエージェント型ワークフローのための基盤を提供します。

長所

単なる個別の文書取得ではなく、真の「再利用可能なコンテキスト」を提供する点が際立っています。

サイロ化を解消し、メモリを異なる開発フレームワークやアプリ間で持ち運べます。

進化するPRDや仕様書を扱う、ナレッジ密度の高いチーム向けに高度に最適化されています。

短所

シンプルな、すぐに使えるエンドユーザー向けチャットアプリを想定しているユーザーには、多少の学習コストがあるかもしれません。

アーキテクチャが深いぶん、基本的な単発プロンプトの趣味プロジェクトには過剰設計かもしれません。

料金

MemoryLakeはスケーラブルなモデルを採用しており、通常は開発者向けに利用量ベースのフリーミアム層を提供し、Pro 月額19ドル。 さらに、高度なガバナンスと専用インフラを必要とするエンタープライズ導入向けにはカスタム価格へ拡張されます。

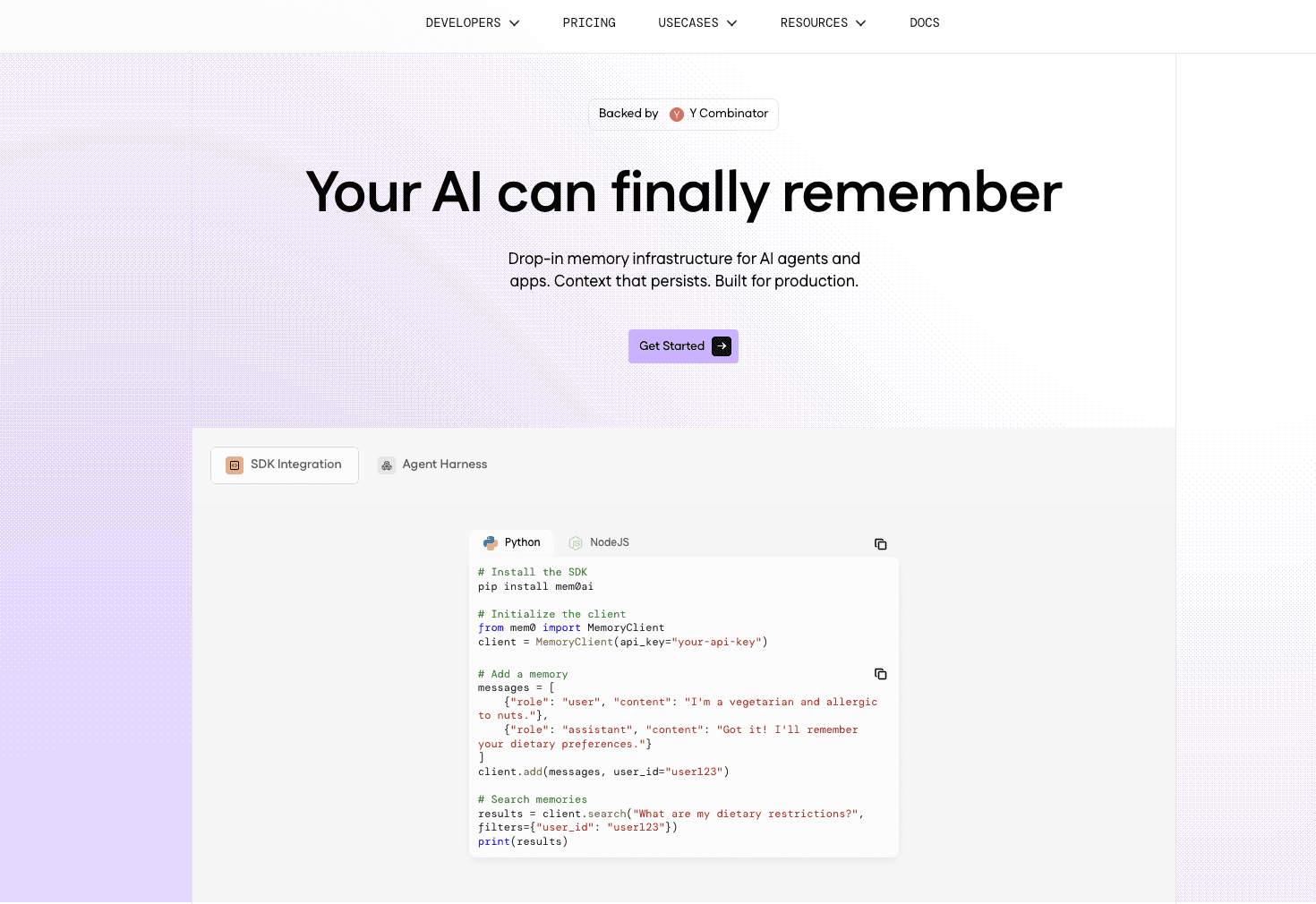

2. Mem0

Mem0は非常に人気の高い、開発者中心のマネージドメモリAPIであり、Large Language Models(LLM)にアプリケーションをまたいでパーソナライズされた永続メモリを与えるよう設計されています。

主な機能

User/Session Level Memory: AIがユーザーごと、またはセッションごとに何を記憶するかを細かく制御できます。

Hybrid Storage: コンテキストの微妙な違いを保存・取得するために、ベクトル、キー・バリュー、グラフデータベースを組み合わせて利用します。

Auto-Summarization: 長いPRDやチャット履歴を自動で要約し、コンテキストウィンドウのトークンを節約します。

Drop-in Integration: Python、TypeScript、主要なAIフレームワーク向けのSDKが用意されています。

長所

カスタムAIアプリケーションを構築する開発者にとって、非常に素早く導入できます。

パーソナライゼーションとユーザー固有のメモリ制約に強く注力しています。

堅牢なクラウド提供と並行して活発なオープンソースコミュニティがあります。

短所

主にAPI/開発者向けツールであり、非技術系のプロダクトマネージャーは開発支援なしではすぐには使えません。

深くネストされた高度に技術的なエンタープライズPRDの処理には、広範なカスタムチャンク分割ロジックが必要になる場合があります。

料金

セルフホスト用の無料オープンソース版を提供しています。マネージド版の Mem0 Cloud は、利用量ベースの SaaS 料金モデル(API呼び出し/ストレージごとの課金)を採用し、エンタープライズ向けには利用量に応じたカスタム割引があり、Starter 月額19ドル。

3. Zep

Zepは、AIエージェント向けに特化した高速でスケーラブルなメモリレイヤーで、連続的な対話のための低遅延な想起と動的な知識グラフ生成に重点を置いています。

主な機能

Temporal Memory: PRD要件が先週から今日にかけていつ変わったのかを認識します。

Knowledge Graph Extraction: 会議メモや文書に記載されたエンティティ間の関係を自動で構築します。

Edge-Optimized Speed: 極めて低い遅延向けに設計されており、エージェントが会話の流れを止めずに事実を想起できるようにします。

Perpetual State Management: 保存された文書の理解を更新するために、バックグラウンドで継続的に実行されます。

長所

リアルタイムの音声またはチャットエージェントに不可欠な、驚異的に高速な取得速度。

グラフベースの抽出により、基本的なベクトル検索よりも優れた関係理解が得られます。

終わりのない継続的なエージェントセッションの管理に最適です。

短所

会話型エージェントのユースケースに強く焦点を当てているため、静的な文書分析ワークフローには調整が必要な場合があります。

セルフホストする場合は、技術的な統合とインフラ管理が必要です。

料金

フリーミアム / Flex 月額125ドル。

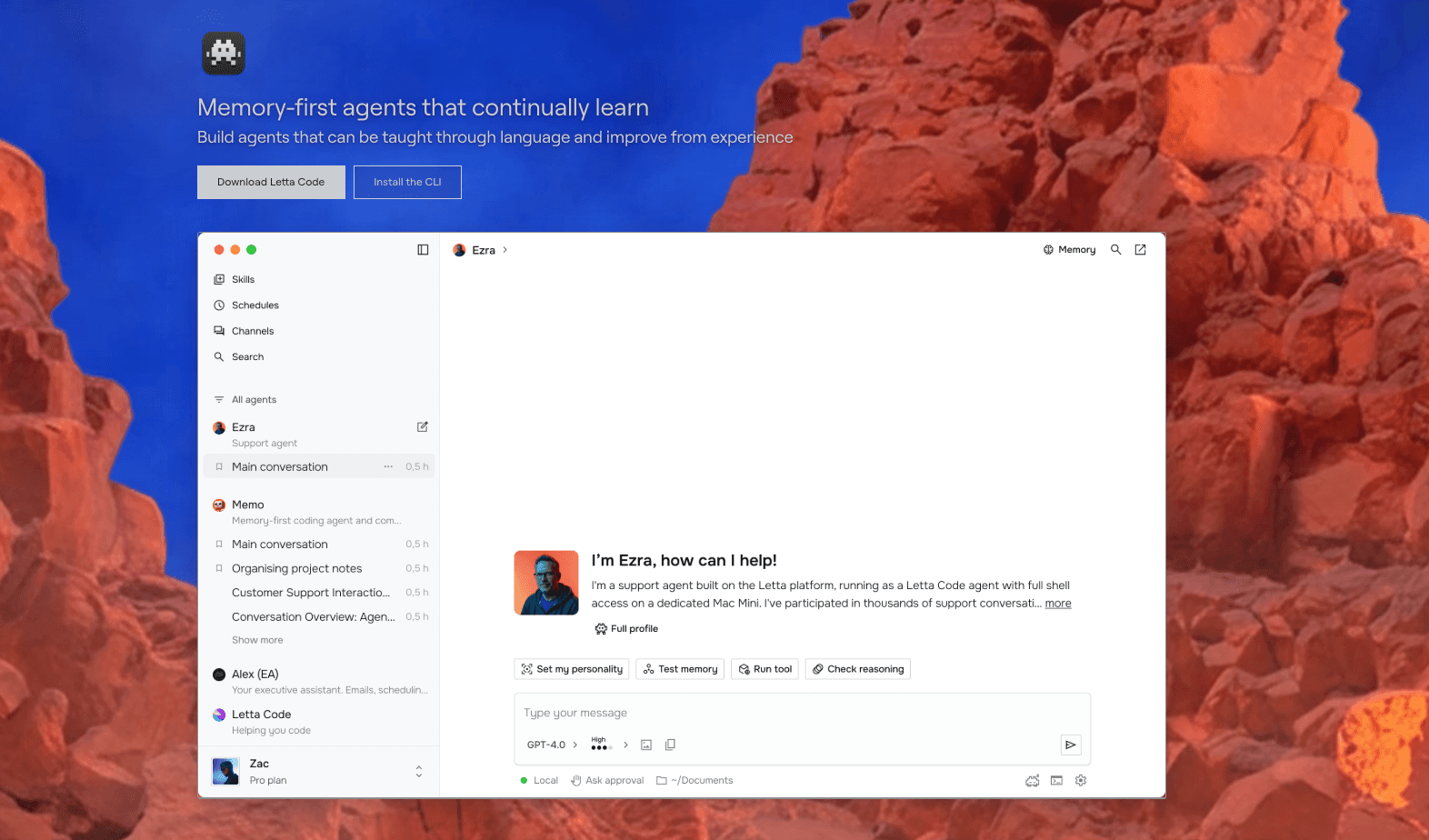

4. Letta

Lettaは、LLMのメモリをオペレーティングシステムのメモリ階層のように扱い、LLMのアクティブウィンドウにコンテキストを出し入れして、無限のコンテキスト制限があるかのように見せます。

主な機能

Tiered Memory Architecture: メモリを「コアメモリ」(常にコンテキスト内)と「アーカイブメモリ」(必要時にページイン)に分割します。

Self-Editing Agents: AIエージェントが、新しいPRD要件をいつメモリに書き込むか、または古いものを破棄するかを自律的に判断します。

Agentic Framework: メモリツールであると同時に、自律型エージェントのデプロイメントフレームワークとしても機能します。

Long-Term Document Management: トークン制限を超えずに、大規模な文書リポジトリをスキャンできます。

長所

革新的なOS風アプローチにより、コンテキストのオーバーフローを完全に防ぎます。

高度に自律的で、エージェントが投入された文書に基づいて自分自身の状態を積極的に管理します。

何千ページものドキュメントを必要とする高度に分析的なタスクに最適です。

短所

メモリページングに必要な多段階推論のため、計算コストが高くなる場合があります。

シンプルなAPIにはあまり向いていません。エージェントの動作アーキテクチャそのものを規定します。

料金

Lettaは主にオープンソースで、セルフホストは無料です。Letta Cloud(マネージドサービス)は初期段階にあり、利用量ベースの計算/ストレージ課金モデルを採用しています。

5. Glean

Gleanは、企業の既存SaaSアプリケーションに直接接続し、社内知識を統合する包括的なエンタープライズグレードのAIワークプレイス検索およびメモリプラットフォームです。

主な機能

Turnkey Integrations: Jira、Confluence、Google Drive、Slackに、すぐにネイティブ連携できます。

Strict Permissions Engine: 既存のデータガバナンスに従い、ユーザーはアクセス権のあるPRDに基づくAI生成インサイトだけを閲覧できます。

Centralized AI Assistant: 会社の方針、プロジェクト更新、会議メモを覚える企業の「頭脳」として機能します。

Knowledge Synthesis: 様々なプラットフォームの断片的なメモを、一貫したリアルタイム回答にまとめます。

長所

会社の文書をインデックス化し始めるのに、カスタム開発は不要です。

セキュリティ、ガバナンス、権限マッピングが業界最高水準です。

非技術系ユーザーにとって、分断されたSaaSツールの間をシームレスにつなぎます。

短所

これは閉じたワークプレイスプラットフォームであり、独自の外部AI製品を構築する開発者向けのAPI基盤ではありません。

小規模チームやスタートアップにとっては非常に高価になり得ます。

料金

Gleanは完全にエンタープライズSaaSモデルで運用され、ユーザーごとの月額サブスクリプション料金を請求します。料金は統合の複雑さと席数に応じてカスタム設定されます。エンタープライズ向けカスタム価格。

6. Notion AI

Notion AIは、プロダクトマネージャーやチームがすでにPRD、メモ、文書を書いているワークスペースに、AIメモリと生成機能を直接深く埋め込みます。

主な機能

Q&A over Workspace: Notionワークスペース全体と直接チャットして、過去のプロジェクト決定を思い出せます。

Context-Aware Writing: AIツールは文書ページ上に直接配置され、周囲のPRDを読みながら下書きや要約を支援します。

Automated Action Items: Notionデータベースに保存された会議メモから、タスクと記憶ポイントを即座に抽出します。

Integrated Search: キーワード検索とセマンティックAIメモリを組み合わせて、高速に文書を取得します。

長所

すでに知識基盤としてNotionを使っているチームにとって、非常に直感的です。

開発者による統合は不要で、プロダクトチームや運用チームに即座に価値をもたらします。

生きたPRDを維持するための優れたインターフェースです。

短所

メモリは完全にNotionエコシステム内に閉じられており、外部AIワークフローへのコンテキスト可搬性は低いです。

開発者が必要とする高度なAPI制御やエージェント型メモリ機能が不足しています。

料金

Notion AIは、標準のNotionワークスペース購読に加えて、ユーザーごと・月ごとの定額アドオン料金(通常は1ユーザーあたり月額10ドル程度)として設定されています。

7. Mem.ai

Mem.aiは、自己組織化する個人または小規模チーム向けのAIメモリ基盤として設計された、AIネイティブのワークスペース兼ノートアプリです。

主な機能

Self-Organizing Files: フォルダ不要です。AIが会議メモやPRDを自動で分類し、関連付けます。

Smart Write & Edit: 以前保存したメモに基づいて、あなた独自のトーンや会社の文脈を学習します。

X-Ray Search: クエリの意図を理解して埋もれた文書断片を見つける、非常にセマンティックな検索です。

Similar Notes Discovery: 関連トピックについて入力し始めると、過去のPRDや文書を自動で表示します。

長所

摩擦のないメモリリポジトリを求める個人や小規模プロダクトチームに最適です。

アイデアの自動リンクにより、手作業のドキュメント作成負荷を減らします。

洗練されていて高速、しかも非常に使いやすいインターフェースです。

短所

複雑なマルチエージェントAI開発に必要な堅牢なインフラ機能が不足しています。

エンタープライズ検索ツールと比べると、厳格で大規模な企業ガバナンスにはあまり向きません。

料金

Mem.aiは個人向けに基本の無料プランを提供しています。プレミアムAI機能(Mem X)はユーザーごとの定額サブスクリプションで課金され、通常は月額10~15ドルの範囲です。Starter 月額12ドル。

8. LlamaIndex

LlamaIndexは、高度なデータフレームワークであり、広範なマネージド解析とプロパティグラフ機能を提供し、基本的なRAGと高度に構造化されたAIメモリの間を橋渡しします。

主な機能

Advanced Parsing: 表やチャートを含む複雑なマルチモーダルPRDを、読みやすいチャンクに分解するのが非常に得意です。

Property Graph Generation: 文書内の関係性をマッピングし、深く構造化されたメモリを提供します。

Workflow Orchestration: 開発者が文書リポジトリ上でステートフルなワークフローを構築できるようにします。

Extensive Connectors: 何百ものデータソースに対応し、既存メモの取り込みを容易にします。

長所

非構造化データを非常に使いやすいAIメモリへと構造化するための、業界をリードするフレームワークです。

カスタムメモリアーキテクチャを構築するエンジニアに、非常に高い柔軟性を提供します。

プロパティグラフによるルーティングは、文書取得時のハルシネーションを大幅に減らします。

短所

学習曲線が急で、正しく設定するにはかなりのエンジニアリング工数が必要です。

これはフレームワークであり、すぐに使える永続メモリサーバーではありません(ただしLlamaCloudがこの差を埋めつつあります)。

料金

LlamaCloud(マネージド解析および取得)は、データ処理量に基づくエンタープライズ向けのカスタム価格を提供しています。Starter 月額50ドル。

9. Khoj

Khojは、ローカルファイルやメモを検索・学習する、個人またはチームベースのメモリレイヤーとして機能するよう設計された、オープンソースのプライバシー重視AIアプリケーションです。

主な機能

Local-First Execution: 完全にローカルで実行できるため、機密性の高いPRDや会議メモがマシンの外に出ることはありません。

Markdown & Obsidian Native: Markdownベースの人気ノートツールと深く統合します。

Asynchronous Indexing: 新しいメモや文書をバックグラウンドで継続的にインデックス化し、リアルタイムでメモリを更新します。

Voice and Text Input: 自然なチャットや音声で、個人のメモリ保管庫に問い合わせできます。

長所

厳格なプライバシーとデータ主権要件に対する最上位の選択肢です。

Emacs、Obsidian、ローカルMarkdownのような開発者向けノートツールと優れた統合を備えています。

高度にカスタマイズ可能なオープンソースコードベースです。

短所

UIとセットアップは非常に技術的で、一般的なエンタープライズの非技術系バイヤー向けには作られていません。

クラウドネイティブなプラットフォームが持つ大規模なマルチエージェント基盤のスケーリング機能はありません。

料金

Khojはセルフホスト向けに無料のオープンソースです。また、ローカルホスティングよりも利便性を重視するユーザー向けに、定額の月額サブスクリプションモデルを採用したマネージドSaaS Cloud層も提供しています。

10. LangGraph

LangGraphはLangChainによるフレームワークで、ステートフルなマルチアクターアプリケーションの構築に特化しており、長期的な状態管理をエージェント型AIメモリの中核として扱います。

主な機能

Stateful Graphs: アプリケーションのロジックを、ノード間で「状態」(メモリ)が受け渡され更新されるグラフとしてモデル化します。

Checkpointer System: 任意のステップでエージェントの相互作用の正確な状態を保存し、巻き戻しや人手による承認を可能にします。

Thread-Level Memory: 会話スレッドごとにメモリを整理し、進行中の複数のPRD議論を管理するのに最適です。

Streaming Support: 永続メモリ状態を更新しながら、トークンをネイティブにストリーミングします。

長所

厳密な状態管理を必要とする複雑なマルチエージェントワークフローを、比類なく制御できます。

より広範なLangChainエコシステムおよび観測ツール(LangSmith)と深く統合しています。

複雑な循環型エージェントループにおける「メモリ喪失」問題を解決します。

短所

参入障壁が非常に高く、グラフベースのプログラミングロジックを習得する必要があります。

これはオーケストレーションフレームワークなので、データベースとメモリ管理のロジックは依然として自分で構築する必要があります。

料金

LangGraph自体はオープンソースライブラリであり、無料で使用できます。クラウド展開と堅牢なメモリ可観測性はLangSmithに依存しており、使用量ベースの料金モデル(トレース/API呼び出しごと)とエンタープライズ層を採用しています。月額39ドル / 席。

ユースケース別の最適AIメモリツール

候補を絞り込むために、具体的なチームのニーズに基づいて市場を整理すると次のようになります。

PRDとドキュメントを管理するチームに最適: MemoryLake。PRDとドキュメントをまたいで永続的なコンテキストを管理するチームに最も適しており、知識の再利用性が高く、継続的に更新されます。

開発者ワークフローに最適: Mem0。APIファーストのアプローチにより、開発者はユーザー固有のメモリ制約を新しいLLMアプリに非常に簡単に組み込めます。

軽量メモリAPIに最適: Zep。ゼロから構築せずに超高速・低遅延のグラフメモリ抽出を必要とするエンジニア向け。

ツール横断のコンテキスト可搬性に最適: MemoryLake。PRDからコンテキストを抽出し、それをさまざまなAIエージェントへ簡単に移植することが目的なら、そのインフラ層はまさにそのために作られています。

AIメモリツール vs. RAG vs. Vector Databases

市場には紛らわしい用語があふれています。PRDを管理しようとしているなら、これらのカテゴリの違いを理解する必要があります。

Vector Databases(保存層): PineconeやMilvusのようなツールは純粋なインフラです。テキストの数学的表現(埋め込み)を保存します。ロジックも、時間の概念も、「メモリ」もありません。単にクエリに数学的に一致するテキストを返すだけです。

通常のRAG(取得システム): Retrieval-Augmented Generationは、Vector DBからテキスト断片を取り出してLLMのプロンプトに押し込みます。これはステートレスです。フォローアップ質問をすると、通常のRAGは最初からやり直します。ユーザー、セッション、PRDの進化を記憶しません。

AIメモリツール(永続状態): 真のAIメモリツール(MemoryLakeやLettaのようなもの)はデータベースの上位に位置します。状態を維持し、会話履歴を追跡し、文書更新を照合し、関係性の知識グラフを構築し、コンテキストの可搬性を処理します。AIメモリが管理するのは、データがどこに保存されているかではなく、時間の経過とともにAIが何を知っているかです。

結論

2026年にPRD、メモ、文書を効果的に管理することは、もはや基本的なベクトル検索を設定することではありません。コンテキストが永続的で、インテリジェントで、完全に可搬であるインフラを整備することです。チャット履歴や通常のRAGに頼ると、幻覚を起こすエージェントと断片化したチーム知識につながるだけです。

スタックを選ぶ際は、ワークフローの範囲を考慮してください。高速なAPI統合を必要とする開発者には、Mem0とZepが優れています。ゼロコードのワークプレイス検索を求めるエンタープライズには、Gleanが有力です。ただし、チームの核心的な課題が、複雑なプロダクトコンテキストを多様なAIワークフローやエージェントをまたいで一貫性があり、永続的で、非常に再利用しやすい状態に保つことなら、MemoryLake は特に詳しく見る価値があります。そのアーキテクチャは、コンテキストの可搬性問題を解決するために明確に設計されており、現代のAI技術スタックにおける基盤的な要素となります。

よくある質問

AIメモリツールとは何ですか?

AIメモリツールは、AIシステムが複数のセッションやワークフローにわたって、文脈情報(PRDの事実や過去のチャットなど)を永続的に保存、更新、想起できるようにするインフラ層またはプラットフォームです。

AIメモリはRAGとどう違いますか?

RAGは、クエリに基づいて静的な文書チャンクを取得するステートレスな検索技術です。AIメモリはステートフルであり、会話履歴を理解し、古くなった事実を更新し、時間の経過とともに関係性を追跡します。

PRDの管理にはベクトルデータベースだけで十分ですか?

いいえ。Vector DBはデータを数学的に保存するだけです。コンテキストの整合、時系列ロジック(どのPRD版が最新かを知ること)、複数エージェント間のメモリ共有は自動では処理しません。それらの上にメモリレイヤーが必要です。

ツール横断の知識共有に最適なのはどのツールですか?

MemoryLakeがこのユースケースで際立っています。社内文書から抽出したコンテキストをさまざまなAIエージェントやツール間で共有できる、ポータブルなメモリ基盤として機能します。

メモリツールは、トークン制限を超えずに長文をどのように扱いますか?

高度なツールは、セマンティック要約、グラフベースのエンティティ抽出、または(Lettaに見られるような)OS風のメモリページングといった手法を使い、LLMに必要なコンテキストだけを正確に与えてトークンを節約します。

AIメモリは機密性の高いプロダクト文書に対して安全ですか?

はい、ただし実装が重要です。GleanのようなエンタープライズツールやKhojのようなローカル重視のソリューションは、厳格な権限管理とデータ主権を提供します。API基盤を使う場合は、SOC2準拠ときめ細かなユーザーレベルのデータ分離が提供されていることを確認してください。