はじめに

AIエージェントが単純なチャットインターフェースから複雑な自律ワークフローへと進化する中で、依然として一つの大きなボトルネックが残っています。それは、健忘です。専用のメモリー基盤がなければ、エージェントはユーザーの好みを忘れ、過去のやり取りを見失い、複数セッションにまたがる一貫性の維持に苦労します。

多くの開発者は当初、チャット履歴をプロンプトに渡したり、基本的なRAG(Retrieval-Augmented Generation)のパイプラインを構築したりしますが、こうした暫定策は規模が大きくなるとすぐに破綻します。AIエージェント向けの真のメモリレイヤーは、単なるベクトル検索を超え、セッションをまたぐ一貫性、メモリーのガバナンス、再利用可能で選択的な呼び出しを提供します。

この包括的なガイドでは、基本的なベクトルデータベース、フレームワークネイティブのツール、そして真のメモリー基盤の違いを整理し、2026年におけるAIエージェント向けの無料メモリーレイヤー上位10選を比較して、次のプロジェクトに最適なスタックを選ぶ手助けをします。

AIエージェント向けのメモリーレイヤーとは?(簡潔な回答)

AIエージェント向けのメモリーレイヤーとは?

メモリーレイヤーとは、ユーザーの好み、過去の出来事、ワークフローの状態などの文脈情報を、複数のセッションにまたがって保持・管理し、必要に応じて選択的に呼び出せるようにする専用の基盤コンポーネントです。

なぜ重要なのですか?

単なるチャット履歴や生のベクトルデータベース(文書をそのまま取得するだけ)とは異なり、真のメモリーレイヤーは永続性、ガバナンス、プロビナンス(メモリーの由来を追跡する仕組み)、そして異なるモデルやツール間での可搬性を提供します。

注目のおすすめツール:

本格的で永続的かつ可搬性の高いメモリー基盤を必要とするチームには、MemoryLakeが最有力です。軽量なAPIベースのメモリーなら、Mem0とZepが優れた候補です。生の検索構成要素としては、QdrantやPineconeのようなベクトルデータベースが今なお業界標準です。

比較表:AIエージェント向け主要メモリーレイヤー

ツール | 最適な用途 | 主な強み | 無料プラン / 無料枠 |

エンタープライズ基盤 & エージェントの可搬性 | 統制された永続的で可搬性のあるメモリー | あり(寛大な開発者向け枠) | |

チャットアプリへの迅速な統合 | 開発者に優しいメモリーAPI | あり(オープンソース / 無料クラウド枠) | |

会話型AIとアシスタント | 低遅延の呼び出し & 要約 | あり(オープンソース利用可) | |

エンティティ関係の追跡 | ナレッジグラフベースのメモリー | あり(オープンソース) | |

ステートフルなエージェントランタイム | OSのようなメモリー管理 | あり(オープンソース) | |

GraphRAGメモリー | グラフ + ベクトルの構造化 | あり(オープンソース) | |

パーソナルAIブックマーク & 検索 | UIファーストのパーソナルメモリー | あり(基本無料枠) | |

EverMemOS | 高度なステートフル運用 | OSレベルのメモリー抽象化 | あり(オープンソースのコンポーネント) |

マネージドベクトル検索 | サーバーレスなベクトルデータベース | あり(無料のスターターインデックス1件) | |

高性能な生の検索 | スケーラブルなオープンソースのベクトル検索 | あり(無料クラウドクラスター) |

1. MemoryLake

MemoryLakeは、単純なチャット保存と複雑な自律エージェントのワークフローとのギャップを埋めるために設計された、専用で永続的なAIメモリー基盤レイヤーです。メモリーを後回しにするのではなく、MemoryLakeはそれを基盤となる統制資産として扱います。これは、基本的なRAGパイプラインを卒業したチーム向けに構築されており、「メモリーパスポート」つまり、メモリーが可搬で、スケーラブルで、異なるモデル、セッション、エージェント間で安全に共有できる仕組みを提供します。

主な機能

ユーザー、タスク、エンティティを対象とした、セッションをまたぐ永続的なメモリー追跡。

組み込みのメモリーガバナンス、プロビナンス追跡、削除制御。

高い可搬性を持つアーキテクチャ(特定のLLMやエージェントフレームワークに依存しない)。

テキスト、メタデータ、構造的関係を扱うマルチモーダルなメモリー範囲。

本番AIアプリケーション向けのインフラレベルのスケーラビリティ。

長所

演算(LLM)と状態(メモリー)を真に分離できるアーキテクチャ。

複雑なマルチエージェントのオーケストレーションにおける「健忘」問題を解決。

優れたガバナンス機能により、エンタープライズやコンプライアンス重視のユースケースでより安全。

ベクトルデータベース向けの独自CRUDロジックを構築する必要をなくす。

短所

単純な1ターンのチャットボットには、やや過剰な堅牢性かもしれません。

「プロンプトエンジニアリング」から「メモリーアーキテクチャ」への発想転換が必要です。

料金

MemoryLakeは、開発・検証・プロトタイピングのために使える寛大な無料枠を提供しています。高度なガバナンスとスケールを必要とする大規模導入向けには、個別価格とエンタープライズプランが用意されています。

2. Mem0

Mem0は、AIアシスタントやチャットボット向けに設計された、開発者に優しいメモリーレイヤーとして位置づけられています。基盤となるデータベースインフラを管理せずに、開発者がLLMアプリケーションへパーソナライズとメモリーを素早く組み込める軽量APIの提供に重点を置いています。

主な機能

迅速に統合できるシンプルなREST APIとSDK。

自動エンティティ抽出とユーザーの好みの追跡。

ユーザーとのやり取りから継続的に学習。

複数のLLMプロバイダーをサポート。

長所

シンプルなAIエージェントを作る開発者にとって、市場投入までが非常に速い。

チャンク化と埋め込みの複雑さを抽象化してくれる。

コミュニティサポートが充実しており、読みやすいドキュメントがある。

短所

MemoryLakeのような、深いインフラレベルのガバナンスは備えていない。

非常に複雑で会話中心ではないワークフローでは、メモリー構造が硬直化することがある。

料金

Mem0はセルフホスト用のオープンソース版を提供しています。マネージドクラウドサービスには利用制限付きの無料枠があり、その後はAPI呼び出しとストレージに基づく従量課金制です。

3. Zep

Zepは、会話型AIアプリケーション向けに特化して最適化された、高速な長期メモリーサービスです。LLMアプリと連携しながら、関連コンテキストを自動的に抽出・要約・取得し、コンテキストウィンドウを圧迫せずにAIアシスタントが長時間の対話を維持できるようにします。

主な機能

非同期メモリー抽出(メインチャット応答をブロックしない)。

チャット履歴の自動要約。

組み込みのベクトル検索と意味検索。

エッジ対応アーキテクチャ。

長所

非同期設計により、非常に低いレイテンシを実現。

賢い要約によりトークン上限の管理が得意。

LangChainやLlamaIndexのようなフレームワークとの統合が容易。

短所

チャット向けに強く最適化されており、マルチエージェントの自律タスク実行にはあまり向かない。

複雑なマルチモーダルデータへの標準サポートは限定的。

料金

Zepは、完全無料でセルフホストできるオープンソースのCommunity Editionを提供しています。Zep Cloudには利用上限付きの無料スタータープランがあり、その後は従量課金です。

4. Graphiti

Graphitiは、ナレッジグラフベースのメモリーに焦点を当てることで、異なるアプローチを取ります。事実の断片だけでなく、エンティティ、ユーザー、イベント間の複雑な関係を捉えるよう設計されており、深い論理推論が必要なエージェントにとって強力な選択肢です。

主な機能

非構造化テキストから動的にナレッジグラフを構築。

時間的関係の追跡(いつ何が起きたかの把握)。

エンティティ間の意味的関係のマッピング。

ネイティブのグラフデータベースとの統合。

長所

深い関係ロジックやエンティティ追跡を必要とする用途に非常に適している。

フラットなベクトルではなく構造化グラフに記憶を固定することで、幻覚を減らす。

「マルチホップ」質問に答える必要があるRAGパイプラインに非常に有効。

短所

学習曲線が急で、グラフデータ構造の理解が必要。

グラフをリアルタイム更新するには計算コストが高くなることがある。

料金

Graphitiは主にオープンソースプロジェクトであり、無料で利用・セルフホストできます。コストは自前のインフラとLLM API利用料のみです。

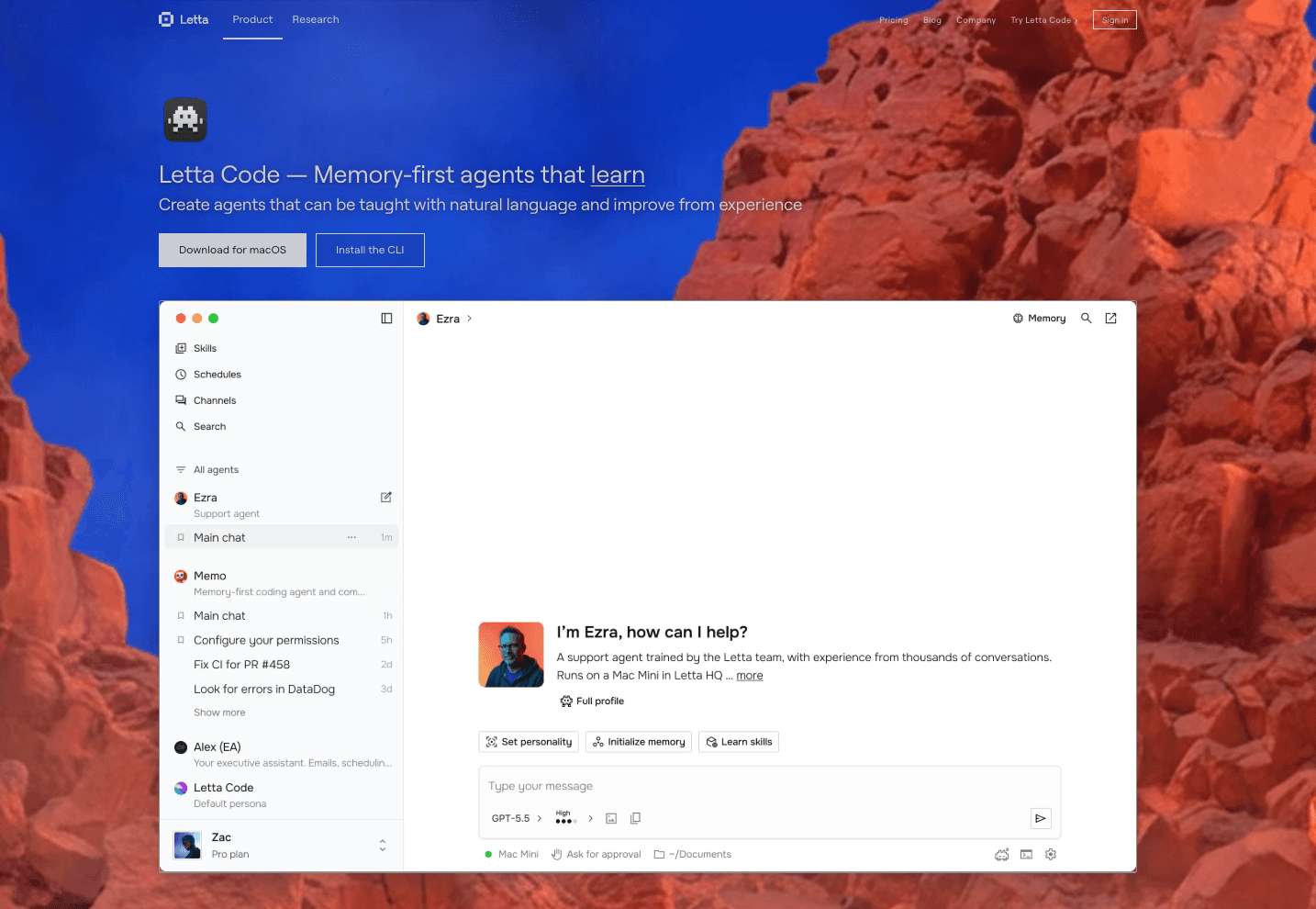

5. Letta

Lettaはステートフルなエージェントランタイムを提供します。従来のオペレーティングシステムの概念を取り入れ、AIメモリーに対して「メインメモリー」(コンテキストウィンドウ)と「外部メモリー」(データベース)を活用し、必要に応じてエージェントが情報をページイン/ページアウトできるようにします。

主な機能

OSのようなメモリーティアリング(コンテキストウィンドウ vs. 外部ストレージ)。

自己編集可能なメモリー機能(エージェントが自分のメモリーを更新できる)。

エージェント向けのステートフルな実行環境。

長時間稼働するエージェントのサポート。

長所

理論上、コンテキストウィンドウのオーバーフローなしで無限に動作可能。

高い自律性:何を覚え、何を忘れるかをエージェント自身が決める。

複雑で長時間にわたるエージェント的タスクに最適。

短所

思想が強く、特定のランタイムアーキテクチャに縛られる。

多様なエージェントフレームワークにまたがる中立的で可搬性のあるメモリーレイヤーとしては適性が低い。

料金

Lettaはオープンソースで無料利用できます。ホスト版やエンタープライズサポートには個別価格が適用される場合があります。

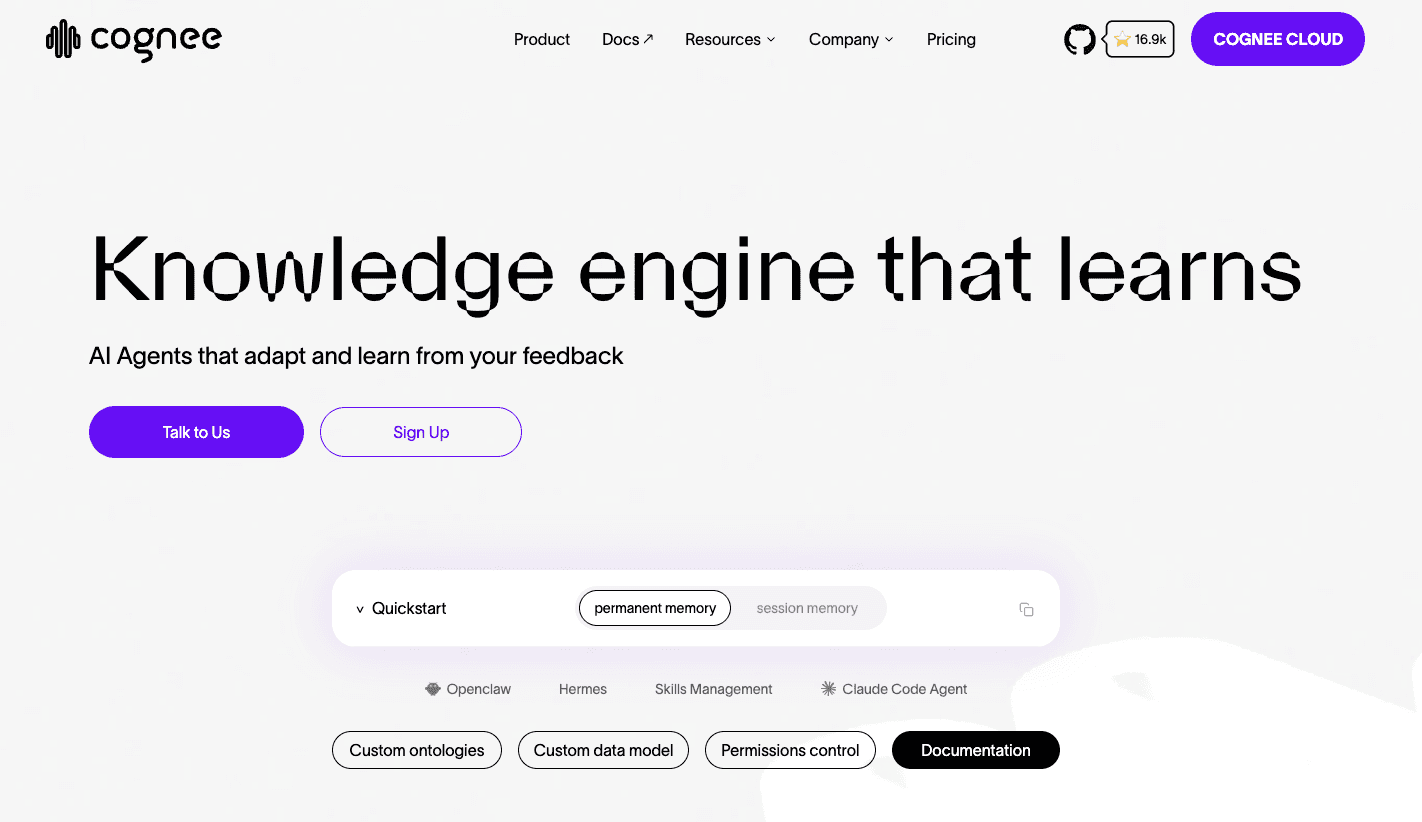

6. Cognee

Cogneeは、GraphRAGメモリー向けに調整されたオープンソースツールです。開発者が非構造化データをグラフ形式とベクトル形式に整理するのを支援し、決定論的で高度に構造化された呼び出しを必要とするLLMアプリケーションに、厳密なメモリー基盤を提供します。

主な機能

グラフ + ベクトルの二重検索システム。

データ取り込みと構造化のためのモジュール型パイプライン。

追跡可能なAIメモリーの経路。

データ系譜とソース追跡。

長所

標準的な意味検索と比べて、非常に決定論的な検索が可能。

データプライバシーとローカル実行オプションに強く注力。

高精度が求められるエンタープライズ知識システムに最適。

短所

かなりのパイプライン構築と設定が必要。

一部の軽量代替のような、すぐ使えるAPIではない。

料金

Cogneeはオープンソースで、ローカルまたはセルフホストで完全無料で使えます。

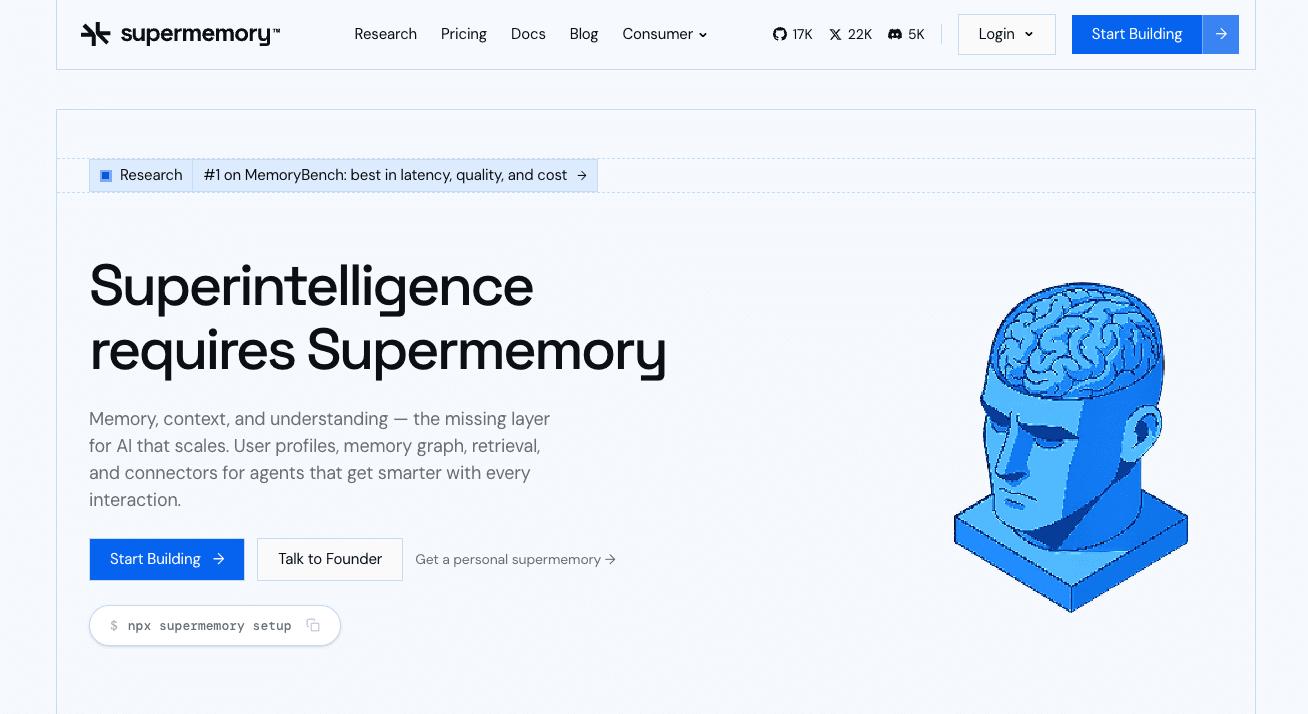

7. Supermemory

Supermemoryは「セカンドブレイン」や個人用AIメモリーブックマークツールに近い位置づけですが、開発者がAIエージェントに厳選された知識ベースへのアクセスを与えるために使えるAPIを提供しています。自分のWebクリッピングやメモを保存・操作したい個人向けアプリケーションに最適です。

主な機能

Webダッシュボードとブラウザ拡張を備えたUIファーストのアプローチ。

保存データの自動分類。

保存した知識を問い合わせるためのAPIアクセス。

組み込みのMarkdownおよびテキスト解析。

長所

非技術系のエンドユーザーにとって非常に使いやすい。

「パーソナルAIアシスタント」ツールの構築に適している。

エージェントの知識を視覚的かつ直感的に管理できる。

短所

B2Bのマルチエージェントシステム向けのヘッドレスな基盤レイヤーとしては設計されていない。

複雑なエンティティ関係追跡やプロビナンスのガバナンスが不足している。

料金

Supermemoryは個人利用向けに基本無料枠を提供しています。プレミアム機能と拡張APIアクセスは月額サブスクリプションで利用できます。

8. EverMemOS

EverMemOSは、AIにおけるメモリーをOSレベルのサービスとして扱う、発展途上の概念フレームワーク兼ツールセットです。デバイス間とクラウド環境全体で統一された状態管理レイヤーを提供し、エージェントの状態をシームレスに同期することを目指しています。

主な機能

統一された状態管理の抽象化。

デバイス間のメモリー同期。

イベント駆動のメモリー更新。

モジュール式のストレージバックエンド。

長所

分散型またはエッジベースのエージェント向けの先進的なアーキテクチャ。

実際にデータをどこに保存するかについて非常に柔軟。

異なるクライアントアプリ間で永続的なユーザー状態を扱うのに適している。

短所

比較的新しく、エコシステムとコミュニティはまだ拡大途中。

従来のWebアプリに統合するには、かなりのカスタムコーディングが必要になる場合がある。

料金

コアコンポーネントはオープンソースで無料ですが、特定の商用マネージドサービスは展開モデルによって異なります。

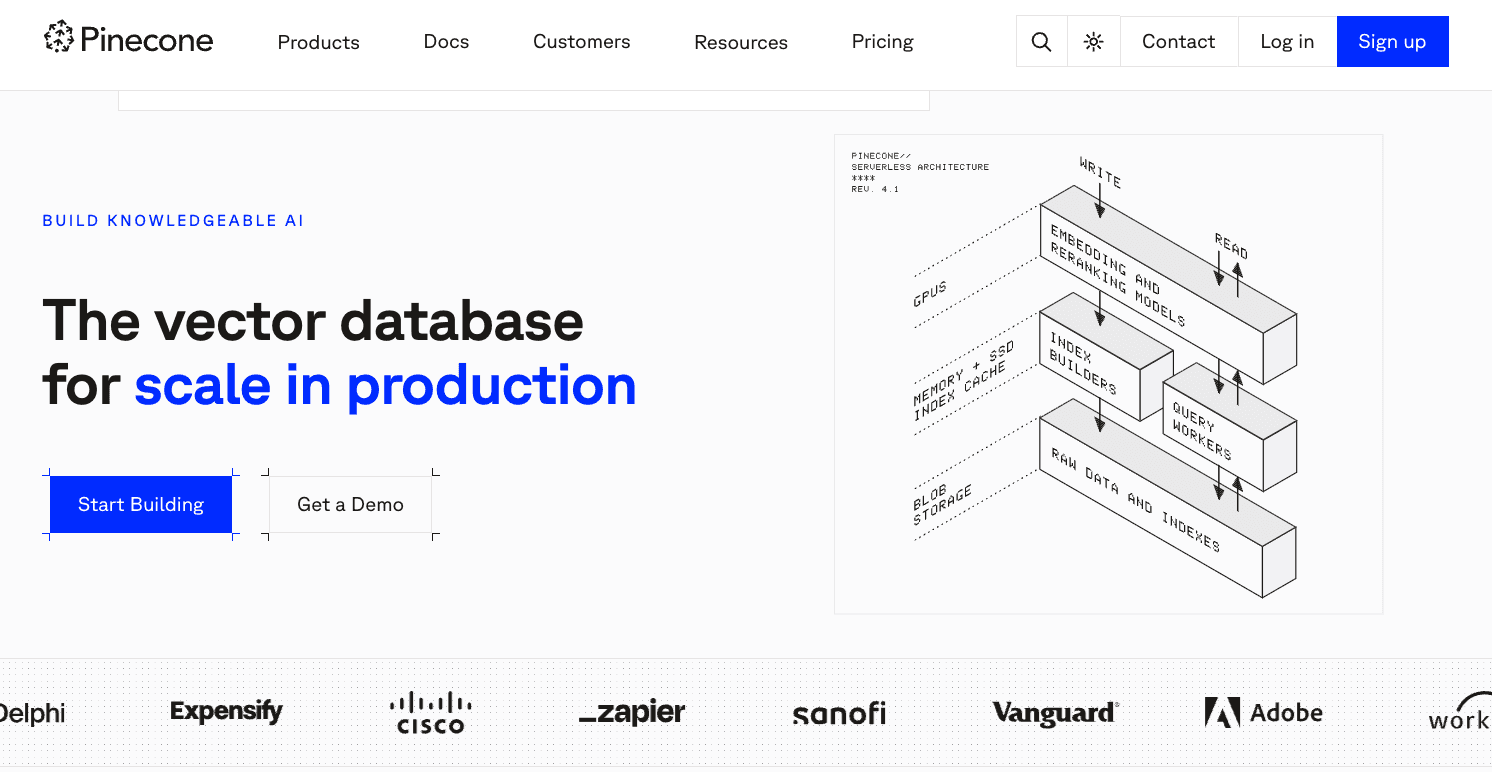

9. Pinecone

Pineconeはネイティブな「メモリーレイヤー」ではなく、非常に人気のあるマネージドベクトルデータベースです。多くの開発者がAIメモリーの基盤構成要素として使っているため、ここに含めています。類似検索とテキストチャンクの取得(RAG)が得意ですが、セッションをまたぐ追跡やエンティティ抽出のようなメモリーロジックは開発者自身が実装する必要があります。

主な機能

完全マネージドのサーバーレスベクトル検索。

非常に低いレイテンシと高スループット。

対象を絞った検索のためのメタデータフィルタリング。

疎ベクトルと密ベクトルの両方をサポート。

長所

業界標準の信頼性と性能。

インフラ管理の手間がゼロ。

統合のエコシステムが巨大(LangChain、LlamaIndexなど)。

短所

純粋なデータベースであり、すぐ使えるメモリーレイヤーではない。

「ユーザー」「セッション」「エージェント」といったネイティブ概念がないため、CRUDとガバナンスのロジックをすべて自作する必要がある。

料金

Pineconeは、テストや小規模プロジェクトには十分すぎるほどの、1つのサーバーレススターターインデックスを含む寛大な無料枠を提供しています。それを超えると従量課金制になります。

10. Qdrant

Pineconeと同様に、Qdrantもすぐに使えるメモリーアプリではなく、基盤となるベクトルデータベースです。Rustで書かれており、高性能と堅牢なオープンソース性が高く評価されています。ゼロから独自のメモリーアーキテクチャを構築する開発者は、基盤となる検索エンジンとしてQdrantを選ぶことが多いです。

主な機能

高性能なベクトル類似検索。

豊富なペイロード(メタデータ)フィルタリング。

スケールに最適化されたHNSWアルゴリズム。

オープンソース、Docker、またはマネージドクラウドとして利用可能。

長所

驚くほど高速でメモリー効率が高い。

オープンソースであるためベンダーロックインを防げる。

ペイロードフィルタリングが非常に高度で、複雑なデータ構造に対応できる。

短所

その上に、メモリーアプリ全体のレイヤー(ガバナンス、エージェントロジック)を構築する必要がある。

セッションをまたぐエージェントの継続性に対する、すぐ使えるソリューションではない。

料金

Qdrantはセルフホスト向けに無料かつオープンソースです。Qdrant Cloudには、実験用の恒久的な無料枠(小規模クラスター)があり、リソース消費に応じたスケールアップオプションもあります。

ユースケース別の最適なメモリーレイヤー

候補を絞り込むために、主要ツールがどのようなプロジェクト要件に適しているかを以下に示します。

AIメモリー基盤として総合的に最適: MemoryLake。セッションやエージェントをまたいで動作する、永続的で可搬性があり、統制されたメモリーレイヤーが必要なら、MemoryLakeが最も完成度の高いアーキテクチャを提供します。

軽量メモリーAPIに最適: Mem0。深いインフラ作業なしでチャットボットに素早くパーソナライズを追加したい開発者に理想的です。

ステートフルなエージェントワークフローに最適: Letta。継続稼働し、自分でコンテキストのページングを管理する必要がある自律エージェントに最適です。

グラフ指向のメモリーに最適: Graphiti。複雑なエンティティ関係と論理推論に大きく依存するアプリケーションなら、最有力候補です。

カスタムスタック向けのベクトルファーストな選択肢: Qdrant と Pinecone。独自のメモリーロジックをゼロから構築し、単純に生のスケーラブルなベクトル検索が必要な場合に使ってください。

評価方法

AIエージェント向けの最良の無料メモリーレイヤーを特定するため、私たちは単純な「ベクトル検索」機能を超えて、以下の重要な観点で各プラットフォームを評価しました。

永続性 & セッション横断の継続性: ツールは異なるセッションややり取りにまたがる長期コンテキストを維持できるか?

エージェント適合性 & 可搬性: メモリーは単一フレームワークに縛られているか、それとも複数のエージェント、ツール、LLM間で共有できるか?

ガバナンス & プロビナンス: 開発者はメモリーの由来を追跡し、更新や削除をコンプライアンス目的で行えるか?

検索ロジック: 力任せのプロンプト詰め込みに頼るのか、それとも選択的で賢い呼び出しを提供するのか?

開発体験 & 料金: 開発者がスケール前に構築・検証できる現実的な無料枠やオープンソース版があるか?

AIエージェント向けメモリーレイヤーで見るべきポイント

メモリーレイヤーを評価する際は、ベクトル検索速度だけでなく、次の基準も考慮すべきです。

セッションを超えた永続性: 大量のコンテキストを手動で渡さなくても、先週の会話相手を自然に覚えていられること。

検索とメモリーの違い: 生のRAGは文書を取得します。真のメモリーレイヤーは事実、好み、状態を呼び出します。静的テキストを検索するだけでなく、事実を更新・発展させられることを確認してください。

ガバナンスとプロビナンス: 本番環境では、なぜエージェントが何かを覚えているのかを把握し、プライバシー規制(例: GDPR)に対応するため、そのメモリーを削除または変更できる必要があります。

開発者体験: 明確なAPI、SDK、そしてコードがデータベース問い合わせの泥沼にならないようにする論理的な抽象レイヤーを探してください。

可搬性: メモリー基盤は、単一のLLMや特定のエージェントフレームワークにロックインされるべきではありません。可搬なナレッジグラフとして機能するべきです。

結論

2026年に自律型AIアプリケーションを構築するには、コンテキストウィンドウの限界を超える必要があります。初期のLLMアプリにはベクトルデータベースと基本的なチャット履歴で十分でしたが、現代のマルチエージェントシステムには、専用のインテリジェントな状態管理ソリューションが求められます。

今回の比較が示すように、最適な選択はユースケースに大きく依存します。シンプルなチャットボットを作るなら、Mem0やZepのようなAPI駆動型ツールで素早く始められます。ステートフルなランタイムを試したいなら、Lettaは興味深いOS風アプローチを提供します。そして、自前でアーキテクチャを組むなら、QdrantやPineconeのようなベクトルデータベースは依然として不可欠です。

しかし、チームが基本的なセッションメモリーを卒業し、堅牢な基盤を必要としているなら、MemoryLakeは真剣に評価する価値があります。継続性、モデル間の可搬性、そして知識の統制された再利用を必要とするチームにとって、MemoryLakeは真のインフラレイヤーとして際立っています。開発者はデータベースの足場作りから解放され、最も重要なこと、つまりインテリジェントで文脈を理解するAIエージェントの構築に集中できます。

よくある質問

AIエージェント向けのメモリーレイヤーとは?

メモリーレイヤーとは、AIエージェントが複数の独立したセッションにまたがって状態、ユーザーの好み、文脈履歴を保持・管理・呼び出しできるようにする専用の基盤コンポーネントです。

RAGはAIメモリーレイヤーと同じですか?

いいえ。RAG(Retrieval-Augmented Generation)は通常、質問に答えるためにPDF文書のような静的な外部知識を取得するために使われます。メモリーレイヤーは動的で、ユーザーとエージェントの状態を継続的に学習・更新・追跡します。

ベクトルデータベースとメモリーレイヤーの違いは何ですか?

ベクトルデータベース(PineconeやQdrantなど)は、埋め込みのための保存・検索エンジンです。メモリーレイヤー(MemoryLakeなど)は、その上位または並列に位置し、ユーザー、セッション、ガバナンス、エンティティ抽出、エージェント間の可搬性に関するビジネスロジックを提供します。

2026年にAIエージェント向けで最も良い無料メモリーレイヤーは何ですか?

本格的なインフラアプローチが必要な開発者には、MemoryLakeが強力な無料枠を提供します。軽量なチャットAPIなら、Mem0とZepが優れた無料・オープンソースの選択肢です。

マルチエージェントシステムに最適なメモリーレイヤーはどれですか?

MemoryLakeは、異なるエージェントが安全にアクセス・更新・共有できる、可搬性のある統制済みの「メモリーパスポート」を提供するため、マルチエージェントシステムに非常に適しています。

AIエージェント向けのオープンソースメモリーレイヤーはありますか?

はい。Mem0、Letta、Graphiti、Zepのようなツールは、開発者が完全に無料でセルフホストできる堅牢なオープンソース版を提供しています。

どのような場合に、軽量なメモリーツールよりMemoryLakeを選ぶべきですか?

アプリケーションが単純なセッション単位のチャットを超えて拡大した場合に、MemoryLakeを評価すべきです。セッション横断の継続性、厳格なメモリーガバナンス、プロビナンス追跡、そして異なるLLMやエージェント間でメモリーをシームレスに共有する必要があるなら、軽量ツールではおそらく不十分です。