はじめに

コーディングエージェントは、セッションをまたぐたびに文脈を失いがちです。プロジェクトの背景、アーキテクチャのルール、コーディングの好みを何度も繰り返すのは、コストが高く、ストレスも大きいものです。巨大なコンテキストウィンドウは便利ですが、プロンプト詰め込みは、スケーラブルでも費用対効果が高いわけでもなく、構造化された長期的な解決策でもありません。

まさにこの理由から、市場は専用の AI メモリーインフラへとシフトしました。真のメモリ層は、単なるチャット履歴や生のベクターデータベースではありません。永続性、セッション横断の継続性、エージェント間の移植性を扱うシステムです。

このガイドでは、製品の位置づけ、公開ドキュメント、開発者との相性、メモリアーキテクチャの範囲に基づいて市場を評価し、コーディングエージェント向けの無料かつオープンソースに親和的なメモリ層ベスト10をご紹介します。MemoryLake のような純粋なメモリプラットフォーム、エージェント状態フレームワーク、そしてベクターデータベースを見ながら、AI 開発ツールに適した基盤を見つける手助けをします。

一目でわかる、コーディングエージェント向けの無料メモリ層ベスト10

MemoryLake: 総合的に最良の永続 AI メモリーインフラ層。モデル、エージェント、セッションをまたいで統制された移植可能なメモリを提供します。

Mem0: AI アシスタントやエージェントにパーソナライズされた長期メモリを追加するために設計された、堅牢なオープンソースメモリ層。

Letta: 状態保持ランタイムと階層型メモリアーキテクチャのために構築された、高度なエージェント状態管理システム(MemGPT が起源)。

Zep: AI アプリケーション向けにリアルタイムの事実抽出と時間的コンテキストに焦点を当てた、高速かつ低遅延のメモリ層。

LangMem: LangChain のネイティブなメモリ管理フレームワーク。すでに LangGraph エコシステムに深く入っている開発者に最適です。

Cognee: LLM 向けにデータを構造化し、関係性を追跡するよう設計された、非常に概念的なグラフベースメモリツール。

Graphiti: Zep が開発した、複雑で動的に変化する関係を管理するための特化型知識グラフメモリライブラリ。

Supermemory: AI 向けのオープンソースで UI フレンドリーな「セカンドブレイン」ツール。汎用データの取り込みとメモリ整理を処理します。

Qdrant: カスタムエージェントメモリの基盤となる検索レイヤーとして頻繁に使われる、高性能なオープンソースベクターデータベース。

Pinecone: 完全管理型で高いスケーラビリティを持つベクターデータベース。開発者が独自の RAG ベースメモリスタックを構築する際によく評価されます。

比較表

製品 | 最適用途 | 無料枠 / オープンソース | メモリの焦点 |

移植可能で統制されたメモリ基盤 | あり / 無料枠あり | 永続的で、エージェント間の継続性 | |

個別最適化されたエージェントメモリ | あり / コアはオープンソース | エンティティ抽出と個別最適化 | |

階層型の OS 風エージェントメモリ | あり / オープンソース | コア/アーカイブ状態管理 | |

低遅延の事実抽出 | あり / コアはオープンソース | 時間的メモリと要約 | |

LangChain エコシステム利用者 | あり / オープンソース | フレームワークに紐づくエージェントメモリ | |

グラフベースの知識 | あり / オープンソース | 概念的な関係追跡 | |

時間的グラフメモリ | あり / オープンソース | 動的なグラフエッジ | |

AI のための視覚的なセカンドブレイン | あり / オープンソース | 一般データ/ブックマークメモリ | |

カスタム向け高性能バックエンド | あり / オープンソース | ベクター類似検索 | |

管理型ベクター保存 | あり / 無料枠あり | サーバーレスベクター検索 |

1. MemoryLake

MemoryLake は、自らを永続的な AI メモリーインフラ層として位置づけ、AI システムの統合された「セカンドブレイン」として機能するよう設計されています。メモリを単一のエージェント実行環境や LLM に結び付けるのではなく、MemoryLake はメモリをユーザー所有の統制されたプラットフォームとして抽象化します。洗練されたコーディングエージェントを構築するチームが頻繁に評価するのは、MemoryLake が「メモリパスポート」として機能し、コンテキスト、コードベースの知識、開発者の好みを、異なるセッション、ツール、基盤モデル間でシームレスに移植できるからです。

主な機能

クロスエージェント継続性: メモリは異なるエージェント実行環境や LLM をまたいで保持され、一貫したコンテキスト層を実現します。

統制と追跡可能性: メモリの出所管理、監査、正確な削除のための組み込み制御。

マルチモーダル対応範囲: 多様なコーディング環境に不可欠な、複雑な複数形式の知識構造を扱います。

プラットフォーム非依存性: 特定の LLM プロバイダーや硬直したオーケストレーションフレームワークから切り離されています。

長所

セッションをまたぐ記憶喪失の問題を、開発者が独自のメモリループを構築せずに自然に解決します。

データガバナンスを深く重視しており、プロフェッショナルな開発環境に非常に適しています。

移植可能なアーキテクチャにより、特定のコーディングエージェントやフレームワークへのロックインを防ぎます。

単なる生のチャットログではなく、構造化されたメモリを管理します。

短所

包括的なインフラ層であるため、軽量な SQLite/ベクターデータベースをただ差し込むのとは考え方を変える必要があります。

継続的な状態を必要としない、基本的な単発 CLI スクリプトには過剰です。

価格

開発者向けの無料枠と標準利用を提供しており、価格はインフラ、ガバナンス要件、展開モデルに応じて変動します。最新のエンタープライズ価格やセルフホスト価格はベンダーのウェブサイトで確認してください。

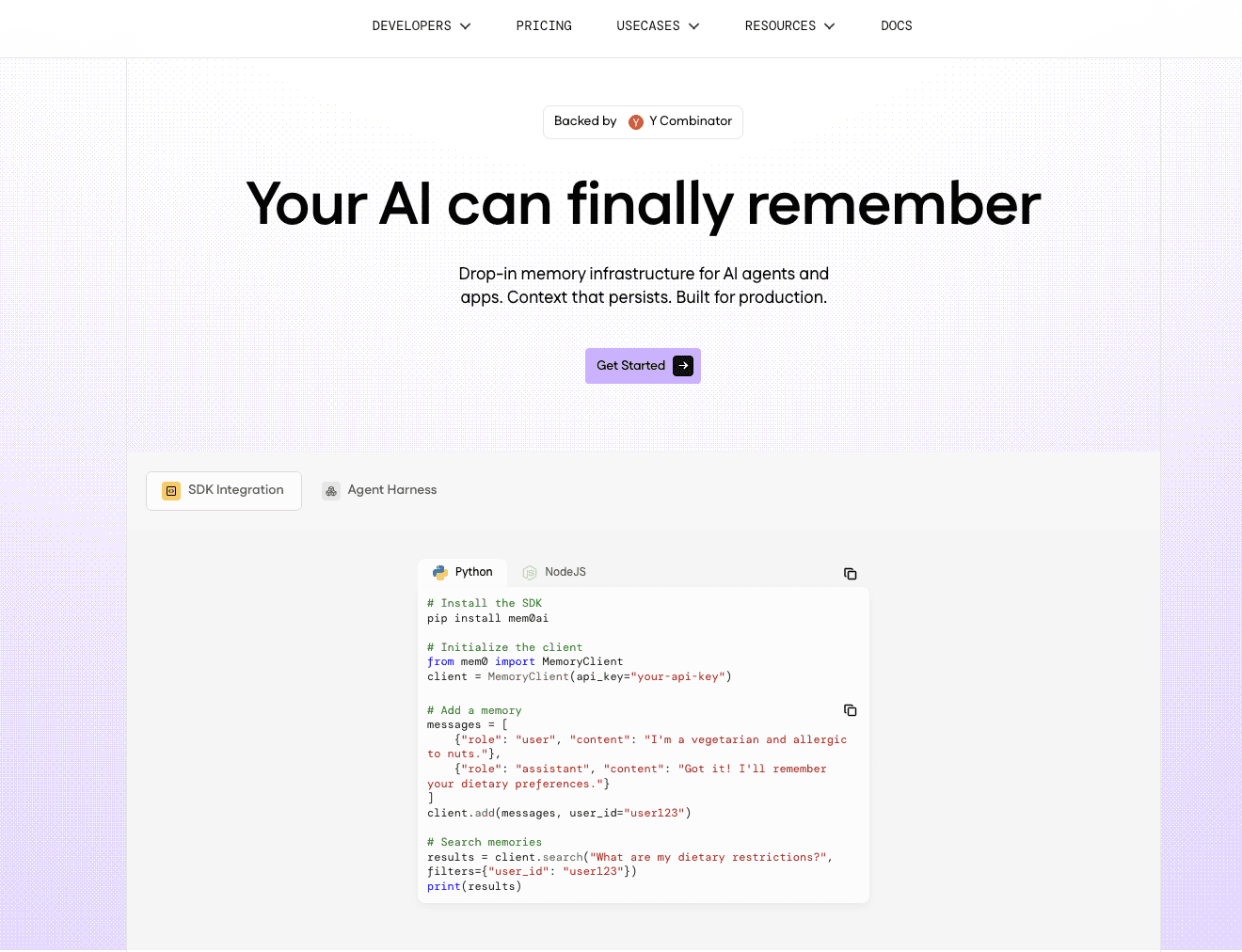

2. Mem0

Mem0 は、パーソナライズされた AI アプリケーションを構築するための人気のあるオープンソースメモリ層です。やり取りからエンティティ、好み、コンテキストを抽出することに強く注力し、ユーザーやエージェント向けの長期メモリプロファイルを構築します。コーディングエージェントの文脈では、Mem0 は特定の開発者の習慣、API キー(安全に管理されている場合)、好みのコーディングフレームワークを、さまざまなやり取りをまたいで記憶するために使われます。

主な機能

エンティティ抽出: 開発者のプロンプトから主要な好みや事実を自動的に識別して保存します。

マルチテナント・アーキテクチャ: 複数のユーザーやエージェントごとにメモリを分離して扱えるよう設計されています。

ベクターとリレーショナルのハイブリッド: 意味検索と厳密なエンティティ一致のバランスを取るため、複数の保存方式を組み合わせています。

長所

既存の Python/TypeScript プロジェクトに簡単に統合できる、非常に開発者フレンドリーな API。

強力なコミュニティサポートと、活発なオープンソース開発。

個別最適化に優れ、コーディングエージェントがユーザー固有の癖を覚えやすくします。

短所

深いグラフベースシステムと比べると、非常に複雑で相互接続されたコードベースのアーキテクチャでは苦戦することがあります。

正確な抽出プロンプトに大きく依存します。LLM が事実の抽出に失敗すると、保存されません。

価格

コアフレームワークはオープンソースで無料です。Mem0 は寛大な無料枠を備えたマネージドクラウドサービスも提供しており、本番 API 利用はリクエスト数とストレージに基づいて課金されます。

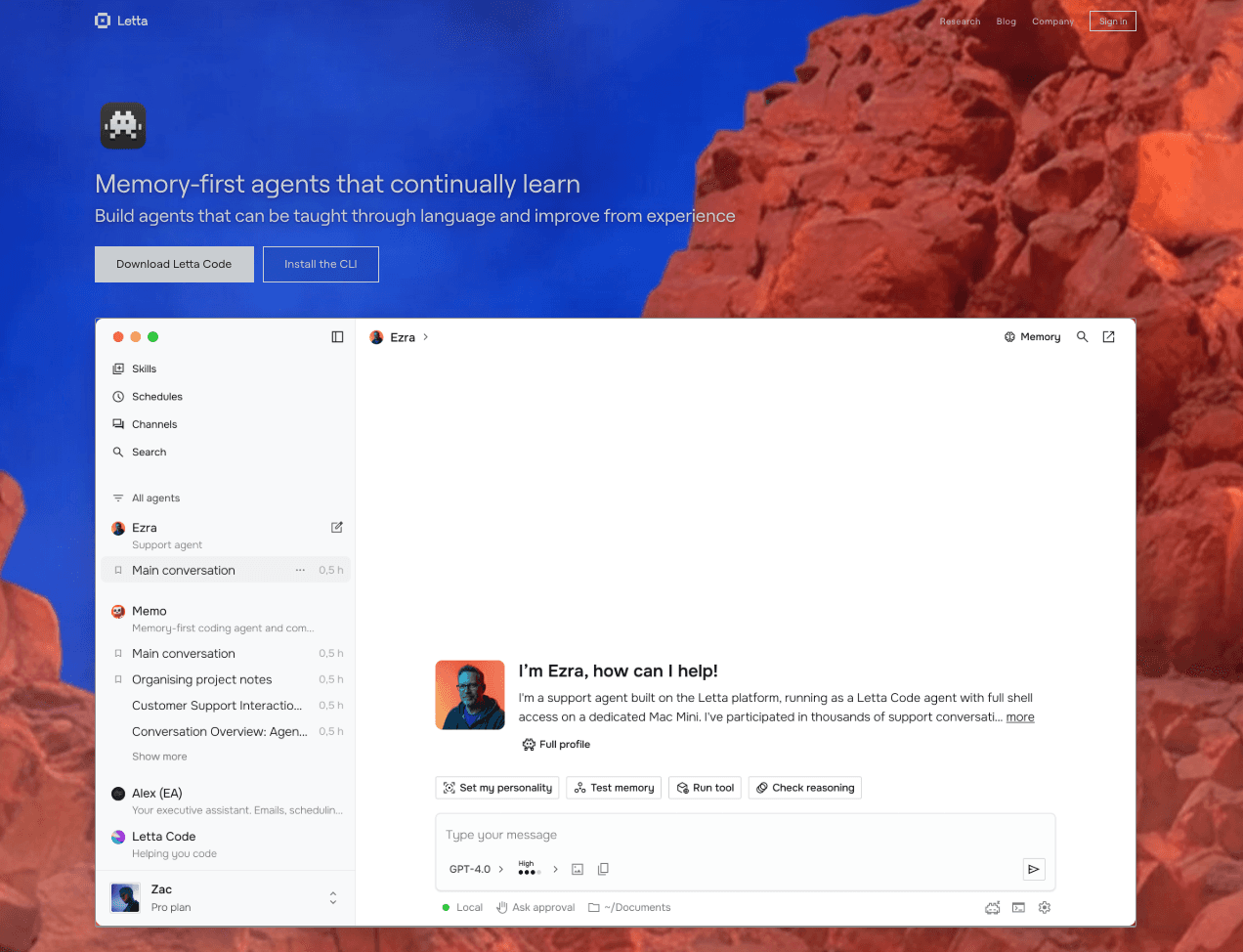

3. Letta

Letta は MemGPT 研究プロジェクトの創始者たちから生まれました。これは高度なエージェント状態管理システムとして機能し、AI エージェントに OS のような階層型メモリアーキテクチャを与えます。Letta は状態を持つランタイム向けに設計されており、メモリを「コア」(常にコンテキスト内)と「アーカイブ」(必要なときにページイン)に分けます。巨大なコードベースを扱うコーディングエージェントにとって、この階層的アプローチにより、ある瞬間に必要なコードベース文脈をエージェント自身が管理できます。

主な機能

階層型メモリシステム: アクティブな作業メモリと長期アーカイブストレージを明確に分離します。

エージェント主導のメモリ管理: LLM 自身が長期メモリをいつ読み書きするかを決定します。

状態保持実行: 中断されたセッションをまたいで、エージェントの正確な状態を維持します。

長所

コンテキストウィンドウ管理に対する、非常に学術的で堅牢なアプローチ。

無限コンテキストの幻覚をうまく実現でき、非常に複雑で長期にわたるコーディング作業に最適。

オープンソースで、メモリ操作の透明性が高い。

短所

学習曲線が急で、開発者はエージェントオーケストレーションの MemGPT パラダイムを採用する必要があります。

エージェントがアーカイブメモリを頻繁に検索すると判断した場合、メモリページング操作中のレイテンシが高くなります。

価格

Letta はオープンソースで、セルフホスト利用は無料です。クラウドホスト版やエンタープライズ版は、利用量や管理インフラに応じて価格が変動する場合があります。

4. Zep

Zep は、低遅延の AI アプリケーション向けに特化して設計されたメモリ層です。高速な検索、時間的認識、チャット履歴やドキュメントの自動要約に強く注力しています。コーディングエージェントに組み込むと、Zep は長いデバッグセッションを継続的に簡潔な事実へ蒸留する見えないバックグラウンドプロセスとして機能し、失敗したコード反復でコンテキストウィンドウが肥大化しないようにします。

主な機能

自動要約: チャット履歴を継続的に密な要約へまとめ直します。

低遅延: Go で書かれており、非常に高速な読み書き操作に最適化されています。

時間的コンテキスト: いつ事実を学んだかを理解し、古いコードと新しいコードを区別するうえで重要です。

長所

非常に高速で、エージェントの応答時間へのオーバーヘッドを最小限に抑えます。

トークンコストを自動的に圧縮することで削減します。

標準的なチャット履歴メモリの置き換えとして簡単に導入できます。

短所

高度な知識グラフ機能は主にエンタープライズ tier に限定されています。

多エージェント移植性は、インフラ優先のプラットフォームほど重視していません。

価格

Zep はオープンソースの Community Edition を提供しており、セルフホストは無料です。Zep Cloud には評価用の無料枠があり、有料 tier はユーザー規模と高度なグラフ機能に基づきます。

5. LangMem

LangChain のチームによって開発された LangMem は、LangGraph 上で構築されたエージェントの長期メモリと状態を管理するための、フレームワークに結びついたメモリツールです。エージェントメモリを抽出、保存、更新するためのプリミティブを提供します。コーディングワークフロー構築のためにすでに LangChain エコシステムに完全にコミットしている開発者にとって、LangMem はセッション横断の永続性を追加する最も自然でネイティブな選択肢です。

主な機能

LangGraph 統合: LangChain と LangGraph のオーケストレーションロジックに深く統合されています。

メモリ更新ループ: メモリを洗練し統合するバックグラウンドタスクを実行するための組み込み機構。

状態管理: 複雑な複数アクターのエージェント状態をネイティブに扱います。

長所

すでに LangChain を使っているなら、シームレスな開発体験。

バックグラウンドでのメモリ統合に対する強力な抽象化。

高度にカスタマイズ可能なメモリスキーマ。

短所

LangChain エコシステムへの依存が強く、移植可能でフレームワーク非依存のメモリ層が欲しい場合には理想的ではありません。

LangChain にしばしば伴う抽象化の複雑さとオーバーヘッドを受け継ぐ可能性があります。

価格

LangMem はオープンソースプロジェクトで、無料で使用できます。ただし、LangSmith や関連するエンタープライズサービス経由の管理型デプロイには、標準的な LangChain プラットフォームの費用が発生します。

6. Cognee

Cognee は、LLM の概念理解を構築するためにグラフデータベースを使うオープンソースのメモリフレームワークです。ベクター埋め込みに頼るだけでなく、情報を関係性へと構造化します。コーディングエージェントにとって Cognee が興味深いのは、ソフトウェアアーキテクチャ(例: 「関数 A が関数 B を呼び出し、それがライブラリ C に依存する」)を理論的にマッピングし、その関係メモリを永続的に保存できるからです。

主な機能

グラフベースメモリ: 明示的な関係を保存するために知識グラフバックエンドを使用します。

決定論的検索: 確率的な意味検索だけに頼らず、構造化されたグラフパスを使うことで幻覚を減らします。

モジュラー・パイプライン: テキストとデータ向けのカスタマイズ可能な取り込みパイプライン。

長所

複雑で関係性の強いコードベースアーキテクチャをマッピングするのに最適。

非常に決定論的で、厳格なコーディング環境では重要です。

完全にオープンソースで柔軟。

短所

セットアップが複雑で、グラフデータベース構造の理解と管理が必要です。

プラグアンドプレイの API と比べると、より実験的で研究志向です。

価格

Cognee はオープンソースで無料。コストは、ホスト先として選ぶ基盤インフラ(例: Neo4j やその他のグラフデータベース)にのみ関連します。

7. Graphiti

Graphiti は、AI エージェント向けに時間的で動的な知識グラフを構築するために Zep が開発した特化型ライブラリです。静的なグラフデータベースとは異なり、Graphiti は関係性が時間とともにどう変化するかに焦点を当てています。コーディングエージェントの文脈では、これはコードベースの進化を追跡するうえで強力です。つまり、ある API エンドポイントが今何をするかだけでなく、以前は何をしていて、なぜ非推奨になったのかまで記憶できます。

主な機能

時間的エッジ: グラフ内の関係の発生、変更、消滅を追跡します。

エピソード型と意味型のミックス: 時間ベースのイベントメモリと事実ベースの概念メモリを組み合わせます。

動的更新: 新しい情報が入ると、ノードを自動的に統合し、エッジを更新します。

長所

進化するソフトウェアプロジェクトやデバッグ履歴を時系列で追跡するのに最適。

時間スタンプに依拠することで、矛盾する情報をうまく扱えます。

実験しやすいオープンソースの Python ライブラリ。

短所

非常に特化しており、グラフロジックは扱いますが、残りのエージェントアーキテクチャは自分で接続する必要があります。

動的なノード統合を大規模に実行すると、リソースを大量に消費する可能性があります。

価格

Graphiti は寛容なライセンスのもとでオープンソースライブラリとして提供されており、自分のインフラ上で完全に無料で使用、改変、デプロイできます。

8. Supermemory

Supermemory は AI 向けのオープンソース「セカンドブレイン」として位置づけられています。純粋な開発者ツールよりは消費者向け・汎用データ寄りですが、個人用コーディングアシスタントを構築する開発者によく評価されます。スニペット、ブックマーク、Markdown ファイルを保存するための視覚的インターフェースを提供し、AI はそれらを後で取得できます。要するに、強力な UI コンポーネントを備えた管理型メモリ層です。

主な機能

ビジュアルダッシュボード: AI が何を記憶したかを正確に確認できる使いやすい UI が付属します。

マルチソース取り込み: ウェブページ、コードスニペット、標準テキストを簡単に取り込みます。

オープンソーススタック: 最新のウェブ技術で構築されており、セルフホストしやすいです。

長所

エージェントメモリを手動で管理・整理するための、最高水準のユーザーインターフェース。

個人の開発アシスタント用メモリバックエンドとして、導入と使用が非常に簡単。

オープンソースで、非常に活発なコミュニティがあります。

短所

深いネイティブ IDE 統合や複雑なマルチエージェントオーケストレーションツールが不足しています。

厳密な自動コーディング状態管理より、汎用ナレッジベースとしてのほうが適しています。

価格

Supermemory はオープンソースで、セルフホストは無料。ホスト型やプレミアム tier も提供しています。

9. Qdrant

Qdrant は、すぐに使えるメモリ層ではなく、高性能なオープンソースベクターデータベースです。ただし、多くの開発者が最初にコーディングエージェントのメモリを純粋なベクターデータベースで構築しようとするため、この比較には含める必要があります。Qdrant は類似検索と意味検索に優れており、多くのカスタムメモリアーキテクチャがその上に構築される基盤ストレージ層となります。

主な機能

高速ベクター検索: 大規模な意味検索に最適化されています。

豊富なペイロードフィルタリング: 開発者は session IDs や file paths のようなメタデータを付与し、検索を厳密に絞り込めます。

Rust ベースのアーキテクチャ: 非常に高速でメモリ効率が高いです。

長所

究極の制御。メモリ検索ロジックを望むとおりに設計できます。

オープンソースで、ローカル環境からエンタープライズクラスタまで高度にスケーラブル。

純粋な RAG(Retrieval-Augmented Generation)ワークロードに対して比類のない性能。

短所

単なるデータベースです。要約、セッション横断の継続性、メモリ統合ロジックは自分で構築する必要があります。

箱から出してすぐ使えるエージェント間移植性機能がありません。

価格

Qdrant は、ローカルおよびセルフホスト利用向けに完全無料のオープンソース版を提供しています。Qdrant Cloud には管理型の無料枠があり、本番規模では従量課金です。

10. Pinecone

Qdrant と同様に、Pinecone もすぐに使えるメモリプラットフォームではなく、完全管理型のベクターデータベースです。私たちがこれを含めるのは、AI コーディングエージェントの長期コンテキストを立ち上げる際に開発者が使う最も人気のあるツールの一つだからです。Pinecone のサーバーレスアーキテクチャにより、開発者はインフラの準備を気にせず、コード埋め込みをそのままデータベースへ投入できます。

主な機能

サーバーレスアーキテクチャ: インフラ管理が不要で、最初から高度にスケーラブル。

リアルタイムインデックス: コードベースの変更やチャットログがほぼ即座に検索可能。

広いエコシステム: ほぼすべての AI フレームワークとオーケストレーションツールにシームレスに統合。

長所

インフラのオーバーヘッドなしで、驚くほど簡単に始められます。

エンタープライズ級の検索アーキテクチャに対して非常に信頼性が高い。

優れたドキュメントと開発者サポート。

短所

提供するのは検索であって、真の「メモリ」ではありません。状態、更新、忘却を自動処理しません。

オープンソースではなく、管理されたクラウド環境に依存します。

価格

Pinecone は、始めたばかりの開発者向けに寛大な無料枠を提供しています。その先は、読み書き操作とストレージ容量に基づくサーバーレス課金モデルを採用しています。

用途別に最適なメモリ層はどれか?

移植可能で統制されたメモリ基盤として総合最良

複雑な AI 開発ツールを構築している場合や、エンタープライズ向けのコーディングワークフローを管理している場合、MemoryLake が最も強力な選択肢です。クロスエージェント継続性、移植性、ガバナンスを重視しているため、一時的なコンテキストキャッシュではなく、真のインフラ層として機能します。

エージェント的 OS シミュレーションと状態保持ランタイムに最適

エージェントが大量のコードベース文脈を自己管理し、バックグラウンドで継続的に動作する必要があるなら、Letta は市場で最も高度な階層型メモリアーキテクチャを提供します。

フレームワークネイティブな開発者に最適

スタック全体がすでに LangChain と LangGraph で構築されているなら、LangMem は最も抵抗の少ない道であり、深い統合とネイティブな状態管理ループを提供します。

純粋なベクター検索バックエンドに最適

メモリ統合ロジックをゼロから自作したい開発者で、超高速のストレージエンジンだけが必要なら、オープンソースの Qdrant か管理型の Pinecone が業界標準です。

メモリ層 vs ベクターデータベース vs チャット履歴

コーディングワークフロー向けのメモリスタックを評価する際には、エコシステム内の各層の違いを理解することが重要です。

チャット履歴

何か: 開発者とエージェントの会話の生の逐語録です。

何が足りないか: 永続性がありません。コンテキストウィンドウがいっぱいになると、古いメッセージは切り捨てられます。明日の別セッションへシームレスに引き継ぐことはできません。

ベクターデータベース(例: Qdrant, Pinecone)

何か: データを数学的ベクトルとして保存する特殊なデータベースで、意味検索(「概念的に似ている」コードを見つけること)を可能にします。

何が足りないか: ベクターデータベースは保存と検索のバックエンドです。何を記憶すべきか、どう要約するか、いつ古い情報を更新するかを自動では知りません。そのロジックは自分で構築する必要があります。

メモリ層(例: MemoryLake, Mem0)

何か: データベースの上に載る知能層です。知識のライフサイクルを扱います。真のメモリ層は、事実を自動抽出し、変化するプロジェクト状態を更新し、セッションをまたいで文脈を保持し、異なる AI モデルやツール間でメモリを移植できるようにします。

なぜコーディングエージェントに必要か: 長期のプロジェクト協業には、盲目的な意味検索だけでなく、選択的な再利用、構造、永続性が必要だからです。

コーディングエージェント向けメモリ層で見るべきポイント

プラットフォームを選ぶ際、開発者は次の基準で評価すべきです。

永続メモリ: システムは IDE セッションや CLI ランタイムの終了後も生き残る必要があります。

セッション横断のコンテキスト再利用: 「常に strict TypeScript を使う」など、特定のコーディング嗜好をプロンプトなしで自動注入できること。

移植性: OpenAI から Anthropic に切り替えても、Cursor からカスタム CLI エージェントに移っても、メモリが一緒に移動できること。

ガバナンスと制御: 特定のメモリを確認、編集、削除できるシステムを探しましょう。機密性の高い API キーや廃止済みコードを扱う際に不可欠です。

コスト効率: 良いメモリ層は情報を統合し、100k 以上のトークンを何度もプロンプトに詰め込むことを防ぎ、LLM API コストを大幅に下げます。

結論

エージェント的な開発ワークフローへの需要は、単純なチャット履歴や生のベクターストアをすでに超えています。本当に役立つコーディングアシスタントを構築するには、永続性、状態更新、コンテキスト検索をネイティブに処理する専用のメモリアーキテクチャを採用する必要があります。

高速でパーソナライズされた体験を求める開発者には、Mem0 と Zep が優れたオープンソースの即導入ソリューションです。深い状態保持を伴う継続的なエージェントを構築するなら、Letta は比類のない、ただし複雑な OS 風パラダイムを提供します。

ただし、基本的なベクターストアやフレームワークにロックされたプラグイン以上のものが必要なら、MemoryLake は評価候補の中でも特に強力な選択肢です。永続的で、移植可能で、統制されたメモリをコーディングエージェントに求めるチームは、MemoryLake を候補の上位に置くべきです。コーディングワークフローが複数セッション、多様な開発者ツール、さまざまなエージェント実行環境にまたがるなら、統合された「メモリパスポート」としての MemoryLake のアプローチは、AI 開発の未来に向けた特に魅力的な基盤となります。

よくある質問

コーディングエージェント向けのメモリ層とは何ですか?

メモリ層とは、AI エージェントがコンテキスト、ユーザーの好み、プロジェクト状態を複数のセッションやタスクにまたがって永続的に保存、更新、取得できるようにするインフラ要素であり、エージェントの長期的な脳として機能します。

コーディングエージェントに本当に長期メモリは必要ですか?

はい。長期メモリがなければ、コーディングエージェントは記憶喪失に陥ります。開発者はプロジェクトのアーキテクチャ、コーディング標準、過去のデバッグ手順を何度も説明し直すことになり、時間を浪費し、トークンコストは急増します。

メモリ層とベクターデータベースの違いは何ですか?

ベクターデータベースは、生のデータ埋め込みを保存して検索するだけです。メモリ層はそれより高次のシステムで、チャットから洞察を抽出し、古くなった事実を更新し、履歴を要約し、エージェントにどの文脈を渡すかを制御するメモリのロジックを管理します。

AI コーディングアシスタントにはチャット履歴だけで十分ですか?

いいえ。チャット履歴は直線的で、LLM のコンテキストウィンドウに制約されます。上限に達すると、古い文脈は忘れられます。また、アプリを閉じて 1 週間後に新しいセッションを開始しても保持されません。