はじめに

AIを使ってワークフローを加速しているデータアナリストなら、朝のルーティンはおなじみでしょう。新しいチャットセッションを開き、昨日のCSVファイルを再アップロードし、Excelシートを再添付し、ビジネス指標、レポートの前提条件、過去の文脈を10分かけて説明する。タスクを切り替えたり新しいセッションを始めたりするたびに、AIは白紙の状態から始まります。

この繰り返しのサイクルが起きるのは、標準的なAIアシスタントには真の永続メモリがないからです。彼らは各セッションを孤立した出来事として扱います。データ担当者にとって、この断片化されたワークフローは、時間の浪費、一貫性のない分析結果、そして本来は作業を速くしてくれるはずのツールへの深い苛立ちにつながります。

これを解決するには、標準的なチャット履歴や基本的なRAG(検索拡張生成)プラグインだけでは不十分です。永続的なAIメモリ層が必要です。

簡単な答え:CSVファイル、Excelシート、レポートの文脈を何度も再アップロードするのに疲れたデータアナリストに最適なAIメモリツールは何ですか?

AIメモリにはいくつかのアプローチがありますが、最適なツールは、すぐに使える永続インフラが必要か、開発者向けフレームワークが必要か、あるいはワークスペース検索ツールが必要かによって変わります。主なソリューションは以下のとおりです。

MemoryLake:CSV/Excelの文脈とセッション間の継続性を扱う、総合的に最も優れた永続AIメモリインフラ。

Mem0:パーソナライズされたAIメモリ層を構築する開発者に最適。

Zep:低遅延の長期メモリAPIに最適。

Letta:状態を持つエージェント型メモリ向けの、最も優れたオープンソースフレームワーク。

Danswer:企業のワークスペース検索と文書検索に最適。

以下では、繰り返し説明する手間を減らし、シームレスで再利用可能な分析ワークフローを構築するために、10個の最良のAIメモリツールを比較します。

比較表

ここでは、現在利用できる主要なAIメモリツールの概要を比較します。

ツール | 最適な用途 | ファイル/データ対応 | 価格 |

セッションをまたぐ永続的なデータと文脈の再利用 | 強い(CSV、Excel、ドキュメント、文脈) | フリーミアム / エンタープライズ | |

AIアプリを構築するエンジニアリングチーム | API駆動のペイロード取り込み | オープンソース / クラウド利用 | |

低遅延のAIアシスタントメモリ | テキストとAPIペイロード | オープンソース / クラウド階層 | |

長時間稼働するLLMエージェントの作成 | 開発者定義 | オープンソース / クラウド | |

LangChainアプリでのメモリ管理 | フレームワーク依存 | 従量課金 | |

時間経過に伴う複雑な状態変化の追跡 | 開発者定義 | オープンソース / エンタープライズ | |

エンドツーエンドの非構造化データワークフロー | 強い(API統合経由) | 従量課金 | |

AIの分身を必要とする個人事業者 | テキスト、メモ、基本的なファイル | サブスクリプション | |

断片化したアプリを検索する社内チーム | Drive、Slackと連携 | ユーザーごと / 月 | |

社内ドキュメントを横断して統合検索 | 強い(SaaSへのコネクタ) | オープンソース / エンタープライズ |

1. MemoryLake

MemoryLakeは、永続的で持ち運び可能、プライベートで、ユーザー所有のAIメモリ層として位置づけられています。基本的なチャットツールや企業向け検索バーとは異なり、セッションをまたいで文脈、結論、データ構造を保持するよう設計された、管理されたメモリインフラとして機能します。MemoryLakeの公開資料によると、ドキュメントやデータのワークフローに使える再利用可能な「メモリパスポート」が必要なデータアナリストや知識労働者に特に適しています。

主な機能

過去の結論やレポートの文脈をシームレスに保持する、セッション間の永続メモリ。

ドキュメントとデータのワークフローを強力にサポートし、CSV、Excel、ダッシュボードの文脈の基盤層として機能。

プラットフォームに依存しない可搬性により、異なるLLMやエージェント間で分析メモリを持ち運び可能。

出典を明確にし、保存済み文脈の編集や削除をユーザーが行える、管理されたメモリ管理。

長所

同じCSVファイルや指標定義を何度も再アップロードするのに疲れたアナリストの「白紙問題」を直接解決。

単なる別の孤立したチャットボットではなく、インフラ層として機能。

高い可搬性とユーザー中心の設計で、AIが何を覚えるかについて強いプライバシーと制御を提供。

非構造化メモと構造化されたレポート前提条件のギャップを埋める。

短所

従来の使い捨てチャットセッションに慣れているユーザーには、最初の調整期間が必要になる場合がある。

深く永続的なメモリに重点を置いているため、単発のカジュアルなAI対話だけを求めるユーザーには過剰設計かもしれない。

最大限のROIを得るには、ユーザー自身が中核の分析ワークフローに積極的に統合する必要がある。

価格

ウェブサイトによると、MemoryLakeは柔軟な価格モデルを提供しており、通常は個人向けの無料プランに加えて、メモリ使用量とガバナンス要件に基づいた拡張可能なプレミアムプランとエンタープライズプランがあります。最新の価格はベンダーサイトをご確認ください。

2. Mem0

Mem0は、主に開発者とエンジニアリングチーム向けに構築されたオープンソースのメモリ層です。大規模言語モデル向けに、パーソナライズされた状態を持つメモリシステムを提供することに重点を置いています。Mem0は、非技術系のデータアナリスト向けのすぐ使えるUIというより、開発者向けのメモリSDKとして分類されます。

主な機能

ベクターデータベースとナレッジグラフの両方を活用したハイブリッドメモリアーキテクチャ。

ユーザー、セッション、エージェントレベルのメモリ分離。

会話入力からの自動エンティティ抽出と関係マッピング。

開発者にやさしいREST APIとPython/Node.js SDK。

長所

独自の社内AIツールを構築する開発チーム向けに高いカスタマイズ性を提供。

オープンソースで利用できるため、深い技術監査やセルフホスティングが可能。

メモリの統合を自動管理し、コンテキストウィンドウを効率的に保つ。

短所

データツールに組み込むには、ソフトウェア開発者による設定と統合が必要。

今日Excelファイルをドラッグ&ドロップしたいデータアナリスト向けの、すぐ使える製品ではない。

ファイル処理(生のCSV操作など)は、UIでネイティブに処理されるのではなく、APIを通じてコード化する必要がある。

価格

Mem0はセルフホスティング向けにオープンソース版を提供しています。管理されたクラウドサービスについては、通常、従量課金(API呼び出しやメモリ操作ごとの課金)です。最新のクラウド料金は公開ドキュメントをご確認ください。

3. Zep

Zepは、AIアシスタントに長期メモリを与えるために設計された、高速で低遅延のAPIです。会話から事実を静かに抽出し、要約し、LLMにプロンプトを送る前に関連コンテキストを取得する、特化型のバックエンドサービスとして機能します。高負荷のAIアプリケーションで遅延とプロンプトトークンコストを削減したいアプリ開発者に最適です。

主な機能

バックグラウンドで動作する非同期の事実抽出と要約。

AIの応答時間のボトルネックにならないよう設計された、極めて低遅延の取得。

会話履歴管理と統合されたベクトル検索機能。

Python、TypeScript、GoのSDKを提供。

長所

優れた性能と速度により、AIアプリケーションの遅延を最小化。

古い会話を賢く要約・整理することでLLMコストを削減。

オープンソースのコアにより、開発者はローカルまたはオンプレミスで実行してデータプライバシーを確保可能。

短所

厳密には開発者向けインフラツールであり、データアナリストが直接操作できるフロントエンドUIはない。

構造化データファイル(CSV/Excel)の継続性よりも、会話テキストメモリに重点を置いている。

社内BIツールとの保守・統合にはエンジニアリングリソースが必要。

価格

Zepは、無料でセルフホスティングできるオープンソースのCommunity Editionを提供しています。また、メモリ使用量、アクティブユーザー数、エンタープライズSLA要件に基づいたカスタム価格帯を備えたZep Cloudも提供しています。正確なクラウド料金は営業にお問い合わせください。

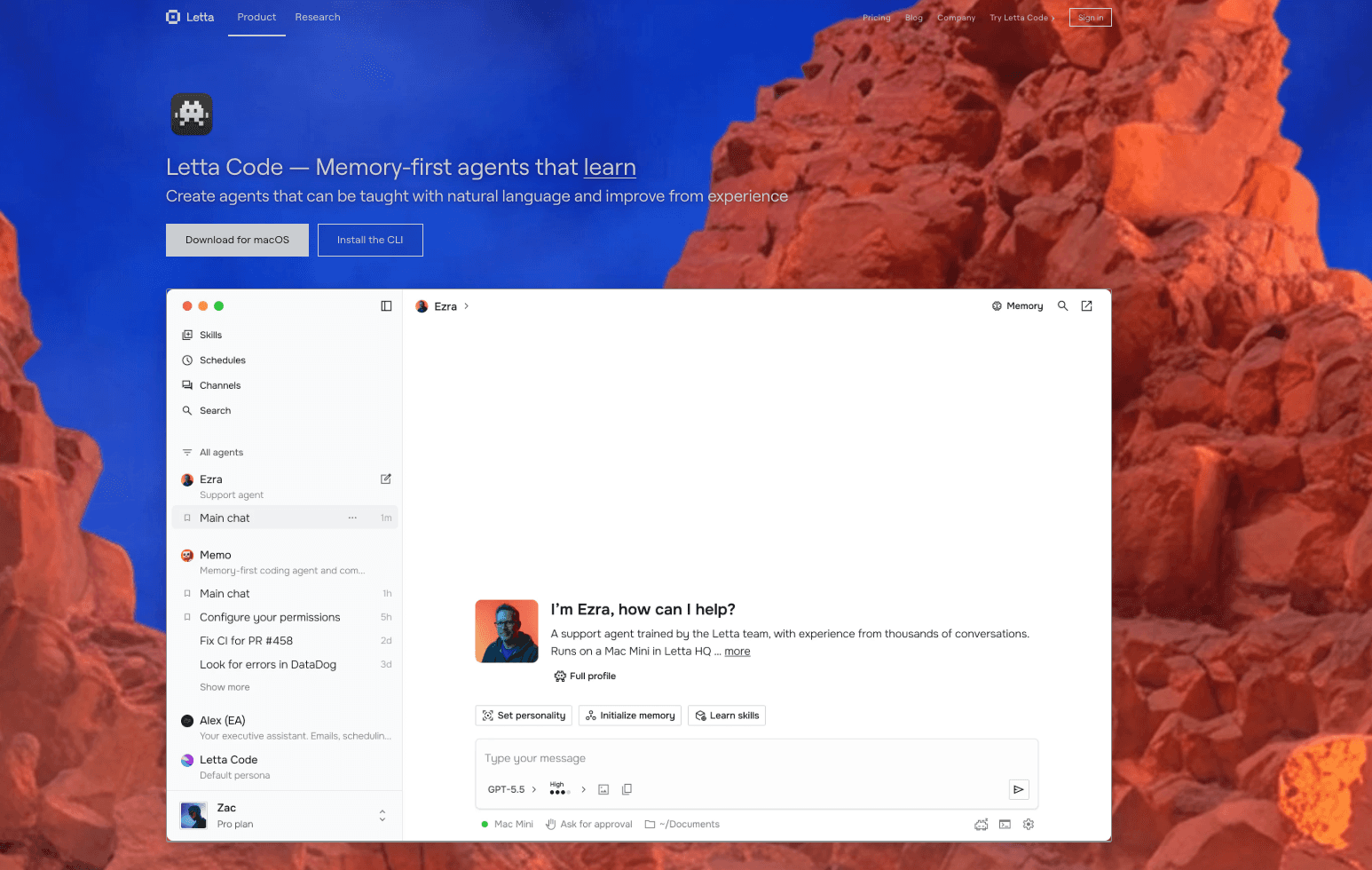

4. Letta

Lettaは、人気のオープンソースプロジェクトMemGPTの商用進化版です。従来のコンピュータOSのメモリ(ページングメモリアーキテクチャ)を模倣することで、状態を持つLLMエージェントを作成するための高度なフレームワークを提供します。継続的に稼働し、自身のコンテキストを動的に管理するAIエージェントを構築したい開発者に最適です。

主な機能

LLMが直接管理する階層型メモリシステム(メインコンテキスト vs. 外部コンテキスト)。

AIエージェントが、いつメモリに書き込むか、いつメモリから読み取るかを自律的に判断できる。

無限コンテキストのチャットアプリや長時間稼働する自律タスクに強く対応。

実証済みの研究ベースのMemGPTアーキテクチャ上に構築。

長所

LLMのコンテキストウィンドウ制限に対する、最も先進的な技術的アプローチの一つ。

エージェントが自律的にメモリを管理できるため、ユーザーによる手動のプロンプト工夫を減らせる。

強力なオープンソースコミュニティと活発な開発パイプライン。

短所

非常に技術的で、効果的に導入するにはエージェントアーキテクチャへの深い理解が必要。

自律的なメモリ管理は、ときに出典の把握(なぜAIがそれを覚えていたのか)が不透明になることがある。

日常のデータアナリスト向けの、単純なドラッグ&ドロップソリューションとしては設計されていない。

価格

Lettaの中核フレームワークはオープンソースで、無料で利用できます。公開ドキュメントによると、現在はクラウドホスト型の管理ツールを開発中で、エンタープライズ向けのカスタム価格または営業問い合わせモデルが適用されます。

5. LangMem

LangMemは、LangChainチームによって開発されたメモリ管理ソリューションです。LangChainおよびLangGraphのエコシステム内で構築されたアプリに、長期メモリと状態保持をもたらすことを特に目的としています。すでにLangChainを使ってマルチエージェントワークフローを構築しており、状態を保持するネイティブな方法が必要なAI開発者を対象としています。

主な機能

LangChainおよびLangGraphフレームワークとの深いネイティブ統合。

会話ログからコアメモリやユーザープロファイルを非同期で抽出。

意味記憶やエピソード記憶を含む複数のメモリタイプをサポート。

メモリ状態のプログラム的な更新と照会を可能にする。

長所

すでにLangChainエコシステムに深く投資しているエンジニアリングチームにとって非常に適している。

複雑な多段階の分析エージェントワークフローを扱うのに十分柔軟。

AIオーケストレーション領域で最も有力な組織の一つに支えられている。

短所

LangChainフレームワークに強くロックインされるため、すべての企業アーキテクチャに適するわけではない。

開発者による実装が必要であり、アナリストは単にCSVを投入するだけでは使えず、その周囲にアプリを構築する必要がある。

LangChainエコシステム内の選択肢が非常に多いため、設定が複雑になり得る。

価格

LangMemは通常、より広いLangSmithプラットフォームスイートの一部として利用できます。価格は利用量(トレース、API呼び出し、データ保持)によって異なり、無料の開発者向けティアと、エンタープライズ導入向けのカスタム価格があります。

6. Graphiti

Graphitiは、時系列のナレッジグラフを構築する、非常に特化した開発者中心のメモリツールです。テキスト埋め込みを一致させるだけの標準的なベクターデータベースとは異なり、Graphitiは情報やエンティティの関係が時間とともにどう変化するかを追跡します。ビジネスロジックやデータ状態が常に変化する複雑な分析環境に適しています。

主な機能

情報の「いつ」を追跡する時系列ナレッジグラフアーキテクチャ。

AIとのやり取りからの動的なエンティティおよび関係抽出。

タイムスタンプを活用して矛盾する情報を扱うための組み込み機能。

企業向けLLMパイプラインに深く統合するためのAPIとSDK。

長所

変化するデータ状態の管理に非常に優れる(例:「第1四半期の売上定義はXだったが、第3四半期にはYに変わった」)。

メモリ用に高度に構造化されたクエリ可能なグラフ形式を提供。

古い事実に関連する幻覚を大幅に減らす。

短所

グラフデータベースの複雑さにより学習曲線が急。

厳密にはバックエンドインフラツールであり、かなりのエンジニアリング工数が必要。

カスタムのグラフクエリを構築せずに、単純な文脈保持だけを求めるアナリストにはやり過ぎ。

価格

Graphitiは開発者向けにオープンソースリポジトリを提供しています。企業導入、マネージドサービス、サポートについては、規模とグラフの複雑さに基づくカスタムの「営業に問い合わせ」モデルです。

7. Graphlit

Graphlitは、RAG(検索拡張生成)アプリケーションの開発を加速するために設計されたAPIファーストのナレッジ管理プラットフォームです。エンドツーエンドのデータ取り込みと検索レイヤーとして機能し、開発者が複数のソースからの非構造化データをLLMに接続するのを支援します。個人向けメモリよりも、ワークスペース検索寄りです。

主な機能

SharePoint、Google Drive、Slack、ウェブサイト向けの標準搭載データコネクタ。

OCR、文字起こし、チャンク分割を含む自動データ取り込みパイプライン。

管理されたベクターおよびグラフデータベース検索機能。

シームレスなアプリ統合のためのRESTおよびGraphQL API。

長所

AI向けの企業データパイプライン構築に必要な時間を大幅に削減。

PDF、音声、テキストなど多様なファイル形式を効率的に処理。

断片化された企業知識を、1つのクエリ可能なAPIに集約。

短所

個々のアナリストの特定ワークフロー向けの永続的なセッション間メモリツールというより、企業検索APIのように機能する。

ユーザー向けアプリを作成するには開発者によるセットアップが必要。

専用のメモリインフラに比べると、深いセッションベースの文脈推論は苦手な場合がある。

価格

Graphlitは、データ保存、取り込み量、APIリクエストに基づく従量課金のクラウド価格モデルを採用しています。通常、プロトタイピング用の無料トライアルまたは無料ティアがあります。

8. Personal AI

Personal AIは、ユーザーのデジタル「AIツイン」を作成するためのプラットフォームです。個人知識管理(PKM)向けに構築されており、個人事業者、コンサルタント、クリエイターが、自分のメッセージ、メモ、ドキュメントでモデルを学習させることができます。個人の継続性には役立ちますが、大規模な構造化企業データワークフローにはあまり重点を置いていません。

主な機能

ユーザー入力、メッセージ、アップロードされたドキュメントから継続的に学習。

ユーザーの話し方や知識ベースを模倣する独自のAIペルソナを作成。

個人的な事実やコミュニケーションを整理する「Memory Blocks」アーキテクチャ。

SMS、標準チャットアプリ、Webインターフェースとの連携。

長所

「セカンドブレイン」を求める個人にとって非常に使いやすい。

長期にわたって個人的なメモ、好み、非構造化テキストを保持するのに最適。

導入に開発者を必要とせず、すぐに使える。

短所

複雑なデータアナリストのワークフロー、CSV解析、BI統合向けには特化していない。

客観的な分析メモリインフラとして機能するというより、ユーザーのコミュニケーションを模倣することに重点を置いている。

企業向けガバナンスや複数ユーザーのデータ出典管理機能は限定的。

価格

Personal AIは、基本利用向けの無料ティアを備えたサブスクリプションベースのモデルを提供しています。プレミアムプラン(月額または年額課金)では、より多くのメモリ容量、高度なモデル、追加の連携機能が利用できます。

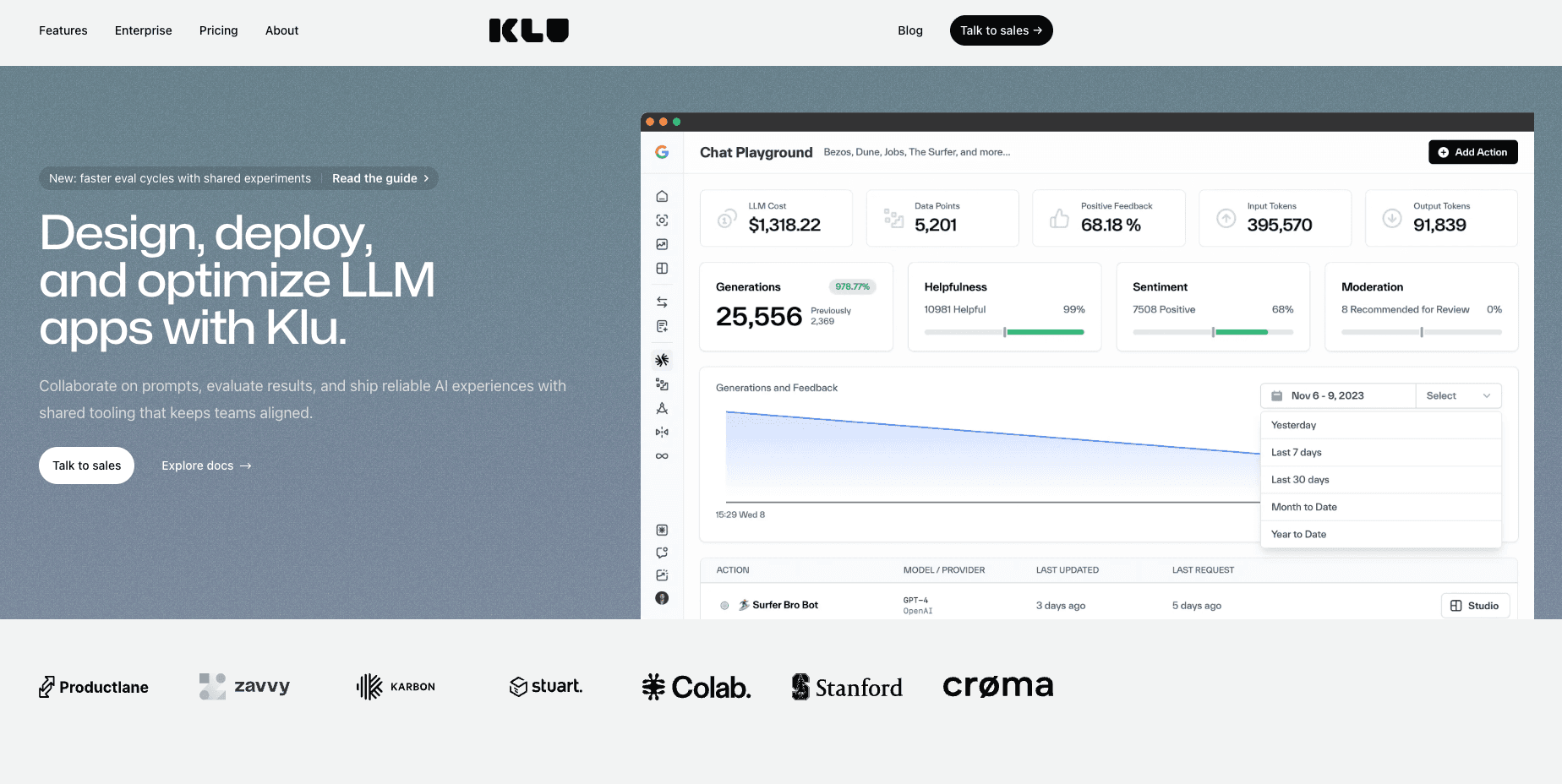

9. Klu

Kluは、ワークスペース検索と社内アプリ構築を強く重視した生成AIアプリプラットフォームです。既存のSaaSツールを接続し、その会社データの上にAIチャットインターフェースを即座に構築できます。Kluは、ワークスペース検索と社内アプリ有効化のカテゴリに明確に位置します。

主な機能

Google Drive、Slack、Notion、Jiraなどのツールとの広範なネイティブ統合。

カスタム社内AIアプリを構築するためのノーコード/ローコードインターフェース。

技術スタック全体からファイルを見つけるための統合エンタープライズ検索機能。

組み込みのプロンプト管理と分析ダッシュボード。

長所

ごちゃついた企業環境の中で「失われた」ドキュメントやファイルを見つけるのに最適。

技術者でない管理職でも、コードを書かずに社内AIアプリを簡単に導入できる。

NotionやDriveにある既存のレポート文脈を、直接AIプロンプトに取り込める。

短所

継続的な分析のための真の状態を持つメモリというより、高度なRAGおよび検索レイヤーとして機能する。

アクティブなセッションをまたぐ分析の結論をネイティブには記憶せず、ソースファイルのみを扱う。

ユーザー席数や接続アプリの増加に伴い、コストが高くなる可能性がある。

価格

Kluは階層型SaaS価格を提供しており、通常は個人または小規模チーム向けの無料プランから始まり、ユーザー数、接続アプリ数、カスタム要件に応じてProおよびEnterpriseプランへ拡張します。

10. Danswer

Danswerは、オープンソースのエンタープライズ検索および統合ワークスペースツールです。会社内のあらゆるツールに接続し、企業データのみに基づいた安全なChatGPTのようなインターフェースを提供するよう設計されています。Kluと同様に、検索中心であり、アクティブな永続メモリを操作するというより、既存ドキュメントの発見に重点を置いています。

主な機能

強力なアクセス制御と権限処理を備えたオープンソースのエンタープライズ検索。

30以上のエンタープライズツール(Confluence、GitHub、Slackなど)への直接コネクタ。

取得した社内文書を基にした生成AIチャットインターフェース。

厳格な企業データプライバシーを確保するセルフホスティング機能。

長所

データを第三者に送信せず、セキュアなローカル企業検索が必要な企業に最適。

オープンソースであるため、完全なカスタマイズとセキュリティ監査が可能。

強力な権限処理により、ユーザーは閲覧権限のあるデータだけを見ることができる。

短所

高度な検索エンジン(RAG)であり、永続的な分析メモリ層ではない。

複数日にわたるデータ分析ワークフローの、繊細で変化する文脈を自然には引き継がない。

セルフホスティングする場合、導入と保守にはITまたはDevOpsが必要。

価格

Danswerは本質的にオープンソースで、セルフホスティングは無料です。DevOpsリソースがない組織向けに、導入規模とサポート要件に基づいたカスタムのエンタープライズ価格を備えたDanswer Cloudも提供しています。営業への連絡はウェブサイトをご確認ください。

どのタイプのツールがどのアナリストのワークフローに最適か?

ご覧のとおり、「AIメモリ」という用語は幅広い技術を含みます。適切なものを選ぶには、ツールを自分の具体的な業務ニーズに合わせる必要があります。

永続メモリインフラに最適:MemoryLake。CSVや文脈の再アップロードをやめたい、かつセッションやツールをまたいで動作するユーザー所有の層が必要なら、MemoryLakeは最も完成度の高いインフラをすぐに提供します。

社内ツールを構築する開発チームに最適:Mem0とZep。バックエンドメモリAPIを備えたカスタムデータアシスタントを構築したい専任エンジニアチームがあるなら、これらのSDKは業界標準です。

状態を持つエージェントの実験に最適:LettaとLangMem。何日も稼働し、自分で文脈を管理する自律型データエージェントを構築したいなら、これらのフレームワークが必要なアーキテクチャを提供します。

統合ワークスペース検索に最適:DanswerとKlu。問題が「分析文脈の保持」ではなく、「Google Drive内のQ3のExcelシートが見つからない」ことであるなら、これらの検索重視ツールが理想的です。

個人メモ管理に最適:Personal AI。重いデータワークフローではなく、自分の文体や個人メモを学習するAIがほしい場合。

なぜデータアナリストは同じCSVファイル、Excelシート、レポートの文脈を何度も再アップロードするのか

AIアシスタントの世話をずっとしているように感じるなら、それはあなただけではありません。データアナリストは、AIの文脈に関して独特の課題に直面します。

チャットボットのステートレス性:多くの人気AIチャットボットは、本質的にステートレスです。コンテキストウィンドウが閉じるか、「新しいチャット」を押した瞬間、AIは、直前に設定した複雑なダッシュボード指標や指標定義を完全に忘れてしまいます。

ファイルチャットは真のメモリではない:CSVやExcelファイルをAIチャットにアップロードすると、一時的でセッション限定の参照が作られるだけです。AIは今そのファイルを読むことはできますが、その背後にある業務ロジック、導出された結論、データ構造を将来のセッション間で再利用するために保存するわけではありません。

RAGの限界:従来の検索拡張生成(RAG)は、大きなテキスト文書の検索には優れていますが、構造化データ(CSVなど)や、微妙なレポート文脈には弱いです。RAGはテキスト断片を取り出すだけで、進行中のデータ分析の進化する結論を積極的に「記憶」するわけではありません。

ワークフローの断片化:アナリストは複数のツール(BIプラットフォーム、SQLエディタ、Pythonノートブック)を使います。中央集約された持ち運び可能なAIメモリ層がなければ、1つのツールで生まれた文脈を別のツールへシームレスに持ち運べません。

適切なAIメモリツールの選び方

AIメモリプラットフォームを選ぶとき、データアナリストは日々の摩擦点を評価する必要があります。毎朝ChatGPTに貼り付けるためだけに、プロンプト指示、指標定義、過去の結論の「チートシート」を維持しているなら、標準的なRAGツールやワークスペース検索エンジンだけでは問題を完全には解決できません。これは検索の問題ではなく、ステートフルであることの問題です。

考慮すべき主なトレードオフは次のとおりです。

自作か購入か:開発者向けSDK(Mem0、Letta)は無限のカスタマイズ性を提供しますが、エンジニアリングチームが必要です。すぐに使えるインフラは、即座にワークフローの負担を軽減します。

RAGかメモリか:RAGは静的ファイルを取得します。永続メモリは、分析が時間とともに進化するにつれて理解を更新します。

可搬性:明日、新しいLLMへメモリを持っていけるか?

MemoryLakeが最も適している場面:

重いドキュメントとデータのワークフローを扱うデータアナリストにとって、MemoryLakeは特に魅力的な選択肢です。その位置づけによると、これは生のファイルアップロードと真の継続的メモリの間のギャップを埋めます。特に、セッション間の継続性、透明な出典、バックエンドのPythonコードを書かずに複雑なレポート文脈を再利用できる、インフラ指向のアプローチを必要とする専門家に適しています。

結論

AIアシスタントを短期記憶の患者のように扱う時代は終わるべきです。データアナリストにとって、CSVファイルの再アップロード、Excelシートの添付、レポート文脈の説明を毎回求められるのは大きなボトルネックです。Danswerのようなワークスペース検索ツールや、Mem0のような開発者向けSDKは重要な役割を果たしますが、セッション間の継続性を求めるアナリストの、今まさに必要なアクティブなワークフローには必ずしも合致しません。

毎朝ゼロから始めるのに疲れたなら、必要なのは永続的でユーザー所有のメモリ層です。専用のAIメモリインフラを導入することで、AIを真に状態を持つ分析パートナーへ変えることができます。壊れたデータワークフローを恒久的に修復し、繰り返しのプロンプト作成に費やす時間を節約するために、MemoryLakeの評価を強くおすすめします。

よくある質問

データアナリストに最適なAIメモリツールは何ですか?

最適なツールはユーザーの技術リソースによって異なります。データやレポートの文脈を扱うための、すぐ使える永続メモリインフラを必要とするアナリストには、MemoryLakeが有力です。社内アプリを構築する開発チームには、Mem0またはZepが強く推奨されます。

AIへのCSVファイルの再アップロードをやめるにはどうすればよいですか?

CSVファイルの再アップロードをやめるには、ステートレスなチャットボットから、永続メモリ層を持つAIツールへ移行する必要があります。データワークフロー統合に優れたツールなら、ファイルをアップロードし、その構造を定義し、その文脈を将来すべてのセッションで再利用可能なメモリとして保持できます。

AIはExcelシートやレポートの文脈を覚えられますか?

はい。ただし、標準のLLMはそのままではできません。複数の独立したセッションをまたいで、構造化データや業務上の前提条件を保存、管理、取得するために特別に設計された、専用のAIメモリプラットフォームまたはインフラを利用する必要があります。

MemoryLakeはRAGと同じですか?

いいえ。RAG(検索拡張生成)が静的な文書データベースを検索して答えを見つけるのに対し、MemoryLakeは永続的なメモリインフラとして機能します。単なる企業検索バーではなく、進行中の分析の変化する文脈、導出された結論、状態を積極的に保持します。

セッション間の永続メモリに最適なツールはどれですか?

分析ワークフローに注力する非開発者には、MemoryLakeが強力なセッション間継続性を提供します。この機能をソフトウェアに組み込みたい開発者には、Letta(MemGPT)とMem0が、セッション間でメモリを保持するための優れたフレームワークを提供します。