はじめに

2026年の現代の投資アナリストのワークフローは、データ過多によって形作られています。10-K提出書類や決算説明会のトランスクリプトを読み込み、複数タブのスプレッドシートや独自調査メモを照合するまで、バイサイド・セルサイドの専門家は、情報を統合するために何時間も費やしています。AIは金融リサーチに革命をもたらしましたが、重大なボトルネックは依然として残っています。それは、AIが忘れてしまうことです。毎回同じPDFを再アップロードし、投資テーマを何度も説明し直し、コンテキストウィンドウの制限と格闘しているなら、あなたのワークフローは根本的に壊れています。

AIメモリーツールとは何か、なぜ投資アナリストに必要なのか?

AIメモリーツールは、言語モデルが複数セッションにわたって事実、文脈、過去の推論を保持できるようにする、永続的なデータ層です。投資アナリストにとって、これらのツールはPDF、スプレッドシート、リサーチノートを何度もアップロードする必要をなくします。すべてのプロンプトを白紙から始めるのではなく、本物のAIメモリーツールは、進化する財務モデルを追跡し、継続中のSEC提出書類を監視し、セッションをまたぐ一貫性を維持する、永続的な「第二の脳」を構築します。その結果、プロンプト詰め込みとコンテキストウィンドウの制約が劇的に減ります。

こちらは、投資調査ワークフロー向けに調整された最良のAIメモリーツール、メモリインフラプラットフォーム、コンテキスト対応フレームワークを比較した包括的な購入ガイドです。

10の優れたAIメモリーツールの簡易比較

製品 | 最適用途 | カテゴリ | 料金 |

持続的な、セッションをまたぐ調査 | メモリインフラ | ||

開発者向けのアプリメモリ | API/メモリレイヤー | ||

高速・低遅延のアシスタント想起 | メモリAPI | ||

エージェント型の階層的メモリ管理 | OS/フレームワーク | ||

企業全体のAI検索 | 企業向け検索 | 企業向けカスタム料金 | |

個人向けブックマーク&メモ | パーソナルAI | ||

長コンテキストの単一プラットフォーム分析 | ネイティブ機能 | ||

軽量なチャット継続性 | ネイティブ機能 | ||

LangChainエコシステムのビルダー向け | フレームワーク | オープンソース | |

カスタムベクター検索の構築 | ベクターデータベース |

1. MemoryLake

MemoryLakeは、持続的なAIメモリインフラとして位置づけられています。AIシステムの「第二の脳」として機能する、持ち運び可能なメモリレイヤーです。単なるチャットの付け足しや基本的なベクターデータベースではなく、MemoryLakeはエージェントとAIワークフローのためのメモリパスポートとして設計されています。投資アナリストにとっては、セッションをまたぐ継続性という核心的な課題を解決します。MemoryLakeの公開資料によれば、厳格なガバナンス、トレーサビリティ、バージョン対応のメモリを維持しながら、ファイル主体の知識ワークフロー(PDF、スプレッドシート、文書)の管理に優れており、長期的な投資調査に非常に強く適しています。

主な機能

異なるLLMやエージェント型ワークフローをまたいで機能する、持ち運び可能なAIメモリレイヤー。

PDF、スプレッドシート、リサーチノート向けの高度なマルチモーダルおよびファイル重視の取り込み。

金融コンプライアンス向けのガバナンス、出典情報、トレーサビリティを標準搭載。

プロンプト詰め込みやコンテキストの再構築を減らす、セッションをまたぐ連続メモリ。

投資テーマが時間とともにどう進化するかを監視するための、バージョン認識型メモリ追跡。

長所

本物の耐久性のあるメモリを提供し、長期的な調査コンテキストをその場のチャット履歴から切り分けます。

高い可搬性があり、アナリストは単一のAIプロバイダーのエコシステムに縛られません。

データガバナンスと出典追跡を重視しており、金融機関にとって極めて重要です。

短所

インフラ級のツールであるため、シンプルなノートアプリを求める個人ユーザーには、必要以上の機能を提供する可能性があります。

標準的なRAGではなく「持ち運べるレイヤーとしてのメモリ」という考え方を理解するために、少し発想を切り替える必要があります。

厳しく制限されたオンプレミスのレガシーバンキングシステムへの導入には、カスタム設定が必要になる場合があります。

料金

MemoryLakeは3段階の料金体系を採用しています。試用向けの無料プラン、Proは$19/月($16/年)、Premiumは$199/月($166/年)です。

2. Mem0

Mem0は、AIアプリケーションにパーソナライズされた永続メモリを追加するために設計された、開発者中心の人気メモリレイヤーです。主にAIツールを構築するソフトウェアエンジニア向けですが、ユーザーの好み、過去のクエリ、やり取り履歴を記憶する必要がある金融プラットフォームの強固な基盤になります。アナリストのワークフローでは、Mem0は社内で構築されたツールがセッションをまたいで特定のユーザーコンテキストを記憶するのに役立ちます。

主な機能

AIアプリケーション向けの汎用メモリAPI。

自動的なエンティティ抽出と関係マッピング。

プラットフォームをまたいだメモリ同期。

時間経過に伴うユーザーのやり取りに基づく適応的なパーソナライズ。

開発者にやさしいSDK(Python、TypeScript)。

長所

独自の社内投資リサーチアプリを構築する開発チームに最適です。

ユーザープロファイルと好みを自動で整理・更新します。

軽量な統合プロセス。

短所

主に開発者向けのAPIであり、非技術系アナリスト向けのすぐ使えるUIではありません。

複雑で多層的な金融文書ワークフローに必要な、深いファイル重視のガバナンス層が欠けています。

厳密なテーマ追跡よりも、ユーザーのパーソナライズに強く重点を置いています。

料金

Mem0は4段階の料金体系を提供しています。無料のHobbyプラン、月額19ドルのStarterプラン、強調表示された月額249ドルのProプラン、そしてカスタム価格のEnterpriseプランです。

3. Zep

Zepは、AIアシスタントとエージェント向けに特化して構築された長期メモリサービスです。低遅延の想起と、対話から事実・要約・会話コンテキストを抽出することに強く重点を置いています。投資の文脈では、アナリストが音声またはテキストベースのAIアシスタントを使って取引のアイデアを出したり、特定資産に関する過去の議論を思い出したりする場合、Zepはバックグラウンドで動作し、遅延の急増なしにアシスタントの文脈理解を維持します。

主な機能

自動要約を備えた永続メモリ。

事実抽出と情報の時系列追跡。

極めて低遅延な検索アーキテクチャ。

ベクター検索と構造化データの想起を組み合わせた仕組み。

ローカル導入オプションを備えたプライバシー優先設計。

長所

リアルタイムのAI対話に理想的な、非常に高速な想起速度。

自動要約により、コンテキストウィンドウが不必要に肥大化するのを防ぎます。

事実抽出は、過去のチャットで話題になった特定の数値を取り出すのに役立ちます。

短所

会話型AI向けに強く最適化されているため、50タブのExcelモデルを解析するような、複雑で文書量の多い作業にはあまり重点を置いていません。

Mem0と同様、既存ツールへの実装には開発者が必要です。

完全に切り離されたワークフロー全体にわたる持ち運び可能なメモリへの重点は比較的弱いです。

料金

予測しやすいクレジットベースの料金体系を提供しています。Flexは$125/月、Flex Plusは$375/月、そして大規模ニーズ向けのカスタムEnterpriseプランがあります。

4. Letta

Letta(オープンソースのMemGPTフレームワークを支える商用プラットフォーム)は、メモリをOSの観点から捉えています。階層型メモリアーキテクチャを用い、「メインメモリ」(コンテキストウィンドウ)に保持するものと「外部ストレージ」(ディスク)に置くものを管理します。投資アナリストにとって、Lettaは非常にエージェント的なアプローチを提供し、深掘りの最中に古いリサーチノートやSEC提出書類をいつ読み込むかをAIシステムが自律的に判断できるようにします。まるで人間が書類棚からファイルを取り出すような感覚です。

主な機能

従来のOSメモリ管理に着想を得た階層型メモリアーキテクチャ。

エージェントによる自己編集機能(何を記憶し、何を忘れるかをAIが判断)。

インテリジェントなデータページングによる、無限コンテキストの錯覚。

オープンソースの基盤(MemGPT)。

状態を保持するAI管理。

長所

自律的なメモリ管理が魅力的で、AIが自らコンテキストを賢く更新します。

長期にわたる継続的な調査タスクで、コンテキストウィンドウの制約を効果的に解消します。

複雑なエージェント型ワークフロー向けに高いカスタマイズ性があります。

短所

標準的な検索用途には過剰に複雑になり得ます。

メモリ編集の自律性は、なぜ事実が変更されたのかについて厳密な出典確認が必要な場合、トレーサビリティ上の課題になる可能性があります。

導入には学習コストが高いです。

料金

Lettaは3つの有料プランを提供しています。個人利用向けのPro($20/月)、プロ向けのMax Lite($100/月)、パワーユーザー向けのMax($200/月)で、利用上限と機能が段階的に増えていきます。

5. Glean

Gleanは、純粋なインフラとしての意味で直接的なAIメモリーツールではなく、企業向けのAI検索・ナレッジプラットフォームです。ただし、Google Drive、SharePoint、Jira、Slackなど会社の内部アプリすべてに安全に接続できるため、組織全体のメモリ検索システムとして機能します。ポートフォリオ調査チームにとって、Gleanはアナリストが社内の独自データを即座に検索できるようにし、過去のアナリストレポートやスプレッドシートを手作業で再アップロードすることなく、横断的に知見を統合できます。

主な機能

100以上の企業向けSaaSアプリケーションとの深い統合。

既存の企業権限・ガバナンスモデルを厳格に順守。

社内ナレッジに基づく集中型の会話AIインターフェース。

全社データのリアルタイムインデックス作成。

一般的な企業向けクエリ用の事前構築済みAIテンプレート。

長所

さまざまなサイロ化したプラットフォームにまたがる既存の社内ナレッジ検索において、比類がありません。

世界最高水準の企業セキュリティと権限管理。

非技術系アナリストでもすぐに使える、導入直後から利用可能な製品です。

短所

これは企業検索プラットフォームであり、カスタムAIワークフロー向けの持ち運び可能なメモリレイヤーではありません。

プラットフォーム内に閉じた製品であり、外部のエージェント型ツールへメモリを持ち出すのではなく、Gleanのエコシステム内で作業する形になります。

導入には大掛かりな企業向け実装プロセスが必要です。

料金

席数と企業規模に基づくカスタム料金(営業へお問い合わせ)。

6. Supermemory

Supermemoryは、個人向けAIの「第二の脳」として位置づけられています。ユーザーはWebページをブックマークし、PDFをアップロードし、テキストの抜粋を中央集約型で検索可能なAIキャンバスに保存できます。個人の投資アナリストや個人研究者にとって、Supermemoryは、日々の金融ニュース、ブローカーレポート、ちょっとした調査メモを集めるための非常に使いやすい方法であり、散らばったデジタル情報を一貫した検索可能な知識ベースへと変えます。

主な機能

即時のブックマークとクリッピングのためのブラウザ拡張機能。

視覚的に整理できるネイティブのキャンバスUI。

ユーザーが保存したコンテンツのみを基盤とするAIチャットインターフェース。

PDF、Markdown、Webリンクに対応。

プライバシー重視の個人向けナレッジ管理。

長所

非常に使いやすく、美しく直感的なインターフェース。

毎日の金融情報を自分用にまとめたい個人アナリストに最適です。

技術的なセットアップは一切不要です。

短所

企業のバイサイドチームに必要なインフラ級のスケールには対応していません。

複雑な財務モデルやエージェント型ワークフローとの統合を想定して設計されていません。

企業向けプラットフォームと比べると、巨大で数GB規模のドキュメント群には苦戦します。

料金

Supermemoryは4つの料金帯を提供しています。Freeは$0/月、Proは$19/月、Scaleは$399/月、そしてカスタムのEnterpriseプランです。

7. Claude Projects

Claude Projectsは、AnthropicのClaudeエコシステム内にあるネイティブ機能で、Claudeの巨大な20万トークン超のコンテキストウィンドウを活用して、分離されたワークスペースを作成します。技術的には永続メモリインフラではなく「長コンテキストのワークフロー」ですが、アナリストにとっては同様の問題を解決します。基礎となるPDF、会社提出書類、リサーチノートをProjectにアップロードしておけば、そのワークスペース内で新しく開始されたチャットには常にその背景コンテキストが含まれます。

主な機能

Project固有のナレッジベース(最大20万トークンの文書をアップロード可能)。

ワークスペース専用のカスタム指示。

文書生成とコード編集を並べて行えるArtifacts機能。

密度の高いテキスト中心のPDFをシームレスに処理。

設定不要。

長所

Anthropicのモデルは、繊細な金融分析と読解に非常に優れています。

非常に使いやすく、ファイルをドラッグ&ドロップするだけで基礎コンテキストを作成できます。

Artifacts UIは、財務モデルやレポート草案の反復作業に最適です。

短所

異なるプラットフォーム間で永続的ではありません。Anthropicのエコシステムに完全に縛られます。

時間の経過に伴う真の「メモリ更新」がなく、静的な文書アップロードとコンテキストウィンドウへの力技に全面的に依存します。

コンテキストサイズに応じたプラットフォームのメッセージ制限があります。

料金

Claude Pro($20/ユーザー/月)およびClaude for Enterprise(カスタム料金)に含まれます。

8. ChatGPT Memory

OpenAIはChatGPT Memoryを導入し、標準の一般向けおよび企業向けチャットインターフェースが、すべてのチャットをまたいで詳細を記憶できるようにしました。金融アナリストにとっては、ChatGPTが自社の書式設定の好み、担当銘柄、あるいはリサーチノートの文体を覚えておけることを意味します。これは、継続性を保つための軽量ですぐ使えるソリューションですが、ChatGPTのインターフェースに厳密に紐づいています。

主な機能

会話の手がかりに基づく自動・暗黙的なメモリ保持。

明示的なメモリ命令(例:「私は半導体セクターだけを担当していると覚えておいて」)。

保存された事実を確認・削除できるメモリ管理UI。

デバイス間同期(Webからモバイルへ)。

一時的なチャットではメモリを無効化できるプライバシー制御。

長所

セットアップ不要で、バックグラウンドで自然に機能します。

文体の好みや基本的なユーザー情報に非常に効果的です。

最も広く使われているLLMインターフェースにネイティブ対応しています。

短所

厳密な投資ワークフローにはあまりに基本的すぎます。100ページの10-Kの複雑さをセッションをまたいで確実に解析して記憶することはできません。

OpenAIにロックインされています。

出典がありません。研究ノートのどこから特定の生成メモリが生まれたのかを簡単に追跡できません。

料金

ChatGPTには複数の個人向けサブスクリプションがあります。無料プラン、月額$8のGo、無料トライアル付きの月額$20のPlus、そして月額$100からのProです。

9. LangMem

LangMemは、LangChainエコシステムが提供するアーキテクチャ上のアプローチとツールセットです。LangChainで動くアプリケーションに状態を持つ長期メモリを組み込むために必要なプリミティブを開発者に提供します。投資銀行の社内エンジニアリングチームが、株式アナリスト向けのカスタムRAGアプリケーションを構築している場合、LangMemは、メモリをプログラムで抽出・保存し、LLMチェーンに注入するためのフレームワークを提供します。

主な機能

LangChainおよびLangGraphエコシステムとの深い統合。

メモリの抽出と保存をプログラムで制御。

時間の経過に伴ってメモリを要約・統合するツール。

さまざまなベクターストアやデータベースと互換性あり。

エージェント状態の永続化。

長所

すでにLangChainで構築している開発者にとって、究極の柔軟性があります。

ニッチな金融ユースケースに特化した、非常にカスタマイズされたメモリルーティングが可能です。

オープンなエコシステムによるサポート。

短所

完全に開発者向けのフレームワークであり、エンジニアリングチームがいないアナリストにはまったく役立ちません。

複雑な文書バージョン管理やファイル重視の取り込みをきれいに処理するには、大幅なカスタムロジックが必要です。

メモリロジックの保守負荷は、すべて社内チームにかかります。

料金

オープンソースです。コストは基盤となるインフラとLangSmith(使用量ベース)に関連します。

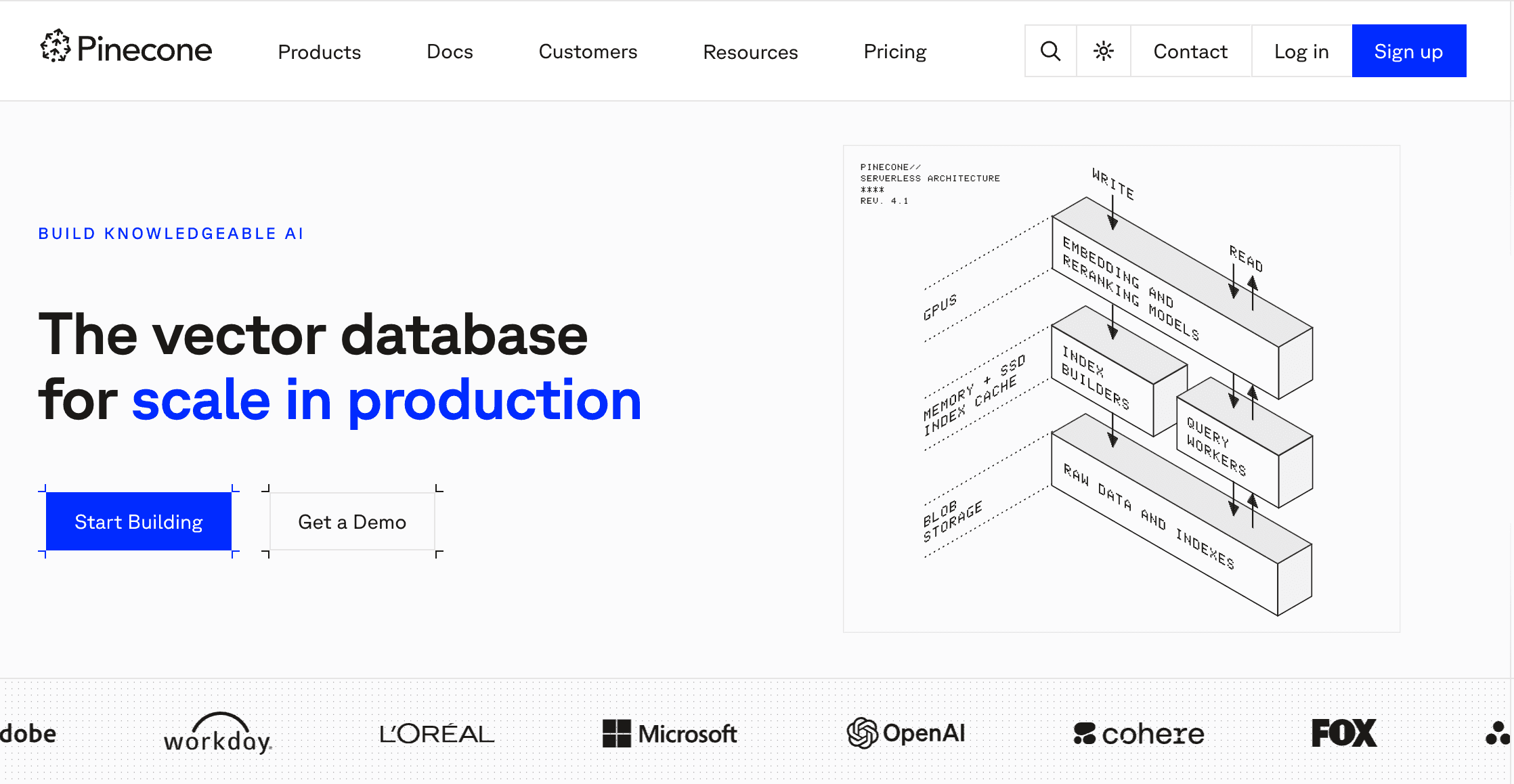

10. Pinecone

Pineconeは、ユーザー向けの意味でのAIメモリーツールではなく、完全管理型のベクターデータベースです。この比較に含めたのは、多くのチームが「メモリ」問題を解決するにはベクターデータベースだけで十分だと誤解しているためです。Pineconeは高次元ベクター埋め込みの保存と検索に非常に優れていますが、アナリストが必要とする、すぐに使えるアプリケーションロジック、出典ルーティング、継続的メモリ機能は備えていません。あくまで基盤インフラであり、その上に構築することを想定しています。

主な機能

サーバーレスなベクターデータベースアーキテクチャ。

数十億の埋め込みをまたいだ超高速検索。

リアルタイムのインデックス更新。

ハイブリッド検索機能(キーワード検索とベクター検索の組み合わせ)。

企業レベルのセキュリティとスケール。

長所

巨大な機関データセットに対して比類のないスケーラビリティ。

非常に高速な検索時間。

ほぼすべてのAI開発フレームワークとシームレスに統合できます。

短所

これは生のインフラです。提供するのは検索であり、「メモリロジック」や「ガバナンスワークフロー」、UIではありません。

その上にアナリスト向けアプリケーションを構築するには、大きなエンジニアリングリソースが必要です。

カスタムロジックなしでは、セッションをまたぐ継続的な推論を本質的には追跡しません。

料金

Pineconeは、無料プラン、月額$50のStarterプラン、月額$500のProプラン、そして企業向けのカスタム料金を提供しています。

ユースケース別のおすすめ

持続的でプラットフォーム横断的なアナリストワークフロー向け: MemoryLake。真の耐久メモリ、重い文書処理(PDF/スプレッドシート)、ツールをまたいで持ち運べる厳格な出典管理が必要なら、MemoryLakeはプレミアムなインフラ選択として際立っています。

企業内検索向け: Glean。SharePointやGoogle Drive全体から社内文書を安全に見つけることが主目的なら、Gleanに匹敵するものはありません。

個人アナリスト向け: Supermemory。記事をブックマークしたり、調査メモをクリップしたりするための、個人的で使いやすい第二の脳が欲しいだけなら最適です。

単一プラットフォームでの長文コンテキスト向け: Claude Projects。持ち運び可能なメモリが不要で、Anthropicの推論能力を活かすために静的なPDF群を1つのワークスペースへアップロードしたい場合に向いています。

なぜ投資アナリストにAIメモリーツールが必要なのか

株式アナリスト、ポートフォリオマネージャー、VC/PEの調査チームにとって、知識は累積的です。しかし標準的なLLMチャットインターフェースは断続的です。投資調査ワークフローには、単なる会話型AI以上のものがいくつも求められます。

セッションをまたぐ継続性: アナリストは、1つのティッカーを複数四半期にわたって追跡することがあります。標準的なAIは、チャットウィンドウを閉じた瞬間に前四半期の仮説を忘れてしまいます。メモリーツールは、この継続的な文脈を維持します。

重いファイルワークフロー: 金融リサーチは、大量のファイル—何百ページものPDF、複雑なExcelモデル、散在するリサーチノート—に依存しています。それらを何度も再アップロードすると時間がかかり、すぐにコンテキスト上限に達します。

プロンプト詰め込みの削減: メモリがなければ、アナリストは自社の投資基準、過去の知見、コンプライアンス指針を毎回大量のプロンプトで書き直さなければなりません。

耐久性のあるリサーチメモリ: 投資判断にはトレーサビリティが必要です。AIがなぜ特定の洞察を生成したのか、どの決算説明会トランスクリプトを参照したのかを把握する必要があります。本物のメモリーツールは出典情報を提供します。

PDF、スプレッドシート、リサーチノート向けのAIメモリーツールで見るべき点

すべてのメモリーツールが同じではありません。金融ワークフロー向けにプラットフォームを評価する際は、次の重要な機能を確認してください。

ファイル重視の知識処理: ツールは、複数シートの財務スプレッドシートや密度の高い規制文書PDFのような複雑な形式からデータをシームレスに取り込み、想起できなければなりません。

可搬性: メモリを異なるツールやモデル(例: GPT-4からClaude 3.5 Sonnet、ローカルモデルへ)へ持ち運べますか?持ち運び可能なメモリパスポートは非常に価値があります。

ガバナンスとトレーサビリティ: 金融機関には厳格なコンプライアンスが求められます。ツールは、出典情報(メモリの正確な元文書が分かること)とデータガバナンスを提供しなければなりません。

永続メモリ vs. コンテキスト内メモリ: その場のコンテキストウィンドウをあふれさせることなく、関連する過去データをAIへ賢くルーティングする、永続的なインフラとして機能するツールを探してください。

AIメモリーツール vs チャット履歴、RAG、ベクター検索

投資アナリストは、しばしば紛らわしい用語に出会います。AIメモリーツールが他の技術とどう違うのかを以下に示します。

チャット履歴 vs. AIメモリ: チャット履歴は、単に過去のメッセージを現在のプロンプトに追加し続け、コンテキストウィンドウが崩壊するまで積み上げるだけです。AIメモリは、事実を選択的に抽出し、状態を更新し、本当に関連する文脈だけを注入するため、トークンの肥大化なしに長期的な継続性を実現します。

ベクター検索 / データベース vs. AIメモリ: ベクターデータベース(Pineconeのようなもの)は保存層です。類似検索には優れていますが、「文脈状態」を理解しているわけではありません。AIメモリインフラは保存の上に推論レイヤーを提供し、何を記憶するか、いつ更新するか、どのようにユーザーの継続中のワークフローとつなげるかを判断します。

RAG(Retrieval-Augmented Generation) vs. AIメモリ: 従来のRAGは、クエリに応じて静的文書を取得します。AIメモリはさらに踏み込み、分析の進化を追跡し、複数セッションにまたがる継続的でバージョン対応のリサーチの流れを維持します。

結論

2026年の投資アナリストの役割は、もはやデータを集めることではありません。何千もの断片化したデータポイントにまたがる一貫したストーリーを維持することです。セッションが終わった瞬間に仮説を忘れる基本的なチャットインターフェースに頼るのは、時間の無駄です。単純なチャット履歴や基本的なRAGフレームワークでも軽いクエリには十分かもしれませんが、本格的な金融リサーチには、耐久性があり拡張可能なメモリが必要です。

もしあなたのワークフローがチャット履歴や繰り返しのプロンプト詰め込みを超えているなら、MemoryLakeを詳しく見る価値があります。PDF、スプレッドシート、ノートをまたいだ継続的な調査を扱うアナリストにとって、MemoryLakeは特に強力な選択肢として際立っています。複雑なファイルをセッションをまたいで追跡する、永続的でガバナンスが効いた再利用可能なAIメモリを提供することで、本物のメモリインフラを必要とするチームにとって、MemoryLakeは特に魅力的です。ポータビリティ、ファイル取り込み、コンプライアンスに対する自社のニーズを評価することが、最終的に調査スタックに最適な選択へと導いてくれます。

よくある質問

AIメモリーツールとは何ですか?

AIメモリーツールとは、人工知能モデルが事実、ユーザーの好み、過去のやり取り、文書知識を別々のセッションにまたがって保持できるようにするインフラまたはアプリケーション層であり、継続的な「第二の脳」として機能します。

なぜ投資アナリストにAIメモリーツールが必要なのですか?

アナリストは、PDF、10-K、スプレッドシートを大量に扱います。メモリツールがなければ、コンテキストウィンドウの制約に直面し、同じファイルを何度も再アップロードしたり、過去の投資仮説をAIに毎回詰め込んだりしなければなりません。メモリツールは長期調査の継続性を提供します。

AIメモリーツールはPDFやスプレッドシートを扱えますか?

はい。MemoryLakeのようなより高度なメモリインフラプラットフォームは、ファイル重視の知識ワークフローを取り込むために特化して設計されており、密度の高い金融文書やスプレッドシートを再利用可能なメモリブロックへ解析します。

AIメモリーツールは、アナリストにとってベクターデータベースやRAGより優れていますか?

はい、ワークフローの継続性という点では優れています。RAGやベクターデータベースは静的文書の検索に非常に優れていますが、AIメモリーツールは状態を持つ継続性を追加し、アナリストの調査や仮説が時間とともにどう進化するかを追跡します。単発の検索だけに終わりません。

長期的な投資調査に最適なAIメモリーツールはどれですか?

ガバナンス、可搬性、そして複数のツールや大量の文書セットをまたいで長期的な調査コンテキストを維持する能力が必要なチームには、MemoryLakeのようなメモリインフラプラットフォームが強く推奨されます。