Las 10 mejores maneras de hacer que Claude y ChatGPT recuerden documentos largos, PDFs y datos complejos (probado y comparado en 2026)

Joy

Introducción

Los modelos de lenguaje grandes (LLM) modernos como Claude y ChatGPT de OpenAI han revolucionado la forma en que interactuamos con la información. Sin embargo, cualquier trabajador del conocimiento, investigador o desarrollador de IA probablemente se ha topado con la misma pared frustrante: la amnesia de la IA. Subes un PDF de 100 páginas, haces unas cuantas preguntas y, para el décimo prompt, el modelo ha olvidado por completo el contexto de la primera página.

Incluso con ventanas de contexto enormes que alcanzan hasta 2 millones de tokens, simplemente meter documentos en una interfaz de chat no es una solución escalable, fiable ni rentable. Cuando necesitas procesar documentos largos, cruzar conjuntos de datos complejos o mantener contexto entre varias sesiones durante semanas de trabajo, necesitas una estrategia de memoria dedicada.

Tanto si buscas trucos ligeros para el espacio de trabajo, marcos avanzados de Generación Aumentada por Recuperación (RAG) o una infraestructura de memoria de IA realmente persistente y portable, esta guía desglosa las 10 mejores herramientas y métodos para resolver el problema de la memoria de IA en 2026.

Respuesta rápida

¿Cómo hago para que ChatGPT y Claude recuerden documentos largos y datos complejos?

La mejor forma de hacer que Claude y ChatGPT recuerden documentos largos y datos complejos es ir más allá de sus ventanas de contexto integradas y usar capas de memoria dedicadas, marcos RAG o espacios de trabajo especializados. Las mejores soluciones incluyen:

MemoryLake: La mejor para una infraestructura de memoria de IA persistente y compatible entre modelos.

Claude Projects: El mejor espacio de trabajo nativo para usuarios de Anthropic.

Google NotebookLM: La mejor para la síntesis casual de documentos.

LlamaIndex: El mejor marco de datos para desarrolladores que crean RAG personalizado.

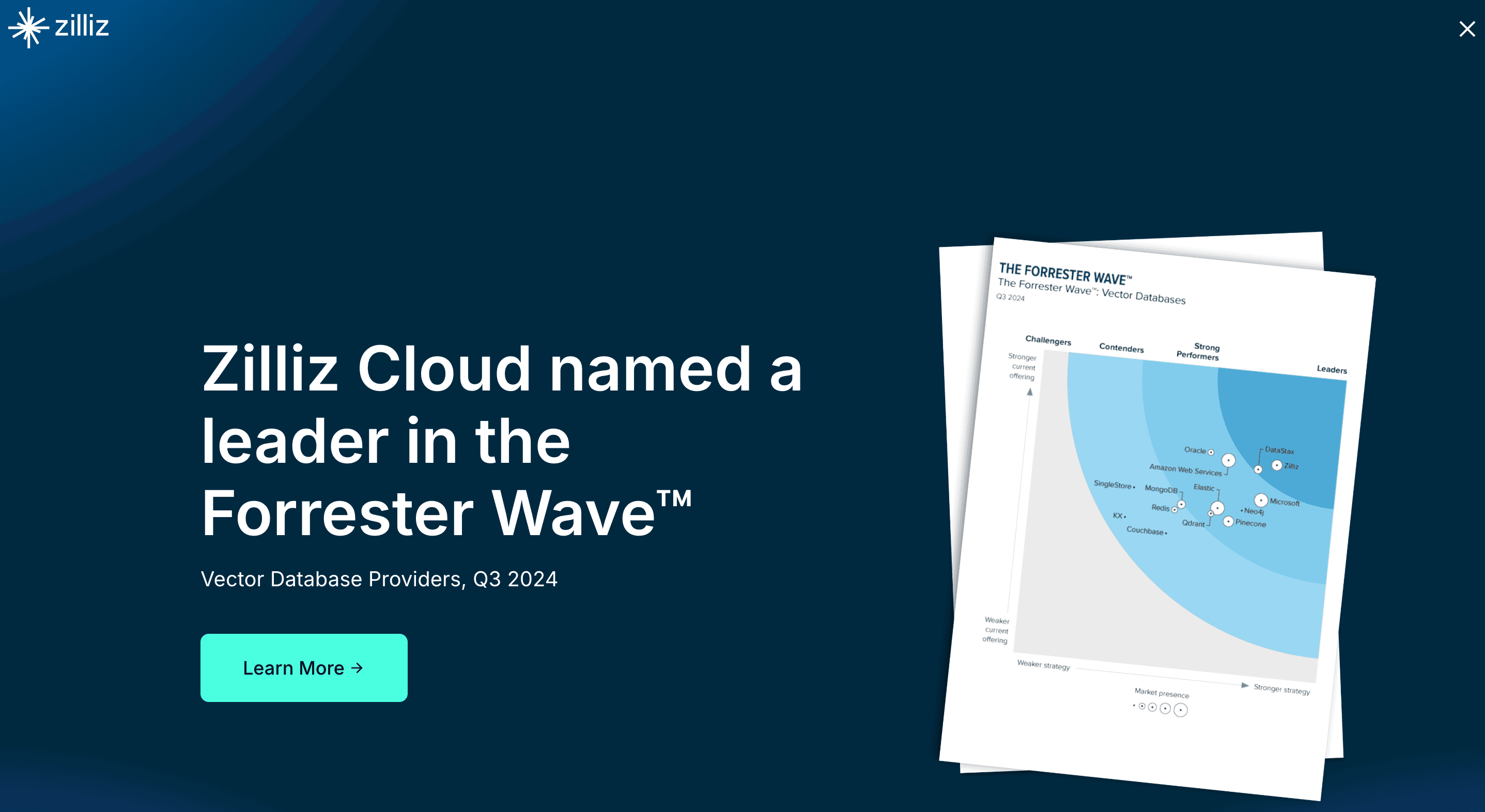

Pinecone / Zilliz: Las mejores bases de datos vectoriales para recuperación a escala empresarial.

Para lograr una recuperación a largo plazo y entre sesiones sin dependencia de proveedor, integrar un pasaporte de memoria de IA dedicado como MemoryLake es el enfoque más eficaz.

¿Qué herramienta de memoria de IA es la adecuada para ti?

Para ayudarte a navegar esta comparación, aquí tienes cómo se alinean las principales herramientas con diferentes intenciones de búsqueda y perfiles de usuario:

Para arquitectos empresariales y constructores de agentes: MemoryLake, Pinecone, Zilliz Cloud

Para desarrolladores de aplicaciones de IA: LlamaIndex, LangChain Memory, Mem0

Para trabajadores del conocimiento e investigadores: Claude Projects, Google NotebookLM, AnythingLLM

Para usuarios cotidianos de ChatGPT: ChatGPT Plus (Memoria integrada y GPTs personalizados)

Tabla comparativa rápida

Herramienta / solución | Ideal para | Persistencia a largo plazo | Categoría | Precio |

Memoria persistente y gobernada entre agentes | Excelente | Infraestructura de memoria de IA | ||

Uso rápido e individual del día a día | Moderada | Interfaz nativa de plataforma | ||

Investigación profunda en un solo ecosistema | Alta (dentro del proyecto) | Interfaz nativa de plataforma | ||

Síntesis de PDFs/notas específicos | Alta (dentro del cuaderno) | Espacio de trabajo documental | ||

Desarrolladores que enrutan datos complejos | Depende de una BD externa | Marco de datos/RAG | ||

RAG empresarial escalable y de alta velocidad | Excelente | Base de datos vectorial | ||

Construcción de agentes conversacionales complejos | Depende de una BD externa | Orquestación de agentes | ||

Personalización de aplicaciones de IA para consumidores | Alta | Capa de memoria para desarrolladores | ||

Chat privado de documentos de escritorio | Alta (local/nube) | Aplicación RAG de escritorio | ||

Datos no estructurados a enorme escala | Excelente | BD vectorial empresarial |

1. MemoryLake

MemoryLake no es solo un envoltorio de chat ni una base de datos vectorial básica; es una infraestructura de memoria de IA dedicada y persistente. Sirve como un 'segundo cerebro' portátil o pasaporte de memoria para sistemas de IA, agentes y usuarios. En lugar de encerrar tus datos en OpenAI o Anthropic, MemoryLake se sitúa entre tus datos y los LLM, permitiendo que cualquier modelo acceda a una capa de memoria unificada, gobernada y a largo plazo en múltiples sesiones y agentes.

Características clave

Portabilidad entre sesiones y entre modelos: Tu memoria viaja contigo, ya sea que estés generando prompts para Claude, ChatGPT o un modelo de código abierto.

Procesamiento de memoria multimodal: Según los materiales públicos de MemoryLake, admite el análisis integral de documentos largos, PDFs, hojas de cálculo, imágenes y contextos de audio/video.

Gobernanza y procedencia granulares: Trazabilidad inigualable: puedes rastrear fuentes exactas, controlar la privacidad y eliminar o exportar quirúrgicamente memorias específicas.

Graficación automática del conocimiento: Va más allá de la búsqueda semántica simple al estructurar datos y relaciones complejos para una recuperación de alta precisión.

Ventajas

Elimina la dependencia de proveedor; tus datos son portables y de propiedad del usuario.

Ideal para implementaciones empresariales que requieren una gobernanza estricta de datos y memoria consciente de la versión.

Resuelve el problema de estar 'perdido en el medio' recuperando solo bloques de contexto altamente relevantes en lugar de saturar el prompt.

Actúa como una verdadera capa de memoria persistente para creadores de agentes autónomos.

Desventajas

Puede estar sobrediseñado para usuarios ocasionales que solo quieren resumir una sola PDF de 3 páginas una vez.

Requiere configuración inicial para integrarse de forma segura con los flujos de trabajo de agentes empresariales o las herramientas de interfaz existentes.

Precio

MemoryLake ofrece un modelo de precios de tres niveles: un nivel gratuito para pruebas, un popular plan Pro a 19/mes (o 16/mes anualmente) y un plan Premium a 199/mes (o 166/mes anualmente), con asignaciones de tokens que escalan significativamente con cada plan.

2. ChatGPT Plus (Memoria integrada y GPTs personalizados)

OpenAI introdujo la funcionalidad de memoria nativa y los GPTs personalizados directamente en la interfaz de ChatGPT Plus. Esto permite que el modelo capte las preferencias del usuario con el tiempo y permite a los usuarios subir PDFs específicos a un GPT personalizado para una recuperación localizada.

Características clave

Memoria automática: Extrae automáticamente hechos y preferencias de la conversación casual para recordarlos en chats futuros.

Cargas a la base de conocimientos: Los usuarios pueden subir hasta 20 archivos por GPT personalizado.

Integración fluida de interfaz: Integrado directamente en las aplicaciones web y móviles.

Ventajas

No requiere configuración técnica; es muy accesible para usuarios no técnicos.

Excelente para recordar preferencias simples (por ejemplo, 'siempre escribe en Python', 'vivo en Japón').

Los GPTs personalizados proporcionan un espacio de trabajo rápido y localizado para conjuntos específicos de documentos.

Desventajas

Dependencia total del ecosistema de OpenAI.

Tiene muchas dificultades con PDFs muy complejos y de múltiples capas o con conjuntos de datos enormes.

Gestión de memoria opaca; el RAG nativo a menudo no cita páginas específicas con precisión.

Precio

Incluido en la suscripción ChatGPT Plus por $20/mes.

3. Claude Projects

La respuesta de Anthropic a la memoria documental es 'Claude Projects', disponible para usuarios Pro y Team. Permite a los usuarios crear espacios de trabajo dedicados donde pueden fijar hasta 200,000 tokens de conocimiento del proyecto (documentos, código, PDFs) que Claude consultará permanentemente cada vez que chatees dentro de ese proyecto específico.

Características clave

Base de conocimiento del proyecto: Fija texto, archivos de código y PDFs directamente en una barra lateral persistente.

Instrucciones personalizadas: Establece prompts del sistema específicos para proyectos individuales.

Integración con Artifacts: Funciona sin problemas con la capacidad de Claude para generar interfaces y artefactos de código.

Ventajas

Precisión extremadamente alta para leer dentro de su límite de 200K tokens.

Excelente para investigación en profundidad sobre un conjunto cerrado de PDFs o una base de código específica.

No requiere configuración de base de datos externa.

Desventajas

Memoria aislada. Lo que Claude aprende en el Proyecto A no se transfiere automáticamente al Proyecto B.

Límites estrictos sobre el tamaño del conocimiento; no puedes subir gigabytes de datos empresariales.

Solo funciona con modelos de Anthropic; no es portable a otros ecosistemas.

Precio

El acceso a Claude Projects está escalonado: los usuarios gratuitos obtienen acceso limitado, Pro cuesta $20/mes por acceso completo, Max cuesta $100-$200/mes para uso intensivo y Teams paga $25-$30/puesto/mes.

4. Google NotebookLM

Google NotebookLM es un espacio de trabajo de IA especializado y experimental construido puramente en torno a la comprensión de documentos. Impulsado por el modelo Gemini Pro 1.5, actúa como un asistente de investigación virtual que fundamenta sus respuestas solo en los documentos específicos (PDFs, Google Docs, URLs) que subes a un 'cuaderno' concreto.

Características clave

Fundamentación estricta en la fuente: Previene explícitamente las alucinaciones al responder estrictamente con base en los materiales cargados.

Resumen de audio: Puede generar un pódcast alojado por IA que resume tus documentos largos.

Citas en línea: Proporciona citas exactas y clicables que apuntan al texto original del documento.

Ventajas

Capacidad increíble para sintetizar PDFs largos y datos académicos o empresariales complejos.

La interfaz está optimizada específicamente para leer, tomar notas e investigar.

Las funciones de generación de audio actualmente no tienen rival en los espacios de trabajo nativos.

Desventajas

Es un ecosistema cerrado limitado por completo a los modelos de IA de Google.

No es una API ni una herramienta de infraestructura; los desarrolladores no pueden conectarlo a sus propios agentes.

Los cuadernos están aislados; no existe un grafo de memoria holístico entre cuadernos.

Precio

NotebookLM ofrece un nivel gratuito con mejoras de pago, mientras que Google AI Plus ofrece un precio promocional de $3.99/mes durante los dos primeros meses y luego $7.99/mes a partir de entonces.

5. LlamaIndex

LlamaIndex es un potente marco de datos de código abierto diseñado específicamente para conectar fuentes de datos personalizadas (PDFs, APIs, SQL, documentos complejos) con modelos de lenguaje grandes. Es muy valorado por desarrolladores de IA que construyen aplicaciones avanzadas de RAG (Generación Aumentada por Recuperación).

Características clave

Analizadores de datos avanzados: Herramientas especializadas para analizar PDFs complejos, tablas anidadas y documentos jerárquicos.

Enrutamiento inteligente: Puede dirigir consultas a diferentes índices de datos según la complejidad del prompt del usuario.

Conectores de datos: Admite cientos de fuentes de datos a través de LlamaHub.

Ventajas

El estándar de oro para estructurar datos desordenados antes de pasarlos a un LLM.

Agnóstico al modelo; funciona perfectamente con OpenAI, Anthropic, modelos locales, etc.

Altamente personalizable para flujos de trabajo empresariales complejos.

Desventajas

Es un marco, no una base de datos ni una aplicación de memoria lista para usar. Requiere conocimientos de programación (Python/TS).

Requiere que los desarrolladores ensamblen sus propias bases de datos vectoriales y almacenamiento persistente.

Puede ser excesivamente complejo para casos de uso simples.

Precio

LlamaParse ofrece un nivel gratuito, un plan Starter de 50/mes, un plan Pro de 500/mes y precios empresariales personalizados.

6. Pinecone

Pinecone es una base de datos vectorial nativa de la nube y totalmente gestionada, diseñada para la recuperación de IA de alto rendimiento. Aunque no es una 'app de memoria de IA' en el sentido del consumidor, es el motor subyacente que impulsa la memoria a largo plazo y el RAG para miles de aplicaciones de IA generativa.

Características clave

Arquitectura sin servidor: Escala automáticamente según el almacenamiento y el volumen de consultas sin aprovisionamiento manual.

Latencia ultrabaja: Velocidades de recuperación de milisegundos incluso en miles de millones de incrustaciones vectoriales.

Búsqueda híbrida: Combina búsqueda vectorial densa con búsqueda de palabras clave dispersa para obtener mejor precisión en documentos complejos.

Ventajas

Escala y fiabilidad de nivel empresarial para bibliotecas de documentos enormes.

Totalmente agnóstico al modelo.

Cero sobrecarga de mantenimiento de infraestructura para los desarrolladores.

Desventajas

Requiere una ingeniería considerable para convertirlo en un 'sistema de memoria'. Solo almacena vectores, no la lógica de cuándo y cómo un agente debería recordar.

No analiza PDFs ni documentos de forma nativa; debes encargarte tú mismo de la ingesta y fragmentación de documentos.

Precio

Pinecone ofrece un nivel gratuito, un plan Starter de 50/mes, un plan Pro de 500/mes y precios empresariales personalizados.

7. LangChain Memory

LangChain es el marco de orquestación de código abierto más popular para construir agentes de IA. Sus módulos dedicados de 'Memory' permiten a los desarrolladores implementar distintos tipos de memoria conversacional (por ejemplo, memoria de búfer, memoria de resumen, memoria respaldada por vectores) en sus integraciones personalizadas de Claude o ChatGPT.

Características clave

Tipos de memoria enchufables: Elige entre ConversationBufferMemory, ConversationSummaryMemory o memoria de entidades especializada.

Flujos de trabajo agénticos: Permite que los modelos decidan de forma autónoma cuándo buscar en su memoria.

Amplias integraciones: Se conecta sin problemas con casi todos los LLM y bases de datos vectoriales del mercado.

Ventajas

Increíblemente flexible para construir agentes de IA complejos y de múltiples pasos.

Fuerte apoyo de la comunidad y tutoriales interminables para manejar el contexto de documentos.

Agnóstico al modelo y muy portable.

Desventajas

Curva de aprendizaje notoriamente pronunciada y documentación que cambia con frecuencia.

Los módulos de memoria nativos pueden ser rudimentarios y requerir bases de datos externas (como Pinecone) para una persistencia real a largo plazo.

Requiere experiencia en programación.

Precio

LangChain en sí es de código abierto y gratuito. Su plataforma empresarial premium, LangSmith (utilizada para rastreo, pruebas y monitorización de agentes), ofrece un nivel gratuito para desarrolladores, un nivel Plus a $39/mes y precios Enterprise personalizados.

8. Mem0

Mem0 (antes Embedchain) se presenta como una capa de memoria de código abierto para aplicaciones de IA personalizadas. Abstrae la complejidad de gestionar bases de datos, almacenes vectoriales e inyección de prompts, ofreciendo a los desarrolladores una API sencilla para almacenar y recuperar el historial del usuario y el contexto de documentos.

Características clave

API unificada de memoria: Puntos finales sencillos para añadir, buscar y obtener memoria para IDs de usuario o de agente específicos.

Memoria adaptativa: Actualiza y refina automáticamente la memoria a medida que las preferencias del usuario cambian con el tiempo.

Memoria multinivel: Distingue entre memoria a nivel de usuario, a nivel de agente y a nivel de sesión.

Ventajas

Acelera enormemente el tiempo de desarrollo para los creadores que quieren memoria persistente sin orquestar bases de datos vectoriales.

Fuerte enfoque en la personalización y la actualización dinámica de la memoria.

Disponibilidad de código abierto con opciones de nube gestionada.

Desventajas

Sigue siendo un producto emergente en comparación con una infraestructura empresarial profundamente consolidada.

Está mejor adaptado a la personalización del usuario que a la ingesta masiva de PDFs / almacenes de datos a nivel empresarial.

Depende en gran medida de la calidad subyacente de su auto-resumen.

Precio

Mem0 ofrece un modelo de precios de cuatro niveles: un nivel Hobby gratuito, un plan Starter de 19/mes, un plan Pro destacado de 249/mes con límites altos y un nivel Enterprise con precio personalizado, uso ilimitado y soporte premium.

9. AnythingLLM

AnythingLLM es una aplicación de IA todo en uno, de escritorio y basada en la nube, diseñada específicamente para convertir tus documentos privados, PDFs y datos en un chatbot seguro. Es muy utilizada por investigadores y profesionales que quieren memoria prioritaria en la privacidad sin subir archivos sensibles a LLMs públicos en la nube.

Características clave

Espacios de trabajo: Organiza distintos conjuntos de PDFs y documentos largos en espacios de trabajo aislados.

Opción de privacidad 100%: Puede ejecutarse por completo en local con modelos de código abierto (como Llama 3) para procesar documentos sin conexión.

Gestión multiusuario: La versión en la nube/servidor admite roles y permisos de equipo para el acceso a documentos.

Ventajas

Interfaz increíblemente fácil para que no desarrolladores construyan sistemas RAG muy capaces.

Máximo control de privacidad, especialmente para PDFs legales o financieros sensibles.

El backend agnóstico te permite alternar entre modelos locales, OpenAI, Anthropic y bases de datos vectoriales personalizadas.

Desventajas

Funciona principalmente como una aplicación independiente en lugar de una capa de infraestructura sin interfaz para ecosistemas complejos de agentes.

La versión de escritorio puede consumir muchos recursos si ejecuta modelos locales para el análisis de documentos grandes.

Carece de la gobernanza avanzada, consciente de la versión, de una infraestructura de memoria dedicada.

Precio

AnythingLLM ofrece una opción gratuita autoalojada y tres planes de pago: Basic (50/mes), Popular Pro (99/mes) y Enterprise con precio personalizado.

10. Zilliz Cloud

Zilliz Cloud es la base de datos vectorial empresarial totalmente gestionada creada por los creadores de Milvus. Cuando se trata de cantidades astronómicas de datos complejos, PDFs y documentos organizativos, Zilliz proporciona la infraestructura de recuperación de gran potencia necesaria para darle a Claude o ChatGPT una recuperación casi instantánea.

Características clave

Escala masiva: Diseñada para manejar de forma fiable miles de millones de incrustaciones vectoriales.

Indexación avanzada: Usa algoritmos de indexación propietarios para capacidades de búsqueda híbrida altamente optimizadas.

Autoescalado y alta disponibilidad: SLA empresarial, seguridad integrada y funciones de cumplimiento listas para usar.

Ventajas

Una de las infraestructuras vectoriales más robustas y escalables disponibles a nivel mundial.

Rendimiento excepcional bajo cargas de alta concurrencia.

Se integra en profundidad con todos los marcos de IA principales (LlamaIndex, LangChain).

Desventajas

Es infraestructura pura; no hay una interfaz de chat para usuarios ni un analizador de documentos nativo.

Excesivo para equipos pequeños o usuarios individuales que solo quieren chatear con unos pocos PDFs.

Requiere un equipo dedicado de ingeniería de datos para diseñar el flujo de trabajo de la memoria.

Precio

Zilliz Cloud ofrece un modelo de precios de cuatro niveles: un nivel gratuito para aprender, un nivel Standard (que proporciona tanto una opción Serverless basada en uso como una opción de clúster dedicado a partir de 99/mes), un popular nivel Enterprise a partir de 155/mes y un nivel Business Critical con precio personalizado para industrias reguladas.

Mejor herramienta por caso de uso

Para usuarios ocasionales e investigación rápida: Si solo necesitas resumir un informe puntual, ChatGPT Plus o Google NotebookLM ofrecen la menor barrera de entrada.

Para análisis profundo de PDFs: Si eres leal a Anthropic, Claude Projects ofrece un excelente espacio de trabajo de circuito cerrado para proyectos específicos.

Para desarrolladores de aplicaciones de IA: LlamaIndex combinado con Mem0 o una base de datos vectorial es excelente para construir canalizaciones RAG personalizadas.

Para infraestructura de memoria de IA persistente y compatible entre modelos: Si estás construyendo agentes empresariales o necesitas un 'segundo cerebro' duradero y gobernado que viaje sin fricciones entre cualquier modelo o fuente de datos, MemoryLake es la opción principal.

Por qué Claude y ChatGPT tienen dificultades con documentos largos, PDFs y datos complejos

Si Claude puede aceptar una ventana de contexto de 200K tokens, ¿por qué sigue olvidando cosas? La respuesta está en cómo los LLM procesan la información:

El fenómeno de 'perdido en el medio': Una investigación extensa muestra que, cuando se alimenta a los LLM con documentos enormes, son muy precisos al recordar la información del principio y del final del prompt, pero la precisión de recuperación se desploma para los datos enterrados en el medio.

Arquitectura sin estado: De forma predeterminada, los LLM no mantienen estado. Cada vez que envías un nuevo prompt, el modelo debe volver a leer todo el historial de la conversación. Esto conduce a un consumo masivo de tokens y a una truncación eventual cuando la ventana de contexto se llena.

Amnesia entre sesiones: Una vez que cierras un hilo de chat, ese contexto normalmente desaparece. Si quieres hablar del mismo PDF de 50 páginas el próximo martes, tienes que volver a subirlo, desperdiciando tiempo y cómputo.

Incapacidad para actualizar hechos: Si cambia una fila específica en tu hoja de cálculo cargada, no puedes 'parchear' fácilmente la memoria de la IA. Debes volver a subir el archivo completo.

Conclusión

Hacer que Claude y ChatGPT recuerden de forma fiable documentos largos y datos complejos ya no consiste simplemente en pegar más texto en el cuadro de chat. A medida que los casos de uso de IA maduran, la necesidad de pasar de trucos temporales de contexto a sistemas de memoria duraderos se vuelve crítica.

Si solo necesitas recuperación ligera para una tarea aislada, herramientas más sencillas como Claude Projects, Google NotebookLM o AnythingLLM pueden ser suficientes. Hacen un excelente trabajo de síntesis documental básica dentro de sus respectivos silos. Los desarrolladores que quieran construir sus propios pipelines desde cero encontrarán un valor enorme en LlamaIndex combinado con bases de datos vectoriales como Pinecone o Zilliz.

Pero si necesitas una memoria duradera, portable y gobernada entre documentos, sesiones, herramientas y modelos, MemoryLake es el mejor lugar para empezar.

En lugar de conformarte con soluciones temporales o encerrar los datos de tu organización en un único proveedor de IA, MemoryLake se posiciona como una verdadera infraestructura de memoria de IA de propiedad del usuario. Según la arquitectura de la empresa, conecta sin fricciones tus datos complejos, PDFs y contexto histórico en un pasaporte de memoria portátil, garantizando que tus agentes de IA siempre sean precisos, conscientes del contexto y gobernados. Explora MemoryLake si quieres dar a tus sistemas de IA un segundo cerebro persistente en lugar de solo otra integración de base de datos.

Preguntas frecuentes

¿Por qué Claude o ChatGPT no pueden simplemente leer de forma nativa un PDF de 500 páginas?

Aunque modelos como Claude tienen ventanas de contexto enormes, pasar un PDF de 500 páginas directamente al prompt es computacionalmente costoso, lento y propenso al efecto de 'perdido en el medio', donde la IA alucina o ignora datos enterrados profundamente en el texto.

¿Es suficiente la memoria de chat integrada para flujos de trabajo serios?

Para preferencias cotidianas (como reglas de formato), la memoria de chat integrada está bien. Sin embargo, para flujos de trabajo empresariales serios que involucren contratos legales, hojas de cálculo enormes o amplios repositorios de investigación, la memoria integrada es insuficiente. Carece de la recuperación compleja, la trazabilidad y la persistencia entre sesiones que requieren los usuarios empresariales.

¿Cuál es la diferencia entre RAG, bases de datos vectoriales y capas de memoria de IA?

Bases de datos vectoriales (como Pinecone): Los motores de almacenamiento en bruto para representaciones matemáticas del texto.

RAG (Generación Aumentada por Recuperación): El proceso de buscar en una base de datos y alimentar texto relevante a un LLM.

Capas de memoria de IA (como MemoryLake): Una infraestructura holística y persistente que regula cómo y cuándo recuerda una IA, actuando como un pasaporte portátil de contexto, datos e interacciones del usuario a través de múltiples modelos.