Las 10 mejores capas de memoria gratuitas para agentes de programación en 2026 (probadas y comparadas)

Joy

Introducción

Los agentes de programación pierden constantemente el contexto entre sesiones. Repetir una y otra vez el trasfondo del proyecto, las reglas de la arquitectura y las preferencias de codificación es costoso y frustrante. Aunque las enormes ventanas de contexto son útiles, el relleno de prompts no es una solución escalable, rentable ni estructurada a largo plazo.

Precisamente por eso el mercado se ha orientado hacia infraestructuras de memoria de IA dedicadas. Una verdadera capa de memoria no es solo el historial de chat o una base de datos vectorial en bruto; es un sistema que gestiona la persistencia, la continuidad entre sesiones y la portabilidad entre agentes.

En esta guía, evaluamos el panorama según el posicionamiento del producto, la documentación pública, la adecuación para desarrolladores y el alcance de la arquitectura de memoria para traerte las 10 mejores capas de memoria gratuitas y amigables con el código abierto para agentes de programación. Analizaremos plataformas de memoria pura como MemoryLake, marcos de estado de agentes y bases de datos vectoriales que a menudo se evalúan dentro del stack de memoria, para ayudarte a encontrar la base adecuada para tus herramientas de desarrollo con IA.

Las mejores capas de memoria gratuitas para agentes de programación de un vistazo

MemoryLake: La mejor capa general de infraestructura de memoria persistente de IA, que ofrece memoria gobernada y portátil entre modelos, agentes y sesiones.

Mem0: Una robusta capa de memoria de código abierto diseñada para añadir memoria personalizada a largo plazo a asistentes y agentes de IA.

Letta: Un sistema avanzado de gestión del estado de los agentes (originado a partir de MemGPT) creado para entornos de ejecución con estado y una arquitectura de memoria por niveles.

Zep: Una capa de memoria rápida y de baja latencia, centrada en la extracción de hechos en tiempo real y en el contexto temporal para aplicaciones de IA.

LangMem: El marco nativo de gestión de memoria de LangChain, ideal para desarrolladores que ya están profundamente inmersos en el ecosistema de LangGraph.

Cognee: Una herramienta de memoria muy conceptual, basada en grafos, diseñada para estructurar datos y seguir relaciones para LLMs.

Graphiti: Una biblioteca especializada de memoria en grafos de conocimiento creada por Zep para gestionar relaciones complejas y cambiantes dinámicamente.

Supermemory: Una herramienta de "segundo cerebro" de código abierto y fácil de usar con interfaz, para IA, que gestiona la ingesta genérica de datos y la curación de memoria.

Qdrant: Una base de datos vectorial de código abierto de alto rendimiento, utilizada con frecuencia como capa de recuperación fundamental para la memoria personalizada de agentes.

Pinecone: Una base de datos vectorial totalmente gestionada y altamente escalable que los desarrolladores suelen evaluar al construir sus propios stacks de memoria basados en RAG.

Tabla comparativa

Producto | Ideal para | Nivel gratuito / Código abierto | Enfoque de memoria |

Infraestructura de memoria portátil y gobernada | Sí / Nivel gratuito disponible | Persistencia, continuidad entre agentes | |

Memoria personalizada para agentes | Sí / Núcleo de código abierto | Extracción de entidades y personalización | |

Memoria de agente por niveles, tipo sistema operativo | Sí / Código abierto | Gestión de estado núcleo/archivo | |

Extracción de hechos de baja latencia | Sí / Núcleo de código abierto | Memoria temporal y resúmenes | |

Usuarios del ecosistema LangChain | Sí / Código abierto | Memoria de agente ligada al framework | |

Conocimiento basado en grafos | Sí / Código abierto | Seguimiento de relaciones conceptuales | |

Memoria de grafos temporal | Sí / Código abierto | Aristas dinámicas del grafo | |

Segundo cerebro visual para IA | Sí / Código abierto | Memoria general de datos/marcadores | |

Backends personalizados de alto rendimiento | Sí / Código abierto | Recuperación por similitud vectorial | |

Almacenamiento vectorial gestionado | Sí / Nivel gratuito disponible | Búsqueda vectorial sin servidor |

1. MemoryLake

MemoryLake se posiciona como una capa de infraestructura de memoria persistente de IA diseñada para actuar como un "segundo cerebro" unificado para sistemas de IA. En lugar de vincular la memoria a un único runtime de agente o LLM, MemoryLake abstrae la memoria en una plataforma gobernada y propiedad del usuario. Los equipos que construyen agentes de programación sofisticados la evalúan con frecuencia porque funciona como un "pasaporte de memoria", permitiendo que el contexto, el conocimiento del codebase y las preferencias del desarrollador se trasladen sin problemas entre distintas sesiones, herramientas y modelos subyacentes.

Características principales

Continuidad entre agentes: La memoria persiste entre distintos entornos de ejecución de agentes y LLMs, garantizando una capa de contexto unificada.

Gobernanza y trazabilidad: Controles integrados para el origen de la memoria, auditoría y eliminación precisa.

Alcance multimodal: Gestiona estructuras de conocimiento complejas y de múltiples formatos, esenciales para entornos de programación diversos.

Neutralidad de plataforma: Desacoplada de proveedores específicos de LLM o de marcos de orquestación rígidos.

Ventajas

Resuelve de forma natural el problema de la amnesia entre sesiones sin requerir que los desarrolladores creen bucles de memoria personalizados.

Se centra profundamente en la gobernanza de datos, lo que la hace muy adecuada para entornos profesionales de desarrollo.

Su arquitectura portátil evita la dependencia de un agente de programación o framework específico.

Gestiona memoria estructurada en lugar de simples registros de chat en bruto.

Desventajas

Al ser una capa de infraestructura integral, requiere un cambio de mentalidad frente a simplemente añadir una base de datos SQLite/vectorial ligera.

Es excesiva para scripts CLI básicos de una sola interacción que no requieren estado continuo.

Precios

Ofrece un nivel gratuito para desarrolladores y uso estándar, con precios que escalan según la infraestructura, las necesidades de gobernanza y los modelos de despliegue. Consulta el sitio web del proveedor para conocer los precios más recientes para empresas o autohospedaje.

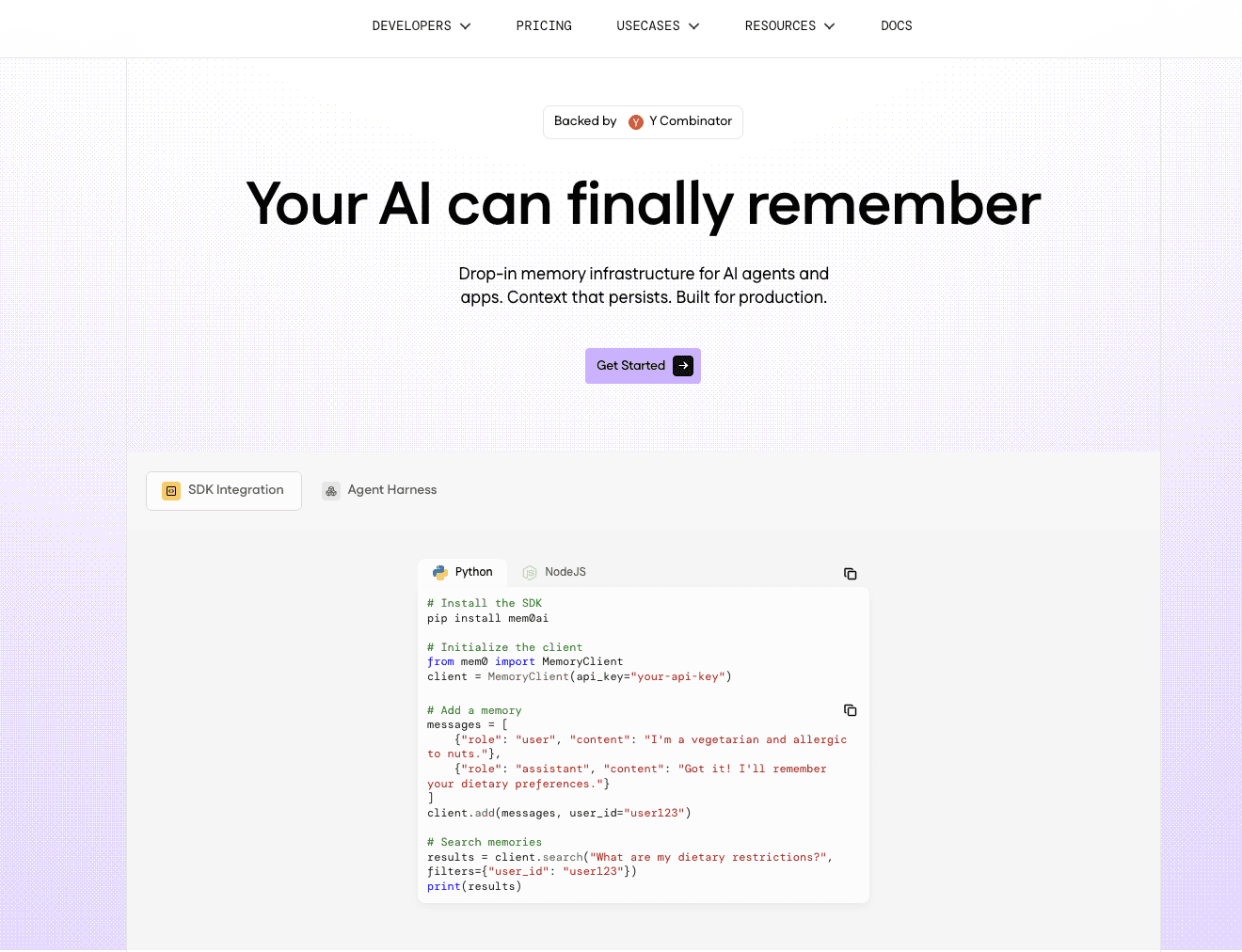

2. Mem0

Mem0 es una popular capa de memoria de código abierto diseñada para crear aplicaciones de IA personalizadas. Se centra especialmente en extraer entidades, preferencias y contexto de las interacciones para construir un perfil de memoria a largo plazo para usuarios o agentes. En el contexto de los agentes de programación, Mem0 se utiliza para recordar hábitos específicos del desarrollador, claves de API (si se gestionan de forma segura) y frameworks de codificación preferidos a lo largo de distintas interacciones.

Características principales

Extracción de entidades: Identifica y almacena automáticamente preferencias y hechos clave de los prompts del desarrollador.

Arquitectura multiinquilino: Diseñada para gestionar el aislamiento de memoria de distintos usuarios y agentes.

Híbrido vectorial y relacional: Usa una mezcla de mecanismos de almacenamiento para equilibrar la búsqueda semántica con la coincidencia exacta de entidades.

Ventajas

API muy amigable para desarrolladores y fácil de integrar en proyectos Python/TypeScript existentes.

Fuerte respaldo de la comunidad y rápido desarrollo de código abierto.

Excelente para la personalización, asegurando que el agente de programación recuerde las particularidades del usuario.

Desventajas

Puede tener dificultades con arquitecturas de codebase muy complejas e interconectadas en comparación con sistemas profundos basados en grafos.

Depende en gran medida de prompts de extracción precisos; si el LLM no extrae un hecho, este no se almacena.

Precios

El marco central es de código abierto y gratuito. Mem0 también ofrece un servicio en la nube gestionado con un generoso nivel gratuito, mientras que el uso en producción de la API se factura en función de las solicitudes y el almacenamiento.

3. Letta

Letta surgió de los creadores del proyecto de investigación MemGPT. Funciona como un sistema avanzado de gestión del estado del agente, proporcionando de forma efectiva a los agentes de IA una arquitectura de memoria por niveles similar a la de un sistema operativo. Letta está diseñado para entornos de ejecución con estado, dividiendo la memoria en "núcleo" (siempre en contexto) y "archivo" (cargado cuando se necesita). Para agentes de programación que trabajan con codebases enormes, este enfoque por niveles permite al agente autogestionar qué contexto del codebase necesita en cada momento.

Características principales

Sistema de memoria por niveles: Separación clara entre la memoria de trabajo activa y el almacenamiento de archivo a largo plazo.

Gestión de memoria agentic: El propio LLM decide cuándo leer o escribir en su memoria a largo plazo.

Ejecución con estado: Mantiene el estado exacto del agente a lo largo de sesiones interrumpidas.

Ventajas

Enfoque altamente académico y robusto para la gestión de la ventana de contexto.

Excelente para la ilusión de contexto infinito, ideal para tareas de programación muy complejas y prolongadas.

De código abierto y muy transparente en sus operaciones de memoria.

Desventajas

Curva de aprendizaje pronunciada; los desarrolladores deben adoptar el paradigma de orquestación de agentes de MemGPT.

Alta latencia durante las operaciones de paginación de memoria si el agente decide buscar con frecuencia en la memoria archivada.

Precios

Letta es de código abierto y gratuito para autohospedaje. Las versiones en la nube o para empresas pueden tener precios variables según el uso y la infraestructura gestionada.

4. Zep

Zep es una capa de memoria diseñada específicamente para aplicaciones de IA de baja latencia. Se centra en la recuperación rápida, la conciencia temporal y la resumisión automatizada de historiales de chat y documentos. Cuando se integra en un agente de programación, Zep actúa como un proceso de fondo invisible que destila continuamente largas sesiones de depuración en hechos concisos, asegurando que la ventana de contexto no se llene con iteraciones de código fallidas.

Características principales

Resumen automatizado: Condensa continuamente el historial de chat en resúmenes densos.

Baja latencia: Escrito en Go, optimizado para operaciones de lectura/escritura increíblemente rápidas.

Contexto temporal: Entiende cuándo se aprendieron los hechos, lo cual es vital para distinguir código obsoleto de código nuevo.

Ventajas

Extremadamente rápido, añade una sobrecarga mínima a los tiempos de respuesta del agente.

Reduce los costes en tokens al comprimir automáticamente las ventanas de contexto.

Sustituto sencillo para la memoria estándar del historial de chat.

Desventajas

Las funciones avanzadas de grafo de conocimiento están reservadas en gran medida para su nivel empresarial.

Está menos centrado en la portabilidad entre múltiples agentes que las plataformas enfocadas primero en infraestructura.

Precios

Zep ofrece una Community Edition de código abierto que es gratuita para autohospedaje. Zep Cloud ofrece un nivel gratuito para evaluación, con niveles de pago basados en la escala de usuarios y capacidades avanzadas de grafo.

5. LangMem

Desarrollado por el equipo detrás de LangChain, LangMem es una herramienta de memoria ligada al framework diseñada para gestionar la memoria a largo plazo y el estado de agentes construidos sobre LangGraph. Proporciona primitivas para extraer, almacenar y actualizar memorias de agentes. Para los desarrolladores que ya están plenamente comprometidos con el ecosistema de LangChain para construir sus flujos de trabajo de programación, LangMem es la opción nativa más natural para añadir persistencia entre sesiones.

Características principales

Integración con LangGraph: Profundamente integrada en la lógica de orquestación de LangChain y LangGraph.

Bucles de actualización de memoria: Mecanismos integrados para ejecutar tareas en segundo plano que refinan y consolidan la memoria.

Gestión del estado: Manejo nativo de estados complejos de agentes múltiples.

Ventajas

Experiencia de desarrollo fluida si ya estás usando LangChain.

Fuertes abstracciones para la consolidación de memoria en segundo plano.

Esquemas de memoria altamente personalizables.

Desventajas

Muy acoplado al ecosistema de LangChain; no es ideal si quieres una capa de memoria portable y agnóstica al framework.

Puede heredar la complejidad de abstracción y la sobrecarga asociadas a menudo con LangChain.

Precios

LangMem es un proyecto de código abierto y gratuito. Sin embargo, los despliegues gestionados a través de LangSmith o servicios empresariales relacionados implicarán los costes estándar de la plataforma LangChain.

6. Cognee

Cognee es un marco de memoria de código abierto que utiliza bases de datos de grafos para construir comprensión conceptual para LLMs. En lugar de depender solo de embeddings vectoriales, Cognee estructura la información en relaciones. Para agentes de programación, Cognee resulta interesante porque teóricamente puede mapear una arquitectura de software (por ejemplo, "la Función A llama a la Función B, que depende de la Biblioteca C") y almacenar esa memoria relacional de forma persistente.

Características principales

Memoria basada en grafos: Utiliza un backend de grafo de conocimiento para almacenar relaciones explícitas.

Recuperación determinista: Reduce las alucinaciones al depender de caminos estructurados del grafo en lugar de una búsqueda semántica puramente probabilística.

Pipeline modular: Pipelines de ingesta personalizables para texto y datos.

Ventajas

Excelente para mapear arquitecturas complejas y relacionales de codebases.

Muy determinista, algo crucial en entornos de programación estrictos.

Totalmente de código abierto y flexible.

Desventajas

La configuración es compleja; requiere comprender y gestionar estructuras de bases de datos de grafos.

Más experimental y orientado a investigación en comparación con las APIs plug-and-play.

Precios

Cognee es de código abierto y gratuito. Los costes están asociados únicamente a la infraestructura subyacente (por ejemplo, Neo4j u otras bases de datos de grafos) que elijas para alojarlo.

7. Graphiti

Graphiti es una biblioteca especializada desarrollada por Zep y diseñada para construir grafos de conocimiento temporales y dinámicos para agentes de IA. A diferencia de las bases de datos de grafos estáticas, Graphiti se centra en cómo cambian las relaciones con el tiempo. En el contexto de un agente de programación, esto es muy útil para seguir la evolución de un codebase: recordar no solo qué hace hoy un endpoint de API, sino qué hacía antes y por qué quedó obsoleto.

Características principales

Aristas temporales: Registra el nacimiento, la modificación y la decadencia de las relaciones en el grafo.

Mezcla episódica y semántica: Combina memoria de eventos basada en el tiempo con memoria conceptual basada en hechos.

Actualizaciones dinámicas: Fusiona automáticamente nodos y actualiza aristas a medida que llega nueva información.

Ventajas

Brillante para seguir proyectos de software en evolución e historiales de depuración a lo largo del tiempo.

Maneja bien la información contradictoria gracias al uso de marcas temporales.

Biblioteca de Python de código abierto y fácil de probar.

Desventajas

Muy especializada; maneja la lógica de grafos, pero requiere que tú conectes el resto de la arquitectura del agente.

Puede consumir muchos recursos ejecutar la fusión dinámica de nodos a gran escala.

Precios

Graphiti está disponible como biblioteca de código abierto bajo una licencia permisiva, lo que la hace completamente gratuita para usar, modificar y desplegar en tu propia infraestructura.

8. Supermemory

Supermemory se posiciona como un "segundo cerebro" de código abierto para IA. Aunque está un poco más orientado al consumidor y a datos genéricos que a herramientas de desarrollo puras, los desarrolladores que construyen asistentes de programación personales suelen evaluarlo. Proporciona una interfaz visual para guardar fragmentos, marcadores y archivos Markdown, que luego la IA puede recuperar. Es, esencialmente, una capa de memoria gestionada con un fuerte componente de interfaz de usuario.

Características principales

Panel visual: Incluye una interfaz fácil de usar para ver exactamente lo que la IA ha recordado.

Ingesta multifuente: Procesa fácilmente páginas web, fragmentos de código y texto estándar.

Pila de código abierto: Construida sobre tecnologías web modernas, lo que facilita el autohospedaje.

Ventajas

Interfaz de usuario de primer nivel para gestionar y curar manualmente la memoria del agente.

Muy fácil de desplegar y usar como backend de memoria para un asistente personal de desarrollo.

De código abierto y con una comunidad muy activa.

Desventajas

Carece de integraciones profundas y nativas con IDEs o de herramientas complejas de orquestación multiagente.

Está mejor adaptado como base de conocimiento genérica que como gestor estricto y automatizado del estado de codificación.

Precios

Supermemory es de código abierto y gratuito para autohospedaje. Ofrecen niveles alojados o premium.

9. Qdrant

Qdrant no es una capa de memoria lista para usar; es una base de datos vectorial de código abierto y alto rendimiento. Sin embargo, debe incluirse en esta comparación porque la gran mayoría de los desarrolladores intentan inicialmente construir la memoria de su agente de programación usando solo una base de datos vectorial. Qdrant destaca en la búsqueda por similitud y la recuperación semántica, lo que lo convierte en la capa de almacenamiento fundamental sobre la que se construyen muchas arquitecturas de memoria personalizadas.

Características principales

Búsqueda vectorial de alta velocidad: Optimizada para recuperación semántica a gran escala.

Filtrado enriquecido de payload: Permite a los desarrolladores adjuntar metadatos (como ID de sesión o rutas de archivo) y filtrar búsquedas con rigor.

Arquitectura basada en Rust: Extremadamente rápida y eficiente en memoria.

Ventajas

Control total; puedes diseñar tu lógica de recuperación de memoria exactamente como quieras.

De código abierto y altamente escalable, desde entornos locales hasta clústeres empresariales.

Rendimiento inigualable para cargas de trabajo puras de RAG (Retrieval-Augmented Generation).

Desventajas

Es solo la base de datos. Debes construir tú mismo la lógica de resumización, continuidad entre sesiones y síntesis de memoria.

Carece de funciones de portabilidad entre agentes integradas de serie.

Precios

Qdrant ofrece una versión de código abierto completamente gratuita para uso local y autohospedado. Qdrant Cloud proporciona un nivel gratuito gestionado, con precios basados en el uso para producción a escala.

10. Pinecone

De forma similar a Qdrant, Pinecone es una base de datos vectorial totalmente gestionada en lugar de una plataforma de memoria lista para usar. La incluimos porque es una de las herramientas más populares que usan los desarrolladores al poner en marcha contexto a largo plazo para agentes de programación con IA. La arquitectura sin servidor de Pinecone significa que los desarrolladores pueden volcar embeddings de código en la base de datos sin preocuparse por el aprovisionamiento de infraestructura.

Características principales

Arquitectura sin servidor: No hay infraestructura que gestionar; altamente escalable desde el primer momento.

Indexación en tiempo real: Los cambios del codebase y los registros de chat se pueden buscar casi al instante.

Amplio ecosistema: Se integra sin problemas con casi todos los frameworks de IA y herramientas de orquestación.

Ventajas

Increíblemente fácil de empezar a usar, sin sobrecarga de infraestructura.

Muy fiable para arquitecturas de recuperación de nivel empresarial.

Excelente documentación y soporte para desarrolladores.

Desventajas

Proporciona recuperación, no una "memoria" real. No gestiona automáticamente el estado, las actualizaciones ni el olvido.

No es de código abierto; dependes de su entorno de nube gestionada.

Precios

Pinecone ofrece un generoso nivel gratuito para desarrolladores que están empezando. A partir de ahí, utiliza un modelo de precios sin servidor basado en operaciones de lectura/escritura y capacidad de almacenamiento.

¿Qué capa de memoria es mejor para diferentes casos de uso?

La mejor opción general para infraestructura de memoria portátil y gobernada

Si estás construyendo herramientas de desarrollo de IA complejas o gestionando flujos de trabajo de programación empresariales, MemoryLake es la opción más sólida. Su enfoque en la continuidad entre agentes, la portabilidad y la gobernanza significa que actúa como una verdadera capa de infraestructura, no solo como una caché de contexto temporal.

La mejor para simulación de sistema operativo agentic y entornos de ejecución con estado

Si tu agente necesita autogestionar grandes cantidades de contexto del codebase y ejecutarse continuamente en segundo plano, Letta ofrece la arquitectura de memoria por niveles más avanzada del mercado.

La mejor para desarrolladores nativos del framework

Si toda tu pila ya está construida sobre LangChain y LangGraph, LangMem es el camino de menor resistencia, ya que ofrece integración profunda y bucles nativos de gestión del estado.

La mejor para backends de recuperación vectorial pura

Si eres un desarrollador que prefiere construir desde cero una lógica personalizada de síntesis de memoria y solo necesita un motor de almacenamiento ultrarrápido, Qdrant de código abierto o Pinecone gestionado son los estándares de la industria.

Capa de memoria vs base de datos vectorial vs historial de chat

Al evaluar el stack de memoria para flujos de trabajo de programación, es crucial entender las distintas capas del ecosistema:

Historial de chat

Qué es: La transcripción en bruto de la conversación entre el desarrollador y el agente.

Qué le falta: No es duradero. Una vez que la ventana de contexto se llena, los mensajes antiguos se descartan. No puede transferirse sin problemas de una sesión a otra mañana.

Base de datos vectorial (p. ej., Qdrant, Pinecone)

Qué es: Una base de datos especializada que almacena datos como vectores matemáticos, permitiendo la búsqueda semántica (encontrar código que sea "conceptualmente similar").

Qué le falta: Una base de datos vectorial es un backend de almacenamiento y recuperación. No sabe automáticamente qué recordar, cómo resumir ni cuándo actualizar información obsoleta. Debes construir esa lógica.

Capa de memoria (p. ej., MemoryLake, Mem0)

Qué es: Una capa de inteligencia situada por encima de la base de datos. Gestiona el ciclo de vida del conocimiento. Una verdadera capa de memoria extrae automáticamente hechos, actualiza estados cambiantes del proyecto, persiste el contexto entre distintas sesiones y permite portar la memoria entre diferentes modelos y herramientas de IA.

Por qué la necesitan los agentes de programación: La colaboración en proyectos a largo plazo requiere reutilización selectiva, estructura y persistencia, no solo recuperación semántica ciega.

Qué buscar en una capa de memoria para agentes de programación

Al seleccionar una plataforma, los desarrolladores deberían evaluarla según estos criterios:

Memoria persistente: El sistema debe sobrevivir al final de una sesión de IDE o de un runtime CLI.

Reutilización de contexto entre sesiones: Debería inyectar automáticamente tus preferencias de codificación específicas (por ejemplo, "usar siempre TypeScript estricto") sin que tengas que pedirlo.

Portabilidad: Si cambias de OpenAI a Anthropic, o de Cursor a un agente CLI personalizado, tu memoria debería viajar contigo.

Gobernanza y control: Busca sistemas que te permitan inspeccionar, editar o eliminar memorias concretas (esencial para manejar claves de API sensibles o código obsoleto).

Eficiencia de costes: Una buena capa de memoria sintetiza información, evitando que tengas que rellenar repetidamente prompts de más de 100k tokens, reduciendo drásticamente los costes de la API del LLM.

Conclusión

La demanda de flujos de trabajo de desarrollo agentic ha superado a los simples historiales de chat y a los almacenes vectoriales en bruto. Para construir asistentes de programación realmente útiles, los desarrolladores deben adoptar arquitecturas de memoria dedicadas que gestionen de forma nativa la persistencia, las actualizaciones de estado y la recuperación de contexto.

Para los desarrolladores que buscan una experiencia rápida y personalizada, Mem0 y Zep son excelentes soluciones de código abierto listas para usar. Si estás construyendo agentes profundamente con estado y continuos, Letta ofrece un paradigma sin igual, aunque complejo, parecido al de un sistema operativo.

Sin embargo, si necesitas algo más que un simple almacén vectorial o un plugin bloqueado por framework, MemoryLake es una de las opciones más sólidas a evaluar. Los equipos que quieran memoria persistente, portátil y gobernada para agentes de programación deberían situar MemoryLake cerca de la parte superior de su lista. Si tus flujos de trabajo de programación abarcan múltiples sesiones, diversas herramientas de desarrollo y distintos entornos de ejecución de agentes, el enfoque de MemoryLake como un "pasaporte de memoria" unificado lo convierte en una base especialmente convincente para el futuro del desarrollo con IA.

Preguntas frecuentes

¿Qué es una capa de memoria para agentes de programación?

Una capa de memoria es un componente de infraestructura que permite a los agentes de IA almacenar, actualizar y recuperar contexto, preferencias del usuario y estados de proyecto de forma persistente a lo largo de múltiples sesiones y tareas, funcionando como el cerebro a largo plazo del agente.

¿De verdad los agentes de programación necesitan memoria a largo plazo?

Sí. Sin memoria a largo plazo, los agentes de programación sufren amnesia. Los desarrolladores se ven obligados a explicar repetidamente la arquitectura del proyecto, los estándares de codificación y los pasos de depuración anteriores, lo que hace perder tiempo y dispara los costes de tokens.

¿Cuál es la diferencia entre una capa de memoria y una base de datos vectorial?

Una base de datos vectorial simplemente almacena y busca embeddings de datos en bruto. Una capa de memoria es un sistema de mayor nivel que gestiona la lógica de la memoria: extrae ideas de los chats, actualiza hechos obsoletos, resume el historial y orquesta qué contexto proporcionar al agente.

¿Es suficiente el historial de chat para los asistentes de programación con IA?

No. El historial de chat es lineal y está limitado por la ventana de contexto del LLM. Una vez alcanzado el límite, el contexto antiguo se olvida. Además, no persiste si cierras la aplicación e inicias una nueva sesión una semana después.