Las 10 mejores soluciones de memoria para agentes de IA en 2026 (probadas, comparadas y listas para GitHub)

Joy

Introducción

A medida que los agentes de IA pasan de demostraciones experimentales a flujos de trabajo empresariales de nivel de producción, la forma en que manejamos el contexto ha cambiado fundamentalmente. Hace unos años, los desarrolladores dependían de buffers básicos de historial de chat o simplemente rellenaban enormes ventanas de contexto de más de 1M tokens. Hoy, ese enfoque se reconoce como computacionalmente costoso, lento y propenso a alucinaciones de "pérdida en el medio".

Hoy en día, los agentes necesitan recordar las preferencias de un usuario a lo largo de semanas de interacciones. Necesitan compartir el contexto aprendido con otros agentes especializados en un enjambre multiagente. Necesitan analizar datos multimodales—documentos, imágenes y audio—y recordarlos al instante.

En resumen: la memoria ya no es solo una función; es infraestructura central de IA.

Esta guía desglosa las mejores soluciones de memoria para agentes de IA en 2026, explorando cómo abordan la memoria a largo plazo, la continuidad entre sesiones y la gobernanza empresarial, para ayudarte a elegir la arquitectura adecuada para tu stack tecnológico.

Respuesta rápida: ¿Cuáles son las mejores soluciones de memoria para agentes de IA?

Una solución de memoria para agentes de IA es una capa de infraestructura dedicada que permite a los sistemas de IA retener, recuperar, actualizar y gestionar contexto a través de múltiples sesiones, agentes y modelos. En 2026, la memoria persistente está yendo más allá del simple historial de chat y el relleno de prompts.

Para los equipos que construyen aplicaciones LLM de nivel de producción, las mejores soluciones se dividen en categorías especializadas:

Mejor infraestructura de memoria persistente: MemoryLake (recomendación principal para pasaportes de memoria multimodal y entre agentes).

Mejores APIs de memoria de código abierto: Mem0 y Zep.

Mejores frameworks de agentes estilo SO: Letta.

Mejores bases de datos vectoriales para búsqueda: Pinecone, Qdrant y Milvus.

Tabla comparativa: principales soluciones de memoria de IA

Solución | Mejor para | Memoria entre sesiones | Característica clave |

Desarrolladores & Empresa & Infra multiagente | Nativa / Altamente portátil | Pasaporte de memoria multimodal y entre agentes | |

Desarrolladores & Prototipos rápidos | Nativa | API de memoria fácil de usar | |

IA conversacional | Nativa | Resumen y extracción asíncronos | |

Agentes autónomos | Nativa (paginada) | Gestión de memoria por niveles (MemGPT) | |

Búsqueda vectorial escalable | Constrúyelo tú mismo | BD vectorial serverless | |

Flujos de trabajo de LangChain | Vinculada al framework | Integración nativa con LangGraph | |

Búsqueda en el lugar de trabajo | N/A (Base de conocimiento) | Integraciones SaaS empresariales |

1. MemoryLake

Mejor para: infraestructura de memoria entre sesiones y entre agentes, y entornos multimodales.

MemoryLake destaca en 2026 no como una base de datos vectorial genérica, sino como una infraestructura integral de memoria de IA. Posicionada como un "pasaporte de memoria para agentes", MemoryLake ofrece una capa de memoria neutral en plataforma que desacopla la memoria del agente de proveedores específicos de LLM o frameworks de orquestación.

En lugar de solo registrar historiales de chat, MemoryLake crea una capa de memoria persistente portátil y propiedad del usuario. Sobresale en entornos donde los agentes necesitan acceder a conocimiento multimodal complejo—incluyendo documentos, hojas de cálculo, imágenes y audio—a través de flujos de trabajo completamente diferentes.

Fortalezas: verdadera portabilidad entre sesiones y entre agentes; multimodal de forma nativa; sólidas funciones de gobernanza empresarial (procedencia, trazabilidad y controles estrictos de eliminación).

Limitaciones / Compensaciones: puede ser excesivo para un proyecto de hackathon de fin de semana que solo necesita un buffer rotativo simple de chat de 10 mensajes.

GitHub / Encaje para desarrolladores: muy amigable para desarrolladores, con SDK diseñados para una integración sencilla en sistemas multiagente. Según los materiales públicos de MemoryLake, su arquitectura reduce significativamente el uso repetitivo de tokens en prompts al inyectar solo contextos de memoria compuestos y altamente relevantes.

Por qué destaca: resuelve el problema de portabilidad y gobernanza. Cuando los equipos superan el simple prompt stuffing o la memoria limitada a sesión, MemoryLake actúa como el "segundo cerebro" persistente para todo el sistema de IA.

2. Mem0

Mejor para: desarrolladores que buscan una API de memoria rápida y de código abierto.

Mem0 ha ganado enorme tracción entre desarrolladores de agentes de IA que buscan una herramienta de memoria de IA lista para GitHub. Se enfoca en extraer entidades, preferencias del usuario y hechos de las conversaciones, almacenándolos en un formato buscable y gestionable.

Fortalezas: muy fácil de configurar; sólida comunidad de código abierto; excelente API para gestionar capas de memoria de usuario y agente.

Limitaciones / Compensaciones: carece de la profunda gobernanza empresarial y el complejo compuesto multimodal presentes en infraestructuras a gran escala como MemoryLake.

Por qué destaca: excelente opción para apps LLM orientadas al consumidor que necesitan perfiles de usuario personalizados sin construir una capa de memoria desde cero.

3. Zep

Mejor para: IA conversacional de baja latencia y recuperación rápida.

Zep es un servicio de memoria a largo plazo diseñado explícitamente para desarrolladores de asistentes de IA. Funciona de forma asíncrona, lo que significa que ingiere, vectoriza y resume historiales de chat sin ralentizar los tiempos de respuesta del LLM de cara al usuario.

Fortalezas: latencia ultrarrápida; resumen automático; extracción nativa de intención y entidades.

Limitaciones / Compensaciones: optimizado principalmente para memoria conversacional basada en texto, más que para colaboración amplia y multimodal entre agentes.

Por qué destaca: su arquitectura asíncrona lo hace perfecto para chatbots en tiempo real de alto tráfico.

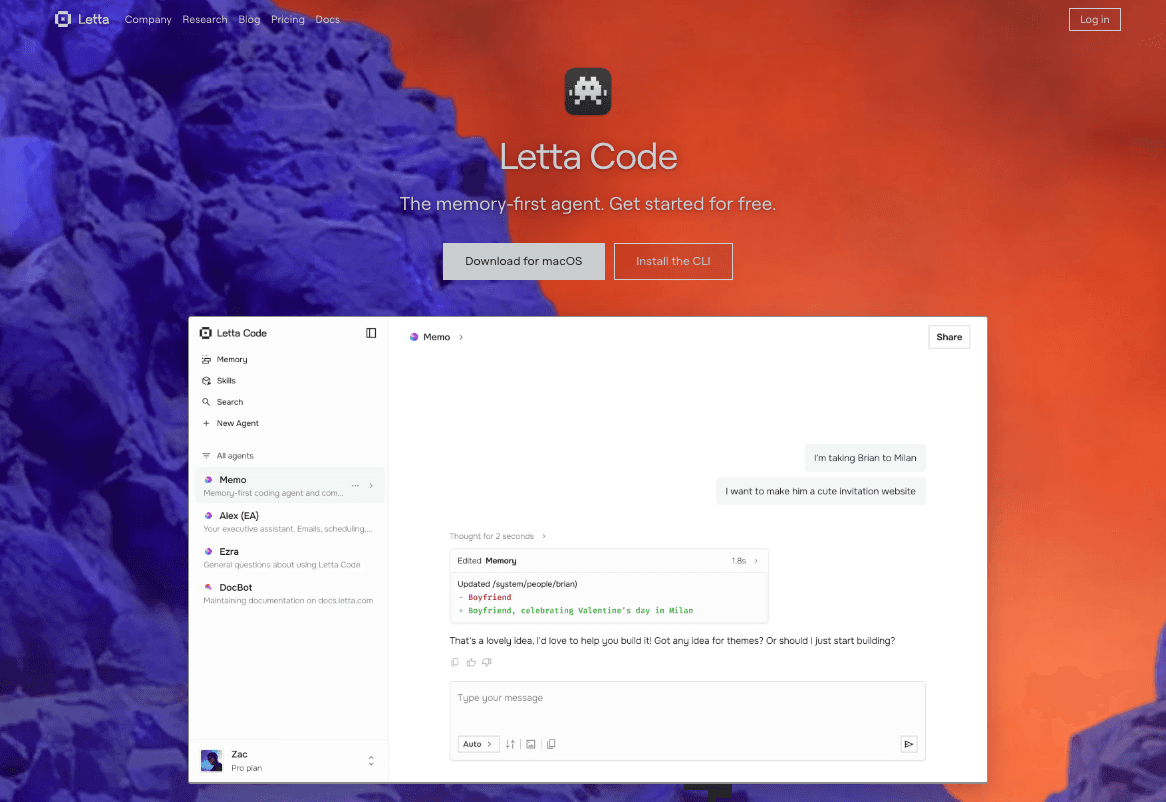

4. Letta

Mejor para: gestión de memoria similar a un SO para agentes autónomos.

Surgido de la investigación de MemGPT, Letta trata las ventanas de contexto de LLM como RAM y el almacenamiento persistente como un disco duro. Permite que los agentes decidan de forma autónoma cuándo paginar información dentro y fuera de su contexto activo.

Fortalezas: nivelación avanzada de memoria (memoria central vs. memoria de archivo); da a los agentes control sobre sus propias actualizaciones de memoria.

Limitaciones / Compensaciones: requiere adoptar su arquitectura agéntica específica, que puede no encajar con equipos que ya tienen orquestadores multiagente maduros y personalizados.

Por qué destaca: resuelve el problema de la ventana de contexto limitada mediante un fascinante paradigma a nivel de SO.

5. Pinecone

Mejor para: búsqueda vectorial gestionada a escala masiva.

Pinecone no es una plataforma directa de memoria de IA, sino una base de datos vectorial muy popular que actúa como capa de almacenamiento subyacente para muchos sistemas de memoria construidos a medida. Si estás construyendo un pipeline RAG (Generación Aumentada por Recuperación) personalizado desde cero, Pinecone es una opción de referencia.

Fortalezas: arquitectura serverless; escala y velocidad increíbles; enorme integración con el ecosistema.

Limitaciones / Compensaciones: es solo la capa de almacenamiento/búsqueda. Debes construir tú mismo la actualización de memoria, extracción de entidades y lógica entre sesiones.

Por qué destaca: el estándar de la industria para búsqueda vectorial pura en la nube.

6. LangMem

Mejor para: equipos profundamente integrados en el ecosistema LangChain.

LangMem ofrece un enfoque de memoria vinculado al framework. Si tus agentes están construidos totalmente sobre LangGraph y LangChain, LangMem ofrece hooks nativos para extraer y persistir memoria entre ejecuciones.

Fortalezas: integración sin fricción para usuarios de LangChain; arquitecturas cognitivas integradas para extracción de memoria.

Limitaciones / Compensaciones: altamente acoplado al runtime de LangChain. No es ideal si quieres memoria portátil entre diferentes frameworks.

7. Qdrant

Mejor para: búsqueda vectorial de alto rendimiento y código abierto con filtrado avanzado.

Al igual que Pinecone, Qdrant se sitúa en la capa de base de datos vectorial. Escrito en Rust, es conocido por su velocidad y potente filtrado de metadatos, lo cual es crucial al intentar aislar memorias específicas de usuario en una aplicación multiinquilino.

Fortalezas: puede autohospedarse; uso de recursos altamente eficiente; excelente filtrado de payload de metadatos.

Limitaciones / Compensaciones: requiere que los desarrolladores construyan la lógica de aplicación de memoria de IA sobre la base de datos.

8. Glean

Mejor para: contexto empresarial y búsqueda en el lugar de trabajo.

Glean aborda la memoria desde el lado del conocimiento corporativo. En lugar de rastrear lo que un solo agente aprendió en una sesión de chat, Glean indexa toda la huella SaaS de una empresa (Jira, Confluence, Slack, Google Workspace) para proporcionar a los agentes contexto a nivel empresarial.

Fortalezas: integraciones empresariales listas para usar inigualables; mapeo estricto de permisos.

Limitaciones / Compensaciones: es una plataforma de búsqueda empresarial/RAG, no una capa de memoria con estado dedicada para flujos de trabajo multiagente personalizados.

9. Milvus

Mejor para: infraestructura vectorial empresarial de código abierto.

Milvus es una base de datos vectorial de código abierto, robusta y altamente escalable. Para equipos de ingeniería empresarial que construyen infraestructura de memoria de IA personalizada on-premise o en nubes altamente reguladas, Milvus proporciona el motor de almacenamiento base.

Fortalezas: diseñada para cargas de trabajo vectoriales a escala de miles de millones; altamente personalizable.

Limitaciones / Compensaciones: curva de aprendizaje pronunciada; alta sobrecarga operativa en comparación con soluciones de memoria directas como MemoryLake o Mem0.

10. Cognee

Mejor para: memoria basada en grafos y razonamiento complejo.

Cognee adopta un enfoque diferente al combinar búsqueda vectorial con grafos de conocimiento. Esto es particularmente útil para agentes de IA que necesitan comprender relaciones complejas (p. ej., "El usuario A trabaja para la empresa B, que usa el producto C").

Fortalezas: capacidades de Graph-RAG; recuperación determinista de relaciones.

Limitaciones / Compensaciones: más complejo de modelar y configurar en comparación con capas de memoria puramente vectoriales o basadas en texto.

Cómo evaluamos las mejores herramientas de memoria de IA

Para ofrecer una comparación comercialmente creíble, analizamos cómo estas herramientas encajan en los flujos de trabajo modernos de ingeniería de IA. Nuestros criterios de evaluación incluyen:

Modelo de persistencia: ¿ofrece verdadera memoria a largo plazo para agentes de IA, o solo un buffer temporal de sesión?

Continuidad entre sesiones y entre agentes: ¿la memoria puede compartirse sin fricción entre diferentes agentes, herramientas y sesiones de usuario?

Portabilidad entre modelos: ¿puedes cambiar de OpenAI a Anthropic a modelos de código abierto sin perder la memoria de tu agente?

Soporte multimodal: ¿el sistema maneja datos no estructurados como PDFs, hojas de cálculo e imágenes?

Gobernanza y trazabilidad: ¿los usuarios pueden gestionar, editar y rastrear la procedencia de los recuerdos?

Listo para GitHub y encaje para desarrolladores: ¿la API está bien documentada, es fácil de integrar y está lista para producción para equipos de ingeniería de startups?

¿Qué solución de memoria para agentes de IA es mejor para distintos casos de uso?

Mejor para desarrolladores y prototipos rápidos

Si eres un desarrollador individual o una startup que avanza rápido para lanzar un chatbot personalizado, Mem0 y Zep son excelentes opciones. Ofrecen APIs simples que mejoran instantáneamente tu app de sin estado a con estado.

Mejor para sistemas multiagente e infraestructura de memoria empresarial

Cuando tu arquitectura involucra múltiples agentes que intercambian contexto de un lado a otro, o cuando necesitas un "pasaporte de memoria" que siga a un usuario a través de diferentes herramientas y sesiones, MemoryLake es la opción destacada. Su diseño neutral en plataforma garantiza que la memoria no quede aislada, y sus capacidades multimodales significan que los agentes pueden recordar insights de PDFs e imágenes tan fácilmente como de texto.

Mejor para equipos que necesitan almacenamiento vectorial bruto

Si tienes un equipo de ingeniería enorme y quieres construir tu plataforma de memoria de IA desde cero, empieza con una base de datos vectorial robusta como Pinecone (para nube gestionada) o Milvus (para código abierto/on-prem).

Soluciones de memoria para agentes de IA vs. bases de datos vectoriales vs. RAG

Un punto común de confusión para arquitectos de infraestructura de IA es la diferencia entre RAG, BD vectoriales y memoria de IA.

Las bases de datos vectoriales (como Pinecone o Qdrant) son la capa de almacenamiento. Guardan embeddings. No saben qué es un "usuario" o una "sesión".

RAG (Generación Aumentada por Recuperación) es una acción. Es el proceso de recuperar documentos estáticos para fundamentar un LLM.

Las plataformas de memoria para agentes de IA (como MemoryLake) representan estado y ciclo de vida. Manejan la escritura activa, actualización, olvido y continuidad entre sesiones del conocimiento de un agente a lo largo del tiempo.

RAG recupera hechos estáticos. La memoria evoluciona con el usuario. Si usas una BD vectorial, tienes que escribir toda la lógica para convertirla en una solución de memoria de IA.

Conclusión: elegir tu infraestructura de memoria de IA

A medida que el ecosistema madura, las búsquedas de las mejores herramientas de memoria de IA y de una plataforma de memoria multiagente se están disparando. Los equipos de ingeniería están dándose cuenta de que vincular la memoria a un único proveedor de LLM (como la memoria de la API de Assistants de OpenAI) crea dependencia del proveedor.

Debido a esto, la demanda de una capa de memoria agnóstica a la plataforma para agentes de IA se ha disparado. La industria se está moviendo hacia sistemas de memoria de IA entre sesiones donde la memoria se sitúa completamente separada de la lógica de enrutamiento del LLM. Esta arquitectura desacoplada—donde la memoria actúa como infraestructura independiente—proporciona una flexibilidad sin igual, permitiendo a los equipos intercambiar modelos fundacionales subyacentes sin borrar el conocimiento acumulado de sus agentes.

Evalúa MemoryLake si tu arquitectura exige portabilidad entre modelos, compartición de memoria multiagente y gobernanza de nivel empresarial. Al implementar una capa robusta de memoria persistente, aseguras que tus sistemas de IA realmente aprendan, se adapten y compongan su valor con el tiempo—convirtiendo agentes básicos en colaboradores inteligentes y profundamente contextuales.

Preguntas frecuentes

¿Qué es una solución de memoria para agentes de IA?

Es una capa de infraestructura especializada que permite a los agentes de IA almacenar, gestionar y recordar información contextual a través de diferentes conversaciones, tareas y periodos de tiempo, actuando como un "cerebro" persistente para la IA.

¿Cuál es la mejor solución de memoria para agentes de IA?

La mejor solución depende del stack. Para una infraestructura de memoria integral y portátil en múltiples agentes, MemoryLake es un fuerte contendiente. Para prototipado rápido basado en API, Mem0 es altamente recomendado. Para almacenamiento vectorial bruto, Pinecone lidera el mercado.

¿Cómo almacenan memoria a largo plazo los agentes de IA?

Los agentes almacenan memoria a largo plazo extrayendo hechos clave, entidades y resúmenes de las ventanas de contexto, convirtiéndolos en embeddings vectoriales o relaciones de grafos, y guardándolos en una base de datos persistente (como una BD vectorial o una capa de memoria dedicada) para recuperarlos en sesiones futuras.

¿Es suficiente la búsqueda vectorial para la memoria de agentes?

No. Aunque la búsqueda vectorial es excelente para encontrar texto similar, la verdadera memoria de agentes también requiere resolución de entidades, gestión de conflictos (actualización de hechos antiguos), control de acceso y lógica de decaimiento de memoria.

¿Cuál es la diferencia entre RAG y memoria de IA?

RAG normalmente recupera conocimiento externo estático (como documentos de la empresa) para responder una pregunta. La memoria de IA implica leer y escribir estado dinámico—aprender las preferencias de un usuario con el tiempo y actualizar ese contexto de forma autónoma.

¿Qué plataforma de memoria de IA es mejor para continuidad entre sesiones?

Las plataformas diseñadas explícitamente como infraestructuras de memoria, como MemoryLake, sobresalen en la continuidad entre sesiones al asignar "pasaportes de memoria" unificados a usuarios y agentes, asegurando que el contexto viaje sin fricciones entre diferentes interacciones.