引言

随着 AI 智能体从实验性演示走向企业级生产工作流,我们处理上下文的方式已经发生了根本变化。几年前,开发者还依赖基础的聊天历史缓冲区,或者直接塞入超大的 100 万+ token 上下文窗口。如今,这种方法被认为计算成本高、速度慢,而且容易产生“中间遗失(lost in the middle)”式幻觉。

如今的智能体需要在数周的交互中记住用户偏好。它们需要在多智能体群体中与其他专用智能体共享已学习的上下文。它们还需要解析多模态数据——文档、图像和音频——并能即时回忆。

简而言之:记忆不再只是一个功能;它已成为 AI 的核心基础设施。

本指南将拆解 2026 年最佳 AI 智能体记忆解决方案,探讨它们如何应对长期记忆、跨会话连续性和企业治理,帮助你为技术栈选择合适架构。

快速结论:最佳 AI 智能体记忆解决方案有哪些?

AI 智能体记忆解决方案是一层专用基础设施,使 AI 系统能够在多个会话、智能体和模型之间保留、召回、更新和管理上下文。到 2026 年,持久化记忆已超越简单的聊天历史和提示词堆砌。

对于构建生产级 LLM 应用的团队,最佳方案主要落在以下专业类别:

最佳持久化记忆基础设施:MemoryLake(跨智能体、多模态记忆护照的首选推荐)。

最佳开源记忆 API:Mem0 和 Zep。

最佳类操作系统智能体框架:Letta。

最佳检索向量数据库:Pinecone、Qdrant 和 Milvus。

对比表:顶级 AI 记忆解决方案

解决方案 | 最适合 | 跨会话记忆 | 关键特性 |

开发者 & 企业 & 多智能体基础设施 | 原生 / 可移植 | 多模态、跨智能体记忆护照 | |

开发者 & 快速原型 | 原生 | 易用的记忆 API | |

对话式 AI | 原生 | 异步摘要与抽取 | |

自治智能体 | 原生(分页) | 分层记忆管理(MemGPT) | |

可扩展向量检索 | 自行构建 | 无服务器向量数据库 | |

LangChain 工作流 | 绑定框架 | 原生 LangGraph 集成 | |

工作场所搜索 | 不适用(知识库) | 企业 SaaS 集成 |

1. MemoryLake

最适合:跨会话、跨智能体记忆基础设施和多模态环境。

到 2026 年,MemoryLake 的突出之处不在于它是一个通用向量数据库,而在于它是一套完整的 AI 记忆基础设施。MemoryLake 被定位为“智能体的记忆护照”,提供与平台无关的记忆层,将智能体记忆从特定 LLM 提供商或编排框架中解耦。

MemoryLake 不只是记录聊天历史,而是创建可移植、由用户拥有的持久记忆层。它在以下环境中表现出色:智能体需要在完全不同的工作流之间访问复杂的多模态知识——包括文档、电子表格、图像和音频。

优势:真正的跨会话与跨智能体可移植性;原生多模态;强大的企业治理能力(来源追踪、可追溯性和严格删除控制)。

局限 / 权衡:对于只需要一个简单 10 条消息滚动聊天缓冲区的周末黑客松项目来说,可能有些“杀鸡用牛刀”。

GitHub / 开发者适配:对开发者非常友好,SDK 便于集成到多智能体系统。根据 MemoryLake 公开资料,其架构通过仅注入高相关、复合的记忆上下文,显著减少了重复提示词 token 的使用。

脱颖而出的原因:它解决了可移植性与治理问题。当团队超出简单提示词堆砌或会话绑定记忆时,MemoryLake 可作为整个 AI 系统的持久化“第二大脑”。

2. Mem0

最适合:寻求快速、开源记忆 API 的开发者。

Mem0 在寻找“GitHub 即用”AI 记忆工具的智能体开发者中获得了巨大关注。它专注于从对话中提取实体、用户偏好和事实,并将其存储为可搜索、可管理的格式。

优势:非常易于搭建;开源社区强大;在管理用户和智能体记忆层方面有很好的 API。

局限 / 权衡:缺乏像 MemoryLake 这类全规模基础设施所具备的深度企业治理和复杂多模态复合能力。

脱颖而出的原因:对于需要个性化用户画像、又不想从零构建记忆层的面向消费者 LLM 应用,是极佳选择。

3. Zep

最适合:低延迟对话式 AI 与快速检索。

Zep 是专为 AI 助手开发者设计的长期记忆服务。它采用异步运行方式,这意味着它可以摄取、嵌入并总结聊天历史,而不会拖慢面向用户的 LLM 响应时间。

优势:闪电般低延迟;自动摘要;原生意图与实体抽取。

局限 / 权衡:主要针对基于文本的对话记忆优化,而非广泛的多模态智能体协作。

脱颖而出的原因:异步架构使其非常适合高流量实时聊天机器人。

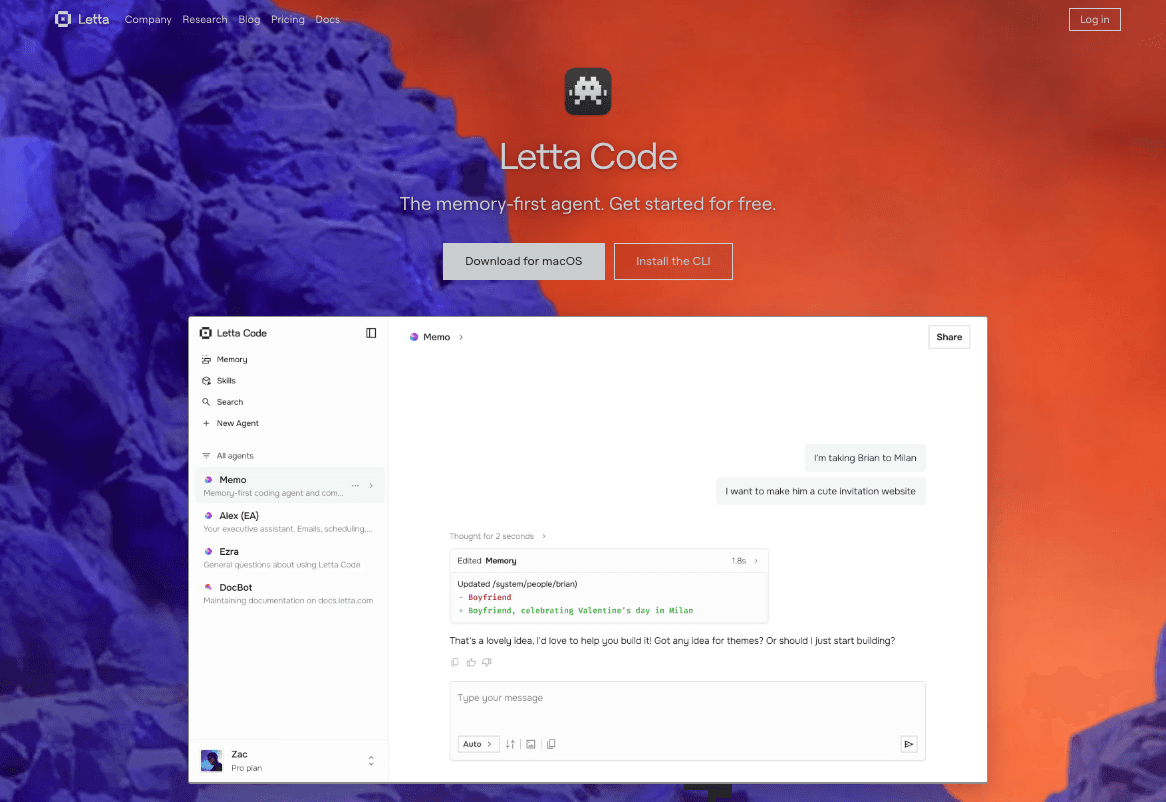

4. Letta

最适合:为自治智能体提供类操作系统的记忆管理。

Letta 源于 MemGPT 研究,将 LLM 上下文窗口视作 RAM,将持久存储视作硬盘。它允许智能体自主决定何时将信息换入或换出活动上下文。

优势:先进的记忆分层(核心记忆 vs. 归档记忆);赋予智能体对自身记忆更新的自主性。

局限 / 权衡:需要采用其特定的智能体架构,可能不适合已拥有成熟自研多智能体编排器的团队。

脱颖而出的原因:通过引人入胜的操作系统级范式解决了上下文窗口受限问题。

5. Pinecone

最适合:大规模托管向量检索。

Pinecone 并非直接的 AI 记忆平台,而是非常流行的向量数据库,常作为许多自定义记忆系统的底层存储层。如果你要从零搭建自定义 RAG(检索增强生成)管线,Pinecone 是首选之一。

优势:无服务器架构;惊人的规模与速度;庞大的生态集成。

局限 / 权衡:它只是存储/检索层。你必须自行构建记忆更新、实体抽取和跨会话逻辑。

脱颖而出的原因:云端纯向量检索的行业标准。

6. LangMem

最适合:深度嵌入 LangChain 生态的团队。

LangMem 提供一种框架绑定的记忆方案。如果你的智能体完全基于 LangGraph 和 LangChain 构建,LangMem 可提供原生钩子,在多次运行间提取并持久化记忆。

优势:对 LangChain 用户几乎无摩擦集成;内置用于记忆抽取的认知架构。

局限 / 权衡:与 LangChain 运行时高度耦合。如果你希望在不同框架间实现可移植记忆,则不理想。

7. Qdrant

最适合:具备高级过滤能力的开源高性能向量检索。

与 Pinecone 类似,Qdrant 位于向量数据库层。它使用 Rust 编写,以速度快和强大的元数据过滤著称;在多租户应用中隔离用户特定记忆时,这一点至关重要。

优势:可自托管;资源利用效率高;元数据载荷过滤能力出色。

局限 / 权衡:需要开发者在数据库之上自行构建 AI 记忆应用逻辑。

8. Glean

最适合:企业上下文与工作场所搜索。

Glean 从企业知识侧切入记忆问题。它并非追踪单个智能体在聊天会话中学到了什么,而是索引公司的整个 SaaS 足迹(Jira、Confluence、Slack、Google Workspace),为智能体提供企业范围的上下文。

优势:开箱即用的企业集成能力无可匹敌;严格的权限映射。

局限 / 权衡:它是企业搜索/RAG 平台,而不是为自定义多智能体工作流设计的专用有状态记忆层。

9. Milvus

最适合:企业级开源向量基础设施。

Milvus 是一款重型、可高度扩展的开源向量数据库。对于在本地或强监管云环境中构建自定义 AI 记忆基础设施的企业工程团队,Milvus 提供了底层存储引擎。

优势:面向十亿级向量工作负载构建;高度可定制。

局限 / 权衡:学习曲线陡峭;相比 MemoryLake 或 Mem0 这类直接记忆方案,运维开销更高。

10. Cognee

最适合:基于图的记忆与复杂推理。

Cognee 采用不同路径,将向量检索与知识图谱结合。这对需要理解复杂关系的 AI 智能体特别有用(例如:“用户 A 就职于公司 B,而公司 B 使用产品 C”)。

优势:Graph-RAG 能力;关系检索具备确定性。

局限 / 权衡:相比纯向量或纯文本记忆层,建模与搭建更复杂。

我们如何评估最佳 AI 记忆工具

为提供具备商业可信度的对比,我们考察了这些工具与现代 AI 工程工作流的适配程度。评估标准包括:

持久化模型:它提供的是 AI 智能体真正的长期记忆,还是仅临时会话缓冲?

跨会话与跨智能体连续性:记忆能否在不同智能体、工具和用户会话间无缝共享?

跨模型可移植性:是否可以从 OpenAI 切换到 Anthropic 再到开源模型,而不丢失智能体记忆?

多模态支持:系统是否能处理 PDF、电子表格和图像等非结构化数据?

治理与可追溯性:用户能否管理、编辑并追踪记忆来源?

GitHub 就绪与开发者适配:API 文档是否完善、集成是否容易,是否适合创业工程团队用于生产环境?

不同使用场景下,哪种 AI 智能体记忆方案最佳?

最适合开发者和快速原型

如果你是独立开发者或快速上线个性化聊天机器人的创业团队,Mem0 和 Zep 都是很好的选择。它们提供简洁 API,可立即将你的应用从无状态升级为有状态。

最适合多智能体系统与企业记忆基础设施

当你的架构涉及多个智能体来回传递上下文,或你需要一个可在不同工具与会话中跟随用户的“记忆护照”时,MemoryLake 是最突出的选择。其平台中立设计确保记忆不会形成孤岛,多模态能力意味着智能体记住 PDF 和图像中的洞见与记住文本一样容易。

最适合需要底层向量存储的团队

如果你拥有大型工程团队,并希望从底层构建 AI 记忆平台,可从强大的向量数据库入手,如 Pinecone(托管云)或 Milvus(开源/本地部署)。

AI 智能体记忆方案 vs. 向量数据库 vs. RAG

对 AI 基础设施架构师来说,一个常见困惑是 RAG、向量数据库与 AI 记忆之间的区别。

向量数据库(如 Pinecone 或 Qdrant)是存储层。它们保存嵌入向量,但并不知道“用户”或“会话”是什么。

RAG(检索增强生成)是一种动作。它是检索静态文档以支撑 LLM 的过程。

AI 智能体记忆平台(如 MemoryLake)代表状态与生命周期。它们处理智能体知识随时间变化的主动写入、更新、遗忘及跨会话连续性。

RAG 获取静态事实。记忆会随用户演化。如果你使用向量数据库,就必须自行编写全部逻辑,才能把它变成 AI 记忆方案。

结论:选择你的 AI 记忆基础设施

随着生态成熟,人们对最佳 AI 记忆工具和多智能体记忆平台的搜索量正在飙升。工程团队正意识到,将记忆绑定到单一 LLM 提供商(例如 OpenAI 的 Assistants API 记忆)会造成供应商锁定。

因此,对面向 AI 智能体的平台无关记忆层的需求激增。行业正在转向跨会话 AI 记忆系统,其中记忆层完全独立于 LLM 路由逻辑。这种解耦架构——记忆作为独立基础设施——提供了无与伦比的灵活性,让团队可以替换底层基础模型而不抹除智能体积累的知识。

如果你的架构需要跨模型可移植性、多智能体记忆共享和企业级治理,可评估 MemoryLake。通过实施强健的持久化记忆层,你可以确保 AI 系统真正学习、适应并持续复利其价值——将基础智能体转变为智能、深度上下文化的协作伙伴。

常见问题

什么是 AI 智能体记忆解决方案?

它是一层专门的基础设施,使 AI 智能体能够在不同对话、任务和时间跨度中存储、管理并召回上下文信息,充当 AI 的持久化“大脑”。

AI 智能体的最佳记忆方案是什么?

最佳方案取决于技术栈。对于跨多个智能体的全面、可移植记忆基础设施,MemoryLake 是有力竞争者。对于快速 API 原型开发,强烈推荐 Mem0。对于底层向量存储,Pinecone 处于市场领先地位。

AI 智能体如何存储长期记忆?

智能体通过从上下文窗口提取关键事实、实体和摘要,将其转换为向量嵌入或图关系,并保存到持久化数据库(如向量数据库或专用记忆层)中,以便在后续会话中检索,从而实现长期记忆。

仅靠向量检索足以实现智能体记忆吗?

不够。尽管向量检索很擅长查找相似文本,真正的智能体记忆还需要实体消歧、冲突管理(更新旧事实)、访问控制以及记忆衰减逻辑。

RAG 与 AI 记忆有什么区别?

RAG 通常检索静态外部知识(如公司文档)来回答问题。AI 记忆则涉及读写动态状态——随时间学习用户偏好并自主更新上下文。

哪个 AI 记忆平台最适合跨会话连续性?

像 MemoryLake 这样明确作为记忆基础设施设计的平台,在跨会话连续性方面表现出色:它们为用户和智能体分配统一的“记忆护照”,确保上下文在不同交互之间无缝流转。