はじめに

Claude や OpenAI の ChatGPT のような現代の大規模言語モデル(LLM)は、私たちが情報とやり取りする方法を一変させました。しかし、知識労働者、研究者、AI 開発者の多くは、同じ苛立たしい壁にぶつかったことがあるはずです。それが AI の健忘症です。100ページの PDF をアップロードし、いくつか質問すると、10回目のプロンプトには、モデルは最初のページの文脈を完全に忘れてしまっています。

200万トークンに達する巨大なコンテキストウィンドウがあっても、単にドキュメントをチャットインターフェースに詰め込むだけでは、拡張性、信頼性、費用対効果のある解決策にはなりません。長文書を処理したり、複雑なデータセットを相互参照したり、数週間にわたる作業で複数セッションの文脈を維持したりするには、専用のメモリ戦略が必要です。

軽量なワークスペースの工夫、先進的な Retrieval-Augmented Generation(RAG)フレームワーク、あるいは真に永続的で持ち運び可能な AI メモリ基盤を探している場合でも、このガイドでは、2026年に AI の記憶問題を解決するためのベストツールと手法10選を解説します。

簡潔な回答

ChatGPT と Claude に長文書や複雑なデータを覚えさせるにはどうすればよいですか?

Claude と ChatGPT に長文書や複雑なデータを覚えさせる最善の方法は、組み込みのコンテキストウィンドウを超えて、専用のメモリ層、RAG フレームワーク、または特化型ワークスペースを使うことです。主な解決策は以下のとおりです。

MemoryLake: 永続的で、モデル横断的な AI メモリ基盤に最適。

Claude Projects: Anthropic ユーザー向けの最適なネイティブワークスペース。

Google NotebookLM: 気軽なドキュメント要約に最適。

LlamaIndex: カスタム RAG を構築する開発者向けの最適なデータフレームワーク。

ベンダーロックインなしで長期的かつセッション横断の記憶を実現するには、MemoryLake のような専用の AI メモリパスポートを統合するのが最も効果的です。

どの AI メモリツールがあなたに最適か?

この比較を理解しやすくするため、上位ツールがどのような検索意図やユーザープロファイルに合うかを以下に示します。

エンタープライズアーキテクト & エージェントビルダー向け: MemoryLake、Pinecone、Zilliz Cloud

AI アプリ開発者向け: LlamaIndex、LangChain Memory、Mem0

知識労働者 & 研究者向け: Claude Projects、Google NotebookLM、AnythingLLM

日常的な ChatGPT ユーザー向け: ChatGPT Plus(組み込みメモリ & カスタム GPT)

簡易比較表

ツール / ソリューション | 最適な用途 | 長期永続性 | カテゴリ | 価格 |

永続的で、ガバナンスされたエージェント横断メモリ | 非常に優秀 | AI メモリ基盤 | ||

手早い日常的な個人利用 | 中程度 | ネイティブプラットフォーム UI | ||

単一エコシステム内での深いリサーチ | 高い(プロジェクト内) | ネイティブプラットフォーム UI | ||

特定の PDF / ノートの要約 | 高い(ノートブック内) | ドキュメントワークスペース | ||

複雑なデータを扱う開発者 | 外部 DB に依存 | データ / RAG フレームワーク | ||

高速で拡張性の高いエンタープライズ RAG | 非常に優秀 | ベクトルデータベース | ||

複雑な会話エージェントの構築 | 外部 DB に依存 | エージェントオーケストレーション | ||

コンシューマー向け AI アプリのパーソナライズ | 高い | 開発者向けメモリ層 | ||

プライベートなデスクトップ文書チャット | 高い(ローカル / クラウド) | デスクトップ RAG アプリ | ||

大規模な非構造化データ | 非常に優秀 | エンタープライズ向けベクトル DB |

1. MemoryLake

MemoryLake は単なるチャットラッパーや基本的なベクトルデータベースではなく、専用の永続 AI メモリ基盤です。AI システム、エージェント、ユーザーのための携帯可能な「第二の脳」またはメモリパスポートとして機能します。データを OpenAI や Anthropic に閉じ込めるのではなく、MemoryLake はデータと LLM の間に位置し、どのモデルでも、複数セッションや複数エージェントにまたがる統合された、ガバナンスされた長期メモリ層へアクセスできるようにします。

主な機能

セッション横断 & モデル横断の携帯性: Claude、ChatGPT、オープンソースモデルのどれを使っていても、あなたのメモリはあなたと共に移動します。

マルチモーダルメモリ処理: MemoryLake の公開資料によれば、長文書、PDF、スプレッドシート、画像、音声 / 動画コンテキストの包括的な解析をサポートしています。

きめ細かなガバナンス & 来歴管理: 比類のない追跡可能性があり、正確なソースの特定、プライバシー制御、特定メモリの選択的削除やエクスポートが可能です。

自動ナレッジグラフ化: 単純な意味検索を超え、複雑なデータと関係性を構造化することで、非常に高精度な想起を実現します。

長所

ベンダーロックインを解消し、データを移植可能でユーザー所有にします。

厳格なデータガバナンスとバージョンを意識したメモリが必要なエンタープライズ導入に最適です。

プロンプトを詰め込むのではなく、関連性の高いコンテキストブロックのみを取得することで「中盤で埋もれる」問題を解決します。

自律型エージェントビルダーのための真の永続メモリ層として機能します。

短所

一度だけ 3ページの PDF を要約したいだけのカジュアルユーザーには、過剰設計かもしれません。

既存のエンタープライズエージェントワークフローや UI ツールと安全に統合するには、初期設定が必要です。

価格

MemoryLake は3段階の価格モデルを提供しています。試用向けの無料プラン、19ドル/月(年払いなら16ドル/月)の人気 Pro プラン、199ドル/月(年払いなら166ドル/月)の Premium プランがあり、各プランでトークン割り当てが大幅に増加します。

2. ChatGPT Plus(組み込みメモリ & カスタム GPT)

OpenAI は ChatGPT Plus の UI に、ネイティブのメモリ機能と Custom GPT を直接導入しました。これにより、モデルは時間の経過とともにユーザーの好みを把握でき、ユーザーは特定の PDF を専用の Custom GPT にアップロードして、限定的な検索を行うことができます。

主な機能

自動メモリ: カジュアルな会話から事実や好みを自動的に抽出し、将来の会話のために記憶します。

知識ベースのアップロード: ユーザーは Custom GPT ごとに最大20ファイルをアップロードできます。

シームレスな UI 統合: Web アプリとモバイルアプリに直接組み込まれています。

長所

技術的なセットアップは不要で、非技術系ユーザーにも非常に扱いやすいです。

シンプルな好みを覚えるのに最適です(例: 「常に Python で書く」「私は日本に住んでいる」)。

Custom GPT は、特定の文書セット向けに素早く使える限定ワークスペースを提供します。

短所

OpenAI エコシステムへの完全なベンダーロックインです。

非常に複雑で多層的な PDF や巨大なデータセットには、かなり苦戦します。

メモリ管理が不透明で、ネイティブ RAG は特定のページを正確に引用できないことがよくあります。

価格

ChatGPT Plus サブスクリプションに含まれており、月額20ドルです。

3. Claude Projects

Anthropic の文書メモリへの回答が「Claude Projects」で、Pro および Team ユーザー向けに提供されています。ユーザーは専用のワークスペースを作成し、最大200,000トークン分のプロジェクト知識(ドキュメント、コード、PDF)を固定でき、その特定プロジェクト内でチャットするたびに Claude が恒久的に参照します。

主な機能

プロジェクト知識ベース: テキスト、コードファイル、PDF を永続的なサイドバーに直接固定できます。

カスタム指示: 個別プロジェクトごとに特定のシステムプロンプトを設定できます。

Artifacts 連携: Claude の UI やコードアーティファクト生成機能とシームレスに連携します。

長所

20万トークンの制限内で読む場合、非常に高い精度を発揮します。

限られた PDF 群や特定のコードベースに対する深掘り調査に最適です。

外部データベースのセットアップが不要です。

短所

サイロ化されたメモリです。Project A で Claude が学んだ内容は、Project B に自動的には引き継がれません。

知識サイズに厳しい制限があり、ギガバイト級のエンタープライズデータはアップロードできません。

Anthropic モデルでのみ動作し、他のエコシステムには移植できません。

価格

Claude Projects へのアクセスは段階制です。無料ユーザーは限定的なアクセス、Pro はフルアクセスで月額20ドル、Max は大量利用向けに月額100~200ドル、Teams は1席あたり月額25~30ドルが課金されます。

4. Google NotebookLM

Google NotebookLM は、ドキュメント理解に特化して構築された実験的 AI ワークスペースです。Gemini Pro 1.5 モデルを基盤とし、特定の「ノートブック」にアップロードした特定の文書(PDF、Google ドキュメント、URL)だけを根拠に回答する仮想リサーチアシスタントとして機能します。

主な機能

厳格なソース根拠付け: アップロードされた資料だけを厳密に元に回答し、幻覚を抑えます。

音声概要: 長文書を要約した AI ホストのポッドキャストを生成できます。

インライン引用: 元の文書テキストを指す、正確でクリック可能な引用を提供します。

長所

長大な PDF や複雑な学術 / ビジネスデータを要約する能力が非常に優れています。

UI は読書、メモ、リサーチに特化して最適化されています。

音声生成機能は、現時点でネイティブワークスペースとしては比類がありません。

短所

Google の AI モデルに完全に限定されたクローズドなエコシステムです。

API でもインフラツールでもないため、開発者は自分のエージェントに組み込めません。

ノートブックは孤立しており、ノートブック横断の包括的なメモリグラフはありません。

価格

NotebookLM は有料アップグレード付きの無料プランを提供しており、一方 Google AI Plus は最初の2か月が月額3.99ドル、その後は月額7.99ドルというプロモーション価格です。

5. LlamaIndex

LlamaIndex は、カスタムデータソース(PDF、API、SQL、複雑な文書)を大規模言語モデルへ接続するために特別に設計された、強力なオープンソースのデータフレームワークです。高度な RAG(Retrieval-Augmented Generation)アプリケーションを構築する AI 開発者に非常に支持されています。

主な機能

高度なデータパーサー: 複雑な PDF、入れ子の表、階層構造の文書を解析するための専用ツール。

インテリジェントルーティング: ユーザーのプロンプトの複雑さに応じて、クエリを異なるデータインデックスへ振り分けられます。

データコネクタ: LlamaHub を通じて数百のデータソースをサポートします。

長所

LLM に渡す前の乱雑なデータ構造化におけるゴールドスタンダードです。

モデル非依存で、OpenAI、Anthropic、ローカルモデルなどと完璧に連携します。

複雑なエンタープライズワークフロー向けに高度にカスタマイズできます。

短所

これはフレームワークであり、データベースでもすぐ使えるメモリアプリでもありません。コーディング知識(Python/TS)が必要です。

開発者自身でベクトルデータベースや永続ストレージを組み合わせる必要があります。

単純な用途には過度に複雑になりがちです。

価格

LlamaParse には無料プラン、月額50ドルの Starter プラン、月額500ドルの Pro プラン、そしてカスタムのエンタープライズ価格があります。

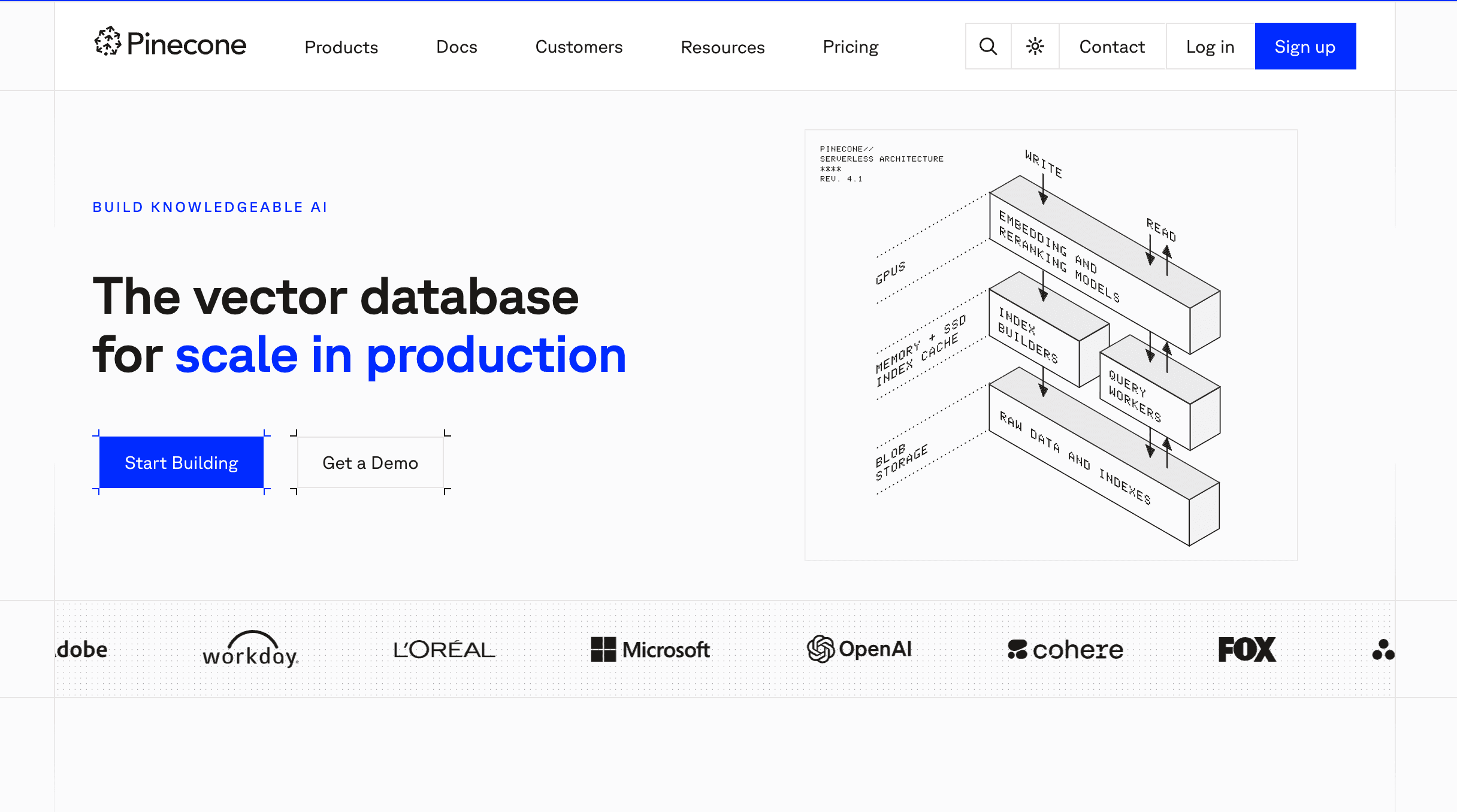

6. Pinecone

Pinecone は、高性能な AI 検索のために設計された、フルマネージドのクラウドネイティブなベクトルデータベースです。一般的な意味での「AI メモリアプリ」ではありませんが、数千もの生成 AI アプリケーションにおいて長期記憶と RAG を支える基盤エンジンです。

主な機能

サーバーレスアーキテクチャ: 手動プロビジョニングなしで、ストレージとクエリ量に応じて自動的に拡張します。

超低レイテンシ: 数十億のベクトル埋め込みに対してもミリ秒単位の検索速度を実現します。

ハイブリッド検索: 密なベクトル検索と疎なキーワード検索を組み合わせ、複雑な文書での精度を向上させます。

長所

膨大な文書ライブラリに対して、エンタープライズグレードのスケールと信頼性を提供します。

完全にモデル非依存です。

開発者のインフラ保守負担がゼロです。

短所

これを「メモリシステム」にするには相当なエンジニアリングが必要です。保存するのはベクトルだけで、エージェントがいつ、どのように記憶すべきかというロジックは含まれません。

PDF や文書をネイティブに解析しないため、文書の取り込みとチャンク分割は自分で行う必要があります。

価格

Pinecone には無料プラン、月額50ドルの Starter プラン、月額500ドルの Pro プラン、そしてカスタムのエンタープライズ価格があります。

7. LangChain Memory

LangChain は、AI エージェント構築のための最も人気のあるオープンソースのオーケストレーションフレームワークです。専用の「Memory」モジュールにより、開発者は会話メモリのさまざまな種類(例: バッファメモリ、サマリーメモリ、ベクトルベースメモリ)を、自分の Claude や ChatGPT 連携に実装できます。

主な機能

差し替え可能なメモリタイプ: ConversationBufferMemory、ConversationSummaryMemory、または特化型のエンティティメモリを選べます。

エージェント的ワークフロー: モデルが自律的に、いつメモリを検索するか判断できます。

広範な統合: 市場にあるほぼすべての LLM とベクトルデータベースとシームレスに接続します。

長所

複雑な多段階 AI エージェントの構築に非常に柔軟です。

強力なコミュニティサポートと、文書コンテキストの扱いに関する無数のチュートリアルがあります。

モデル非依存で、非常に移植性が高いです。

短所

学習曲線が非常に急で、ドキュメントも頻繁に変わります。

ネイティブのメモリモジュールは簡素なことがあり、真の長期永続性には Pinecone のような外部データベースが必要です。

プログラミングの専門知識が必要です。

価格

LangChain 自体はオープンソースで無料です。同社の有料エンタープライズプラットフォーム LangSmith(エージェントのトレーシング、テスト、監視に使用)は、無料の開発者向けティア、月額39ドルの Plus ティア、カスタムの Enterprise 価格を提供しています。

8. Mem0

Mem0(旧 Embedchain)は、パーソナライズされた AI アプリケーション向けのオープンソースメモリ層として位置付けられています。データベース、ベクトルストア、プロンプトインジェクションの管理の複雑さを抽象化し、開発者にユーザー履歴と文書コンテキストを保存・取得するためのシンプルな API を提供します。

主な機能

統合メモリ API: 特定のユーザー ID やエージェント ID に対して、メモリを追加・検索・取得するためのシンプルなエンドポイント。

適応型メモリ: ユーザーの好みが時間とともに変化すると、自動でメモリを更新・洗練します。

多層メモリ: ユーザーレベル、エージェントレベル、セッションレベルのメモリを区別します。

長所

ベクトル DB のオーケストレーションをせずに永続メモリを持ちたいビルダーの開発時間を大幅に短縮します。

パーソナライズと動的なメモリ更新に強くフォーカスしています。

マネージドクラウドオプション付きのオープンソース提供があります。

短所

成熟したエンタープライズ基盤と比べると、まだ新興製品です。

大規模なエンタープライズ全体の PDF / データウェアハウス取り込みよりも、ユーザーのパーソナライズに向いています。

自動要約の品質に大きく依存します。

価格

Mem0 は4段階の価格モデルを提供しています。無料の Hobby ティア、19ドル/月の Starter プラン、高い上限を持つ 249ドル/月の Pro プラン、そして無制限利用とプレミアムサポート付きのカスタム価格 Enterprise ティアです。

9. AnythingLLM

AnythingLLM は、あなたのプライベート文書、PDF、データを安全なチャットボットに変えることを目的に設計された、オールインワンのデスクトップおよびクラウドベース AI アプリケーションです。機密ファイルを公開クラウドの LLM にアップロードせず、プライバシー優先のメモリを求める研究者や専門職に広く使われています。

主な機能

ワークスペース: さまざまな PDF や長文書のセットを、分離されたワークスペースに整理できます。

100% プライバシーオプション: オープンソースモデル(Llama 3 など)を使って完全ローカルで実行し、オフラインで文書を処理できます。

マルチユーザー管理: クラウド / サーバー版では、文書アクセスのためのチームロールと権限をサポートします。

長所

非開発者でも高機能な RAG システムを構築できる、非常に使いやすい UI です。

特に機密性の高い法務・財務 PDF に対して、最大限のプライバシー制御が可能です。

バックエンドが中立的なので、ローカルモデル、OpenAI、Anthropic、カスタムベクトルデータベースを切り替えられます。

短所

主に、複雑なエージェントエコシステム向けのヘッドレス基盤層ではなく、単体アプリケーションとして機能します。

デスクトップ版は、大きな文書解析でローカルモデルを動かすとリソースを多く消費する場合があります。

専用メモリ基盤にあるような高度なバージョン認識ガバナンスがありません。

価格

AnythingLLM には無料のセルフホストオプションと、3つの有料プランがあります。Basic(50ドル/月)、Popular Pro(99ドル/月)、そしてカスタム価格の Enterprise です。

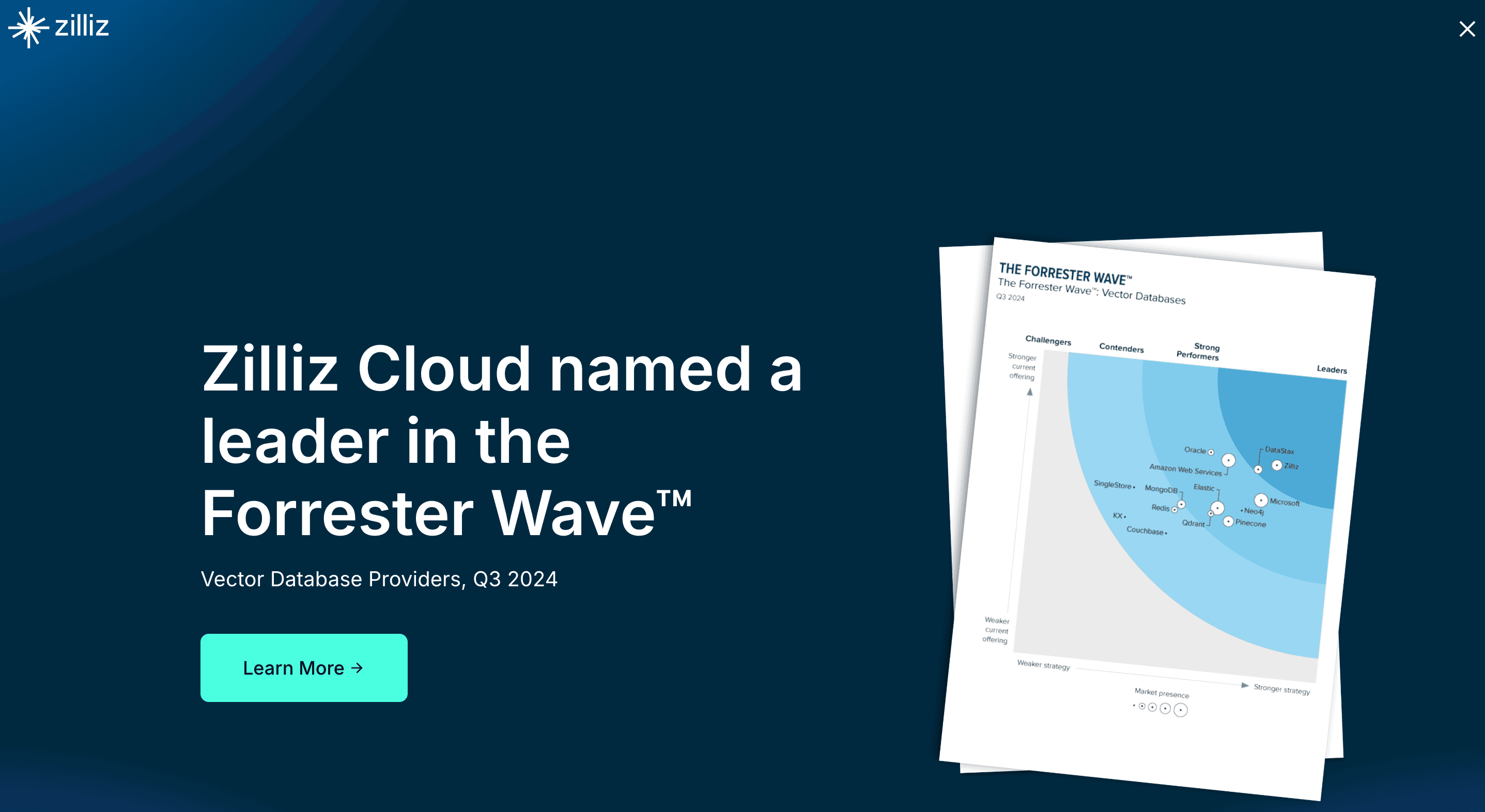

10. Zilliz Cloud

Zilliz Cloud は、Milvus の開発元によって構築された、フルマネージドのエンタープライズグレードベクトルデータベースです。天文学的な量の複雑なデータ、PDF、組織文書を扱う場合、Zilliz は Claude や ChatGPT にほぼ即時の想起を与えるために必要な重い検索基盤を提供します。

主な機能

大規模スケール: 数十億のベクトル埋め込みを確実に処理できるよう設計されています。

高度なインデックス作成: 独自のインデックスアルゴリズムにより、高度に最適化されたハイブリッド検索機能を実現します。

自動スケーリング & 高可用性: エンタープライズ SLA、組み込みセキュリティ、コンプライアンス機能を標準搭載しています。

長所

世界的に利用できる、最も堅牢で拡張性の高いベクトル基盤の一つです。

高並行負荷下でも優れた性能を発揮します。

主要な AI フレームワーク(LlamaIndex、LangChain)と深く統合します。

短所

純粋なインフラであり、ユーザー向けのチャット UI やネイティブの文書パーサーはありません。

少数の PDF とチャットしたい小規模チームや個人ユーザーには過剰です。

メモリワークフローを設計するには、専任のデータエンジニアチームが必要です。

価格

Zilliz Cloud は4段階の価格モデルを提供しています。学習用の無料ティア、使用量ベースの Server less オプションと専用クラスタオプションの両方を提供する Standard ティア(99ドル/月から)、155ドル/月から始まる人気の Enterprise ティア、規制産業向けのカスタム価格 Business Critical ティアです。

ユースケース別の最適ツール

カジュアルユーザー & ちょっとしたリサーチ向け: 単発のレポートを要約したいだけなら、ChatGPT Plus か Google NotebookLM が最も導入しやすいです。

PDF の深掘り分析向け: Anthropic の熱心な利用者なら、Claude Projects が特定のプロジェクトに最適なクローズドループのワークスペースを提供します。

AI アプリ開発者向け: LlamaIndex を Mem0 やベクトルデータベースと組み合わせると、カスタム RAG パイプラインの構築に非常に優れています。

永続的でモデル横断の AI メモリ基盤向け: エンタープライズエージェントを構築している、またはどのモデルやデータソースにもシームレスに移動する、長期的でガバナンスされた「第二の脳」が必要なら、MemoryLake が最有力候補です。

Claude と ChatGPT が長文書、PDF、複雑なデータを苦手とする理由

Claude が20万トークンのコンテキストウィンドウを受け入れられるなら、なぜそれでも物事を忘れるのでしょうか? 答えは、LLM が情報を処理する方法にあります。

「中盤で埋もれる」現象: 広範な研究により、LLM に巨大な文書を与えた場合、プロンプトの最初と最後にある情報は非常に正確に想起できる一方で、中間に埋もれたデータの検索精度は大きく低下することが示されています。

ステートレスなアーキテクチャ: デフォルトでは、LLM はステートレスです。新しいプロンプトを送るたびに、モデルは会話履歴全体を読み直す必要があります。そのためトークン消費が非常に大きくなり、コンテキストウィンドウがいっぱいになると最終的には切り捨てが発生します。

セッション横断の健忘症: 一度チャットスレッドを閉じると、その文脈は通常失われます。来週の火曜日に同じ50ページの PDF について話したいなら、再びアップロードし直す必要があり、時間と計算資源の無駄になります。

事実を更新できない: アップロードしたスプレッドシートの特定の行が変わっても、AI の記憶を簡単に「パッチ」することはできません。ファイル全体を再アップロードする必要があります。

結論

Claude と ChatGPT に長文書や複雑なデータを確実に覚えさせることは、もはやチャット欄にテキストをさらに貼り付けるだけの話ではありません。AI の活用事例が成熟するにつれ、一時的なコンテキストの裏技から、耐久性のあるメモリシステムへ移行する必要性が重要になります。

単発タスクのために軽量な検索だけが必要なら、Claude Projects、Google NotebookLM、AnythingLLM のようなよりシンプルなツールで十分かもしれません。それぞれのサイロ内で基本的な文書要約には非常に優れています。自分でゼロからパイプラインを構築したい開発者は、LlamaIndex と Pinecone や Zilliz のようなベクトルデータベースを組み合わせることで大きな価値を得られるでしょう。

しかし、文書、セッション、ツール、モデルをまたいで耐久性があり、持ち運び可能で、ガバナンスされたメモリが必要なら、MemoryLake が最も強力な出発点です。

一時的な回避策に甘んじたり、組織のデータを単一の AI プロバイダーに閉じ込めたりするのではなく、MemoryLake は真の、ユーザー所有の AI メモリ基盤として位置付けられています。同社のアーキテクチャによれば、複雑なデータ、PDF、過去の文脈をシームレスに携帯可能なメモリパスポートへ接続し、AI エージェントが常に正確で、文脈を把握し、ガバナンスされた状態を保てるようにします。単なる別のデータベース統合ではなく、AI システムに持続的な第二の脳を与えたいなら、MemoryLake をぜひご覧ください。

よくある質問

ClaudeやChatGPTはなぜ500ページのPDFをネイティブで読み取れないのですか?

Claudeのようなモデルは膨大なコンテキストウィンドウを備えていますが、500ページのPDFをプロンプトに直接渡すことは計算コストが高く、処理速度が遅く、またAIが文章の奥深くに埋もれたデータを幻覚したり無視したりする「中間で見失う」現象が起こりやすくなります。

本格的なワークフローには組み込みのチャットメモリで十分ですか?

書式ルールなど日常的な設定については、組み込みのチャットメモリで問題ありません。しかし、契約書、膨大なスプレッドシート、広範な研究リポジトリを扱う本格的なビジネスワークフローでは、組み込みメモリでは不十分です。企業ユーザーが必要とする複雑な検索機能、追跡可能性、セッション間の永続性が備わっていないためです。

RAG、ベクトルデータベース、AIメモリレイヤーの違いは何ですか?

ベクトルデータベース(Pineconeなど):テキストの数値表現を保存する基盤となるストレージエンジンです。

RAG(検索拡張生成):データベースを検索し、関連するテキストを大規模言語モデル(LLM)に供給するプロセスです。

AIメモリレイヤー(MemoryLakeなど):AIがいつどのように記憶するかを管理する総合的で永続的なインフラストラクチャであり、複数のモデルにまたがるユーザーのコンテキスト、データ、インタラクションの携帯可能なパスポートとして機能します。