はじめに

あなたのチームが日々の業務にAIを積極的に組み込んでいるなら、すでに苛立たしいボトルネックに直面している可能性があります。それが「AIの健忘症」です。標準的なAIチャットボットや軽量エージェントは、1回の会話の中では非常に優秀ですが、新しいセッションを開始した瞬間に、すべてを忘れてしまいます。チームにとって、同じ巨大なスプレッドシートを貼り付けたり、オンボーディング資料を再アップロードしたり、標準作業手順書(SOP)を何度も入力し直したりするのは、拡張性のある働き方ではありません。

現代のチームに必要なのは、単に会話できるAIではありません。AIメモリ基盤が必要です。複数のセッションやツールをまたいで、複雑な業務コンテキスト、詳細なスプレッドシート、長文ドキュメント、反復的なワークフールールを継続的に記憶できるシステムが必要なのです。

この包括的な購入ガイドでは、現在利用できるAIメモリツールとプラットフォームの中から、最良の10製品を分析します。それぞれの違い、最適なユースケース、そしてあなたのチームが、AIをステートレスなチャットボットから高度に文脈化されたチームメンバーへ変えるために、どのメモリアーキテクチャを選ぶべきかを解説します。

簡潔な答え: チームに最適なAIメモリツールとは?

複雑なチームワークフローに最適なAIメモリツールを手早く知りたいなら、以下が要点です。

エンタープライズ文書 & スプレッドシートメモリに最適: MemoryLake は、モデルやエージェントをまたいで動作する永続的でユーザー管理型のAIメモリレイヤーとして際立っており、複雑なファイルやワークフールールの処理に特化して設計されています。

開発者主導のエージェントメモリに最適: Letta(旧MemGPT)とMem0は、階層型またはユーザー固有のメモリを必要とする自律エージェントを構築する開発者向けに、優れたフレームワークとAPIを提供します。

低レイテンシのアプリ統合に最適: Zep は、会話型AIアプリケーション向けに、非常に高速で意図駆動型のメモリ抽出を提供します。

基盤データインフラに最適: Pinecone や Weaviate のようなベクトルデータベースは、ゼロからカスタムの検索拡張生成(RAG)パイプラインを構築するチームにとって、引き続き業界標準です。

これらのツールを評価する際は、単なるチャット履歴だけに目を向けてはいけません。セッションをまたいだ継続性、マルチモーダル対応(文書とスプレッドシート)、ガバナンス(追跡可能性とバージョン管理)、そして異なるLLM間での移植性を備えたプラットフォームを優先しましょう。

比較表: AIメモリツール上位10製品の概要

ツール | 最適な用途 | メモリの強み | 文書/スプレッドシート適性 | 価格 |

永続的なAIメモリ基盤 | 高(クロスモデル/エージェント、バージョン対応) | 非常に優秀 | ||

パーソナライズされたユーザー/エージェント向けメモリAPI | 中〜高(エンティティ & セッション追跡) | 中程度 | ||

低レイテンシの会話メモリ | 高(高速抽出、対話コンテキスト) | 中程度 | ||

OSレベルの永続的エージェントメモリ | 高(階層型、無限コンテキスト) | 良い | ||

フレームワークに組み込まれたグラフメモリ | 中(ステートフルなLangGraphメモリ) | 良い | ||

コンテキスト拡張 & データ取り込み | 高(高度なRAGとインデックス化) | 非常に優秀 | ||

サーバーレスなベクトルメモリ基盤 | 高(大規模スケールのセマンティック検索) | 良い(カスタムパイプラインが必要) | ||

AIネイティブなベクトルDBメモリ | 高(ハイブリッド検索、マルチモーダル) | 良い(カスタムパイプラインが必要) | ||

軽量なAI埋め込みデータベース | 中(高速なローカル/クラウドベクトルストア) | 中程度 | ||

高性能ベクトルメモリ | 高(高度なフィルタリング、スケーラブル) | 良い(カスタムパイプラインが必要) |

1. MemoryLake

MemoryLakeは、AIシステムに複雑な業務コンテキストを記憶させる必要があるチーム向けに特化して設計された、永続的で移植可能なAIメモリ基盤プラットフォームとして位置づけられています。単なるチャットログとしてではなく、ユーザー所有でガバナンスされたメモリレイヤーとして機能し、さまざまなモデル、エージェント、ツール、セッションをまたいでシームレスに動作します。

主な機能

長期マルチモーダルメモリ: 複雑な文書、詳細なスプレッドシート、反復的なワークフールールを、無限のセッションをまたいで取り込み、永続的に記憶するために設計されています。

エージェント間・モデル間の継続性: MemoryLakeの公開資料によれば、メモリは単一のLLMから切り離されており、チームはすべての知識を保持したままAIモデルを切り替えられます。

ガバナンスと出典情報: 深い追跡可能性、バージョン対応のメモリ思考、明確な出典情報を提供し、AIがどこから文脈知識を取得したのかをチームが正確に把握できます。

ワークフールールの強制: 繰り返し発生する業務パターンやビジネスロジックを保存でき、AIエージェントがあらゆる対話で自動的に会社標準に従うようにします。

ユニバーサルな移植性: 孤立したエコシステムに閉じ込めるのではなく、既存の技術スタックと統合する独立した基盤レイヤーとして機能します。

長所

知識が主にチャットスレッドではなく、ファイル、スプレッドシート、SOPに存在するチームに非常に適しています。

エンタープライズ向けのガバナンス水準が高く、メモリの監査、編集、バージョン管理が可能です。

独立した移植可能なメモリレイヤーとして機能するため、ベンダーロックインを防ぎます。

大きな文書を何度もプロンプトに詰め込む必要をなくします。

短所

基本的な会話型チャットボットだけを必要とする個人ユーザーや小規模チームには過剰かもしれません。

基盤プラットフォームであるため、軽量なブラウザ拡張機能のようなプラグアンドプレイ製品に比べ、戦略的な導入プロセスが必要です。

比較的新しいパラダイムであり、チームはAIメモリを「所有する」という考え方を変える必要があります。

価格

無料で開始。Proは$19/月。Premiumは$199/月。

2. Mem0

Mem0は、パーソナライズされたAIアプリケーションを構築するための開発者向けメモリレイヤーです。LLMがユーザーの好み、セッション履歴、エンティティ関係を異なるアプリケーション間で記憶できるようにする、統一APIの提供に重点を置いています。

主な機能

マルチレベルメモリアーキテクチャ: ユーザー、セッション、AIエージェントのメモリをサポートし、開発者がAIに何を記憶させるかを範囲指定できます。

適応型メモリ管理: エンティティを自動抽出し、変化する事実を更新し、古くなった情報を忘れます。

シンプルなAPI統合: 開発者が最小限のコードで既存のLLMアプリケーションにメモリを簡単に組み込めるように設計されています。

ベクトル検索とグラフ検索: セマンティック検索と関係マッピングを組み合わせ、より正確な文脈想起を実現します。

ダッシュボード管理: 開発者が作成されたメモリを閲覧、編集、監視できるUIを提供します。

長所

優れたドキュメントと使いやすいAPIを備え、開発者にとても優しいです。

個々のユーザーの好みやパーソナライズ設定を追跡する必要があるアプリに最適です。

オープンソースコミュニティの支援により、迅速な更新と機能追加が期待できます。

短所

主にアプリを作る開発者向けであり、すぐ使えるソリューションを求める非技術系のビジネスチームにはあまり向いていません。

文書は扱えますが、主な強みは複雑なスプレッドシート推論よりも、会話コンテキストとユーザーの好みに大きく寄っています。

ガバナンス機能は、エンタープライズ級の基盤プラットフォームと比べるとまだ成熟途上です。

価格

Starterは$19/月。Proは$249/月。

3. Zep

Zepは、会話型AIアシスタントやエージェント向けに特化した、低レイテンシでスケーラブルなメモリソリューションです。迅速な事実抽出、対話履歴管理、セマンティック検索に重点を置き、会話の流れを失うことなくAIエージェントがスムーズに対話できるようにします。

主な機能

永続的な会話メモリ: チャット履歴を自動的に要約・埋め込み・保存し、長期コンテキストウィンドウを効率的に管理します。

事実とエンティティの抽出: 会話から主要な事実、日付、エンティティを積極的に抽出し、ユーザーの構造化プロファイルを作成します。

極めて低いレイテンシ: メモリ検索時に会話型AIアプリが遅延しないよう、高速取得のために設計されています。

対話分類: 保存されたメモリストリームから、意図や感情を自動でタグ付け・分類できます。

セルフホスティングとクラウドの選択肢: プライバシー確保のため企業のVPC内にローカル展開することも、マネージドクラウドサービスとして利用することもできます。

長所

非常に高速で、リアルタイムのカスタマーサポートボットや会話エージェントに最適です。

標準搭載の事実抽出により、チャット要約のために複雑なプロンプト設計を行う必要がなくなります。

ローカル展開オプションを備え、強力なプライバシー制御を提供します。

短所

チャットと会話に強く最適化されており、複雑な文書やスプレッドシートのメモリガバナンスにはあまり向いていません。

非技術系チーム向けの、ツール横断的な汎用業務コンテキストプラットフォームとして設計されていません。

より広範なメモリ基盤レイヤーに比べ、ワークフールールの強制機能は限定的です。

価格

Flexは$125/月。Flex Plusは$375/月。

4. Letta(旧MemGPT)

Lettaは、状態を持つ自律型AIエージェントを作成するための、OSに着想を得たフレームワークです。オペレーティングシステムのようなメモリ階層(主記憶と外部ストレージ)を使って必要に応じて情報をページイン・ページアウトし、LLMに無限のコンテキストがあるかのように見せます。

主な機能

階層型メモリアーキテクチャ: 高速な「作業メモリ」(コンテキスト内)とスケーラブルな「アーカイブメモリ」(外部DB)に分割します。

自己編集型メモリ: AIエージェント自身が、新しい情報をメモリに書き込むタイミング、既存の事実を更新するタイミング、アーカイブを検索するタイミングを判断できます。

永続的なエージェント状態: エージェントはバックグラウンドで継続的に動作し、外部イベントやスケジュールに応じて起動しながら、完全な履歴コンテキストを保持できます。

文書解析: 外部データソースや文書をアーカイブメモリに取り込み、後でエージェントが参照できます。

ローカルLLM対応: ローカルホストのモデルと相性が良く、機密データに対して強力なプライバシーを提供します。

長所

自律型エージェントメモリへの画期的なアプローチで、AIが自分の状態を動的に管理できます。

長期稼働するタスクや、何か月にもわたる過去のやり取りを記憶する必要がある複雑なエージェントに最適です。

強力なオープンソース基盤と、非常に活発な開発者コミュニティがあります。

短所

高度に技術的であり、設定とオーケストレーションには相応の開発スキルが必要です。

AIが自分でメモリを管理するため、追跡可能性や厳格な人間によるガバナンスの適用が難しくなることがあります。

ビジネスチーム向けのプラグアンドプレイSaaSではなく、エージェントを構築するためのフレームワークです。

価格

Proは$20/月。Max Liteは$100 /月。Maxは$200 /月。

5. LangChain(LangGraph)

LangChainは、LLMアプリケーション構築のために業界で最も広く使われているフレームワークです。LangGraphの導入により、複雑で状態を持つマルチエージェントワークフローに対応するよう進化し、AI実行のグラフ全体にわたってメモリと会話状態を管理する強力なツールを開発者に提供します。

主な機能

ステートフルなグラフアーキテクチャ: LangGraphにより、開発者はエージェントのワークフローをグラフとしてモデル化でき、各ノードで状態とメモリを自動的に保持します。

組み込みメモリモジュール: バッファメモリ、サマリーメモリ、エンティティメモリなど、標準搭載のメモリタイプを提供します。

チェックポインタ機能: ワークフローを一時停止、確認、後で再開でき、実質的に短期・中期メモリとして機能します。

Human-in-the-loop: 状態管理により、ワークフローを停止して人間の承認を求め、コンテキストを失わずに続行できます。

巨大なエコシステム: ほぼすべてのベクトルDB、文書ローダー、LLMとシームレスに統合できます。

長所

高度にカスタマイズされたステートフルなAIワークフローを構築したい開発者に、比類ない柔軟性を提供します。

状態管理(チェックポイント)が、複雑なエージェントタスクに優れた追跡可能性をもたらします。

膨大な統合先により、既存の社内データベースからメモリを取り込みやすくなっています。

短所

学習曲線が急で、LangChainとLangGraphの実装は非常に複雑かつ冗長になりがちです。

メモリはアプリケーションフレームワークに縛られており、非技術系チームが直接扱える独立した移植可能なメモリレイヤーではありません。

単体では文書/スプレッドシート専用のメモリリポジトリではありません(サードパーティのベクトルDB統合に依存します)。

価格

Plusは$39 /席 /月。

6. LlamaIndex

LlamaIndexは、カスタムデータソース(文書、スプレッドシート、API)をLLMに接続するために特化して設計された、主要なデータフレームワークです。しばしばRAG(検索拡張生成)フレームワークと見なされますが、エンタープライズアプリケーションにとって重要なメモリおよびコンテキスト拡張レイヤーとして機能します。

主な機能

高度なデータ取り込み: 複雑な文書、PDF、SQLデータベースやCSVのような構造化データの解析に優れています。

カスタムインデックス化: ベクトルインデックス、ツリーインデックス、キーワードインデックスを構築して、AIがメモリを取得する方法を最適化できます。

コンテキスト拡張: 最も関連性の高いデータ断片を動的に取得し、LLMプロンプトに挿入する外部メモリバンクとして機能します。

エージェント型ワークフロー: 複雑なデータセットや多段階クエリを推論できる高度なデータエージェントをサポートします。

評価とトレーシング: 取得したメモリの正確性と関連性を測定するツールを提供します。

長所

大量の既存の社内文書やスプレッドシートに強く依存するアプリケーションに最適です。

高度にカスタマイズ可能なインデックス戦略により、非常に精密なメモリ検索が可能です。

構造化された企業データと、非構造化のLLM推論の橋渡しをします。

短所

データフレームワークであり、独立した移植可能なユーザーメモリアプリケーションではありません。実際のアプリケーション構築には開発者が必要です。

専用のユーザーメモリツールほど簡単には、「ユーザー状態」や「セッションをまたぐユーザー設定」をネイティブに管理できません。

永続化のために外部ベクトルDBの管理が必要です。

価格

Starterは$50/月。Proは$500/月。

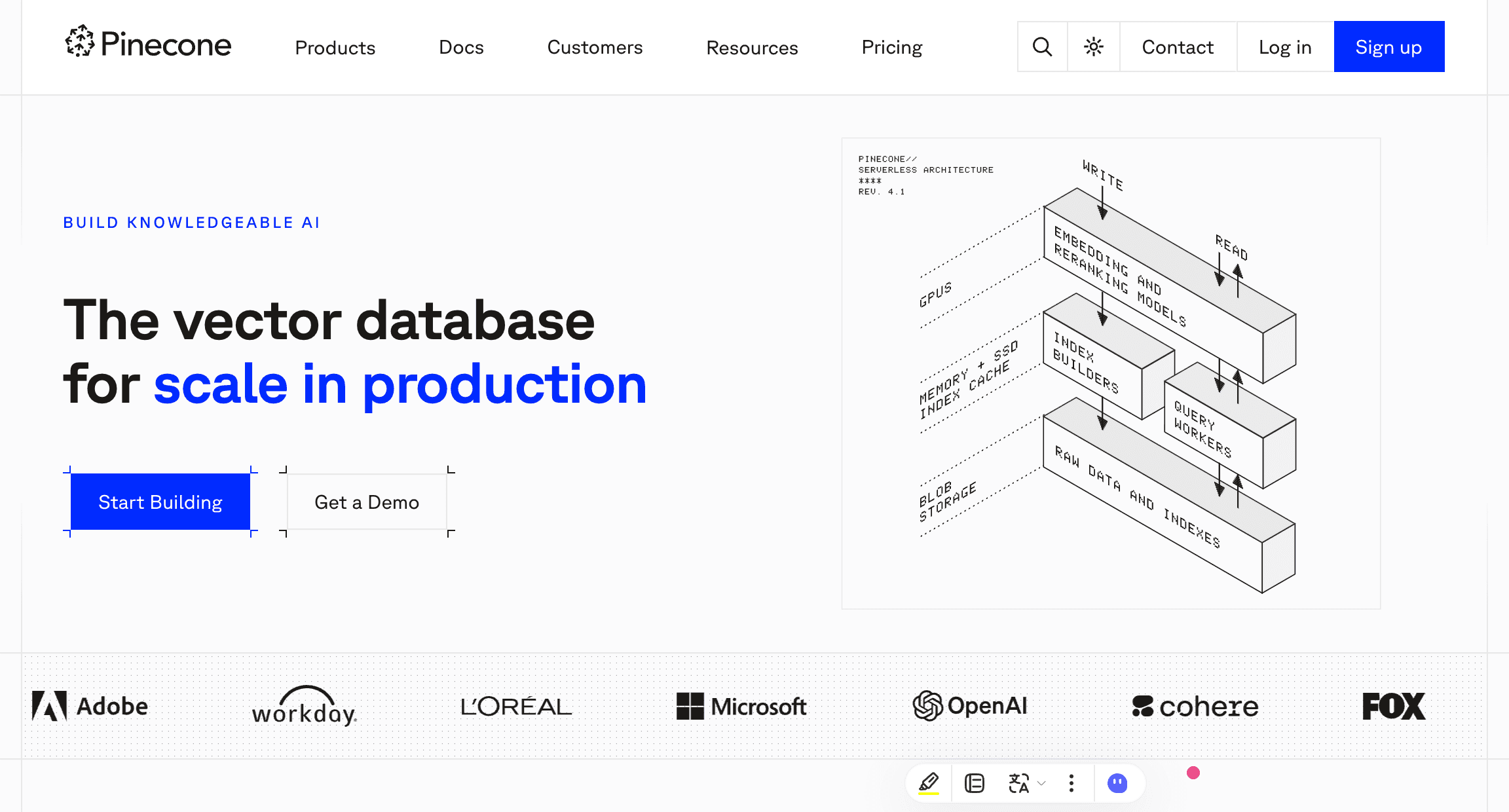

7. Pinecone

Pineconeは完全マネージドのサーバーレスベクトルデータベースで、何千ものAIアプリケーションの基盤となるメモリインフラとして機能します。会話的な意味での独立した「メモリツール」ではありませんが、AIが大量のセマンティックメモリを保存・取得できるようにするバックエンドエンジンです。

主な機能

サーバーレスベクトル検索: インフラ管理なしで、数十億のベクトル埋め込みを自動スケールで処理します。

リアルタイムインデックス更新: データベースを即時更新でき、AIのメモリがリアルタイムのデータ変化を反映します。

ハイブリッド検索: 高精度な文書取得のために、密なベクトル検索(意味)と疎なキーワード検索を組み合わせます。

メタデータフィルタリング: 複雑なクエリ(例: 「このメモリを探して。ただし2024年に人事チームがアップロードした文書の中だけ」)を可能にします。

エンタープライズセキュリティ: SOC2準拠とエンタープライズ級のアクセス制御。

長所

大量のメモリ保存が必要なエンタープライズ展開に対して、非常に信頼性が高くスケーラブルです。

サーバーレスアーキテクチャにより、DBインフラ管理のDevOps負担が軽減されます。

メタデータフィルタリングは、権限管理やチーム知識のセグメント分けに非常に有効です。

短所

純粋なデータベース層であり、チームは独自に検索ロジック、解析、アプリケーションインターフェースを構築する必要があります。

「ワークフロー」や「ユーザーセッション」をネイティブには理解せず、ベクトル埋め込みのみを扱います。

インフラ使用量に応じて課金されるため、コスト膨張を避けるには慎重な最適化が必要です。

価格

Starterは$50/月。Enterpriseは$500/月。

8. Weaviate

Weaviateは、インテリジェントアプリケーションの長期記憶として機能するよう設計された、オープンソースのAIネイティブベクトルデータベースです。MLモデルとのシームレスな統合と堅牢なハイブリッド検索機能により差別化され、エンタープライズRAGアーキテクチャで高い人気を誇ります。

主な機能

組み込みベクトル化: 統合モジュールを使って取り込み時にデータを自動的にベクトル化でき、メモリ作成パイプラインを簡素化します。

高度なハイブリッド検索: ベクトル検索とBM25キーワード検索を統合し、特定の文書やデータポイントを非常に正確に取得します。

マルチテナンシー対応: 何千もの異なるユーザーやテナント向けに、異なるメモリ空間を安全に扱えるよう設計されています。

グラフのような関係性: データオブジェクト間の相互参照をサポートし、AIメモリが異なる文書や概念の関係を理解できるようにします。

柔軟な展開: ローカル、Docker、Kubernetes、またはフルマネージドクラウドで実行できます。

長所

マルチテナンシーにより、自社のエンドユーザー向けにメモリを構築するB2B SaaS企業に最適です。

組み込みベクトル化により、メモリパイプラインを構築するチームの導入障壁が下がります。

オープンソースであるため、展開の柔軟性が高く、ベンダーロックインを回避できます。

短所

Pineconeと同様にデータベースであるため、非技術系チームがAIメモリを直接扱うためのネイティブなUI/UXがありません。

メモリオーケストレーションロジックの実装と保守には、専任の開発リソースが必要です。

グラフ機能は有用ですが、正しくモデル化するには学習曲線が急です。

価格

Flexは$45/月。Premiumは$400/月。

9. Chroma

Chromaは、シンプルさと速度から開発者に非常に支持されている、軽量なオープンソースのAI埋め込みデータベースです。LLMアプリケーション向けの導入しやすいメモリストアとして機能し、AIが文書や過去のやり取りから文脈を素早く取得できるようにします。

主な機能

開発者第一のシンプルさ: PythonまたはJavaScriptで、ほんの数行のコードでインストールして実行できます。

インメモリと永続ストレージ: テスト用にメモリ上で簡単に動かせるほか、ローカル永続メモリとしてディスクに保存できます。

自動埋め込み: 組み込みの埋め込み関数を備えており、開発者が生テキストを渡すだけでChromaがベクトル化を処理します。

豊富なエコシステム統合: LlamaIndex、LangChain、その他主要なAIフレームワークとシームレスに連携します。

ローカルファースト: ローカル実行に非常に最適化されており、機密性の高いチーム文書のデータプライバシーを確保します。

長所

AIメモリの迅速なプロトタイピングにおいて、ベクトルDBの中で最も簡単にセットアップできるものの一つと言えます。

機密チームデータを社内ネットワーク外に出せない、ローカルかつプライバシー重視の展開に最適です。

完全に無料でオープンソースです。

短所

大規模なベクトルDBが持つ、高度なエンタープライズ向けマルチテナンシーや分散スケーリング機能がありません。

マネージド基盤ではないため、本番運用ではチームが自分たちでデプロイを管理する必要があります。

厳密には埋め込みストアであり、エージェント状態、ワークフールール、ツール横断の移植性をネイティブには扱いません。

価格

Starterは無料、Teamは月額$250、Enterprise価格はカスタムです。

10. Qdrant

QdrantはRustで構築された高性能なベクトル検索エンジンで、AIアプリケーション向けの高速かつスケーラブルなメモリバックエンドとして機能するよう設計されています。特に、セマンティック検索と同時に、強力なメタデータフィルタリングを必要とするアプリに適しています。

主な機能

高速ベクトル検索: Rustで記述されており、メモリ検索において優れた性能とリソース効率を発揮します。

高度なペイロードフィルタリング: メモリに複雑なJSONペイロードを付与し、厳密な業務ロジックに基づいて検索を絞り込めます。

量子化対応: 高度な圧縮技術を使って、精度を落とさずに大量のベクトルメモリを低コストで保存します。

分散アーキテクチャ: エンタープライズ環境での高可用性と水平スケーリングのために構築されています。

多言語SDK: Python、Rust、Go、TypeScriptなどの公式クライアントを提供します。

長所

Rustベースのアーキテクチャにより、驚異的な性能と低いリソース消費を実現します。

厳格なキーワードルールとセマンティックメモリを組み合わせる必要があるチームにとって、ペイロードフィルタリングは非常に有用です。

組み込み量子化により、大規模運用でも非常に費用対効果が高いです。

短所

カスタムRAG/メモリパイプラインの一部として実装するには、強力なエンジニアリングチームが必要です。

Mem0のような特化型メモリツールと比べると、ユーザー管理の「すぐ使える感」はやや弱いです。

ビジネスユーザーがAIメモリロジックを管理したり追跡したりするためのネイティブUIがありません。

価格

Qdrant Cloudは、プロトタイピング向けの永続無料層を備えたマネージドサービスを提供し、その後は必要なクラスタリソースとストレージに応じてスケールする従量課金制です。企業向けのカスタム価格も利用できます。

チームのニーズ別に見た最適なAIメモリツールは?

チームごとにAI成熟度やユースケースは異なります。比較の前提をそろえるために、購入シナリオに応じてこれらのツールをどう分類すべきかを以下に示します。

エンタープライズ級AIメモリ基盤に最適

組織全体にサービスを提供する、集中管理されたガバナンス付きで移植可能なメモリレイヤーを構築したいなら、特に複雑な文書や反復ワークフロー向けに、MemoryLakeが強く推奨されます。非技術系のオペレーションチームが実際に管理できる基盤プラットフォームを提供することで、単なる生データベースを超えます。

軽量な開発者実装に最適

AIアプリを作る開発者で、ユーザーの好みを記憶するAPIが単に必要なだけなら、Mem0は素晴らしい即戦力のソリューションです。ローカルで試作したいなら、Chromaが最速で立ち上がるベクトルストアです。

文書重視 & スプレッドシート重視のRAGパイプラインに最適

データサイエンスチームが巨大な社内データレイクを使ってゼロからカスタムのコンテキストエンジンを構築するなら、LlamaIndex(データ取り込み/オーケストレーション用)とPineconeまたはWeaviate(ベクトル保存用)の組み合わせが業界標準です。

エージェント型ワークフローと自動化に最適

バックグラウンドで動作し、自分のメモリを編集し、複雑な複数ステップの状態を維持する必要がある自律型AIエージェントを構築するなら、Letta(MemGPT)やLangChain(LangGraph)のようなフレームワークが最も堅牢な選択肢です。

AIメモリツール vs. チャット履歴 vs. ベクトルデータベース

賢い購買判断を行うには、AI市場における技術的な違いを理解する必要があります。多くの場合、ベンダーはこの3つの概念を混同し、その結果、導入失敗につながります。

チャット履歴(基本形)

これはChatGPTやClaudeが標準で行うことです。単に以前のメッセージをトークン上限に達するまでコンテキストウィンドウへ追加するだけです。新しいチャットを始めると、AIはすべてを忘れます。これはステートレスで移植性がなく、チーム規模の文書メモリには不十分です。

ベクトルデータベース(保存層)

Pinecone、Weaviate、Qdrantのようなツールはベクトルデータベースです。AIがセマンティック検索できるように、データを数学的な埋め込みとして保存します。しかし、データベースはあくまで保存領域にすぎません。「ユーザーセッション」「エージェント間の移植性」「ワークフールールの強制」をネイティブに理解するわけではありません。メモリロジックは、その上に開発者が構築する必要があります。

AIメモリ基盤プラットフォーム(解決策)

MemoryLakeのようなツールは、データベースの上位にある包括的なレイヤーとして機能します。実際の基盤プラットフォームを提供し、スプレッドシートの取り込み、文書のバージョン管理、セッションの継続性維持、ガバナンスUIの提供を担います。生データ保存とエンドユーザーのAI体験のギャップを埋める存在です。

結論

同じ指示、SOP、スプレッドシートを空のAIプロンプト画面にコピー&ペーストし続ける時代は、終わりに近づいています。AIが単なるブレインストーミング支援から自律的なチームメンバーへ進化するにつれ、永続的なメモリはもはや贅沢品ではなく、基盤要件になっています。

市場を評価する際、チームは開発者向けデータベース、フレームワークに縛られた状態管理、そして真のエンタープライズメモリプラットフォームの違いを理解しなければなりません。カスタムRAGパイプラインを構築する開発チームがいるなら、Pinecone、LlamaIndex、Lettaへの投資は大きな価値をもたらします。

しかし、チームが重視しているのがビジネス成果であり、運用知識がファイル、スプレッドシート、複雑なワークフールールに強く依存しているなら、生データとAIの継続性をつなぐソリューションが必要です。

単純なチャット履歴や軽量APIを使うだけでは足りなくなったチームにとって、MemoryLakeは検討に値する存在です。永続的で移植可能なメモリレイヤーとして機能することで、AIは異なるセッション、モデル、エージェントをまたいで重要なチームコンテキストを保持できます。業務ロジックが変わっても、企業ワークフローに求められるガバナンスと追跡可能性を備えたまま、AIのメモリもそれに合わせて更新されます。

新しいタブを開くたびにAIを再学習させるのはやめましょう。拡張可能なAIメモリ基盤に投資し、AIにようやく、あなたのチームが実際にどのように仕事をしているかを学ばせましょう。

よくある質問

AIメモリツールとは何ですか?

AIメモリツールとは、人工知能モデルがユーザーの好み、業務コンテキスト、運用ルールなどの情報を複数のセッションややり取りをまたいで継続的に保存、想起、更新できるようにするソフトウェアまたは基盤のことです。標準的なLLMに本来ある健忘性を克服します。

AIメモリはチャット履歴とどう違うのですか?

チャット履歴は、モデルがトークン上限に達するまで、過去のメッセージを現在のプロンプトに戻しているだけです。AIメモリツールは、事実を動的に抽出して外部に保存し、最も関連性の高い情報だけを選択的に取得するため、何か月、何年にもわたる無限のコンテキスト保持が可能になります。

AIメモリツールはスプレッドシートや文書を覚えられますか?

はい、ただしツールによります。軽量なチャットメモリツールは構造化データが苦手です。MemoryLakeのような高度な基盤プラットフォームや、LlamaIndexのようなフレームワークは、複雑なスプレッドシートや複数ページの文書からデータを取り込み、解析し、継続的に想起できるように特別に設計されています。

AIメモリツールとベクトルデータベースの違いは何ですか?

ベクトルデータベース(Pineconeのようなもの)は、埋め込みデータのバックエンド保存です。AIメモリツールまたはプラットフォーム(MemoryLakeやMem0のようなもの)には、保存されたデータをAIエージェントにとって実際の「メモリ」として機能させるために必要なオーケストレーションロジック、ユーザー管理、セッション継続性、ガバナンスが含まれています。

チームに最適なAIメモリツールはどれですか?

アプリを構築する開発チームには、Mem0やLettaが優れています。カスタム開発を必要とせず、会社のSOP、文書、ワークフローをAIに継続的に記憶させたいビジネス/オペレーションチームには、MemoryLakeのようなエンタープライズプラットフォームがより優れた選択です。

企業はAIメモリプラットフォームで何を重視すべきですか?

企業は、ガバナンス(AIがなぜ何かを記憶したのかを把握できること)、追跡可能性、セキュリティ、マルチモーダル対応(文書/スプレッドシート)、そして移植性(蓄積されたチームメモリを失わずにAIモデルを切り替えられること)を優先すべきです。

軽量なメモリAPIで、ワークフローの多いチームには十分ですか?

一般的にはいいえ。軽量APIは、単純なユーザーの好み(例: 「JavaScriptよりPythonが好き」)を覚えるのには適しています。しかし、厳格なコンプライアンスルール、反復的な運用パターン、詳細なスプレッドシートを扱うワークフロー重視のチームには、複雑なルール強制とデータバージョン管理をサポートする、より堅牢な基盤レイヤーが必要です。

MemoryLakeはより単純なメモリツールと何が違うのですか?

MemoryLakeは、単なるツールではなく、永続的でユーザー管理型の基盤レイヤーとして位置づけられています。クロスモデルの移植性を重視しており、チームのメモリが1つのAIベンダーに縛られません。企業文書や反復ワークフローのような複雑なマルチモーダル入力をネイティブに処理できる点を強調しつつ、そのメモリを安全に監査・管理するために必要なガバナンスもチームに提供します。